LivePortraitV3,支持图像驱动和区域控制,更精确的人像控制(WIN,MAC)

LivePortrait又又又又更新了!这速度真是👍🏻👍🏻

【LivePortraitV3,支持图像驱动和区域控制,更精确的人像控制(WIN,MAC)】 https://www.bilibili.com/video/BV1LmsKeaEMd/?share_source=copy_web&vd_source=09316244e4ff3a9793930d67cf748288

这个版本更新内容如下:

新增图像驱动功能,现在你可以上传一张图像,根据里面的表情驱动视频或者图片。

改进驱动选项,支持表情、姿势、嘴唇、眼睛等区域精准控制。

有的小伙伴该问了?请问V2在哪里?怎么直接更新到V3了?

不好意思,我的疏忽,V2版本我直接发B站了,忘了写文章(真忘了,不是懒)

视频链接

https://www.bilibili.com/video/BV18qiFeNE6Z/?share_source=copy_web&vd_source=09316244e4ff3a9793930d67cf748288

下面我们来看看更新的详细内容

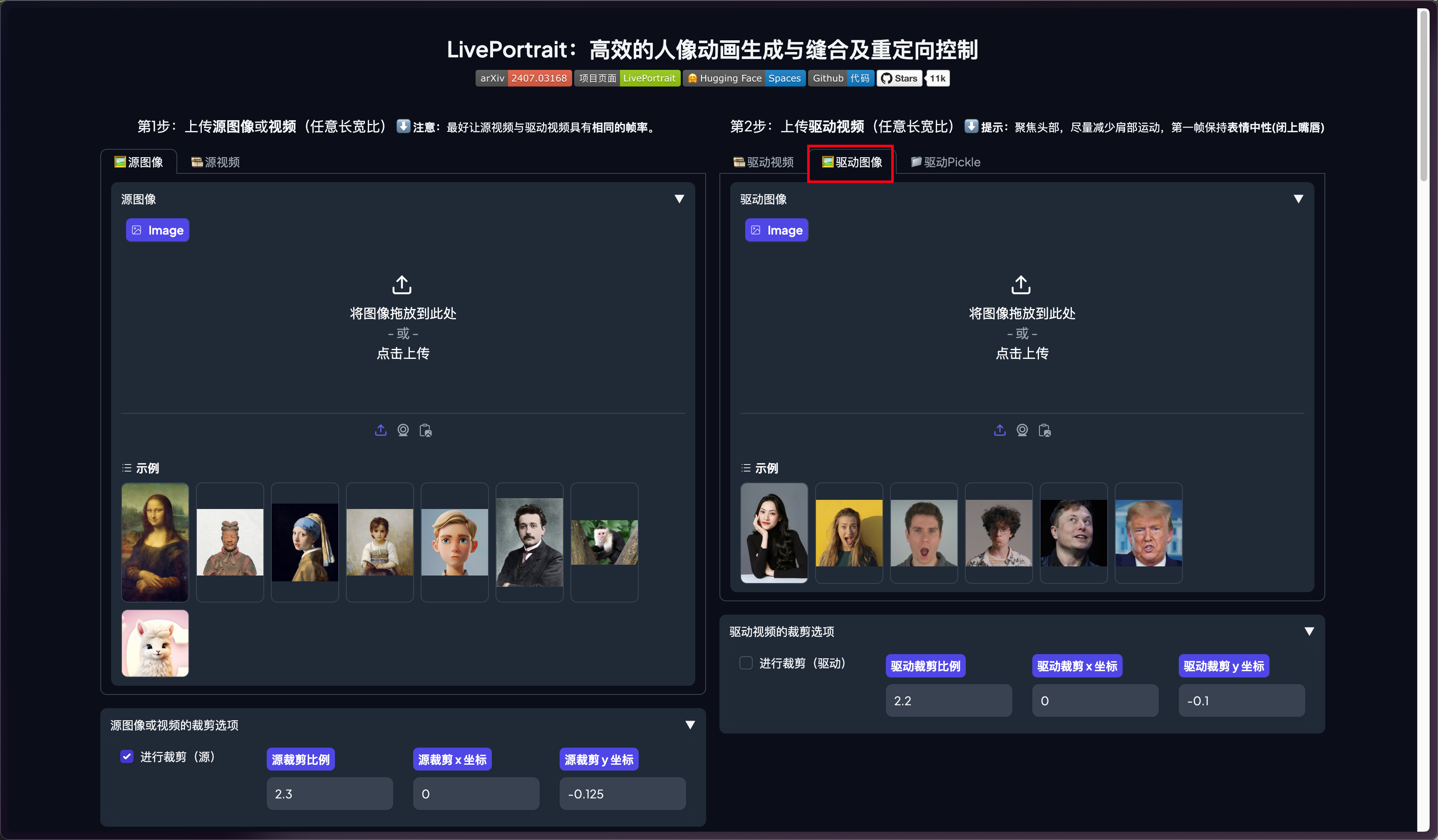

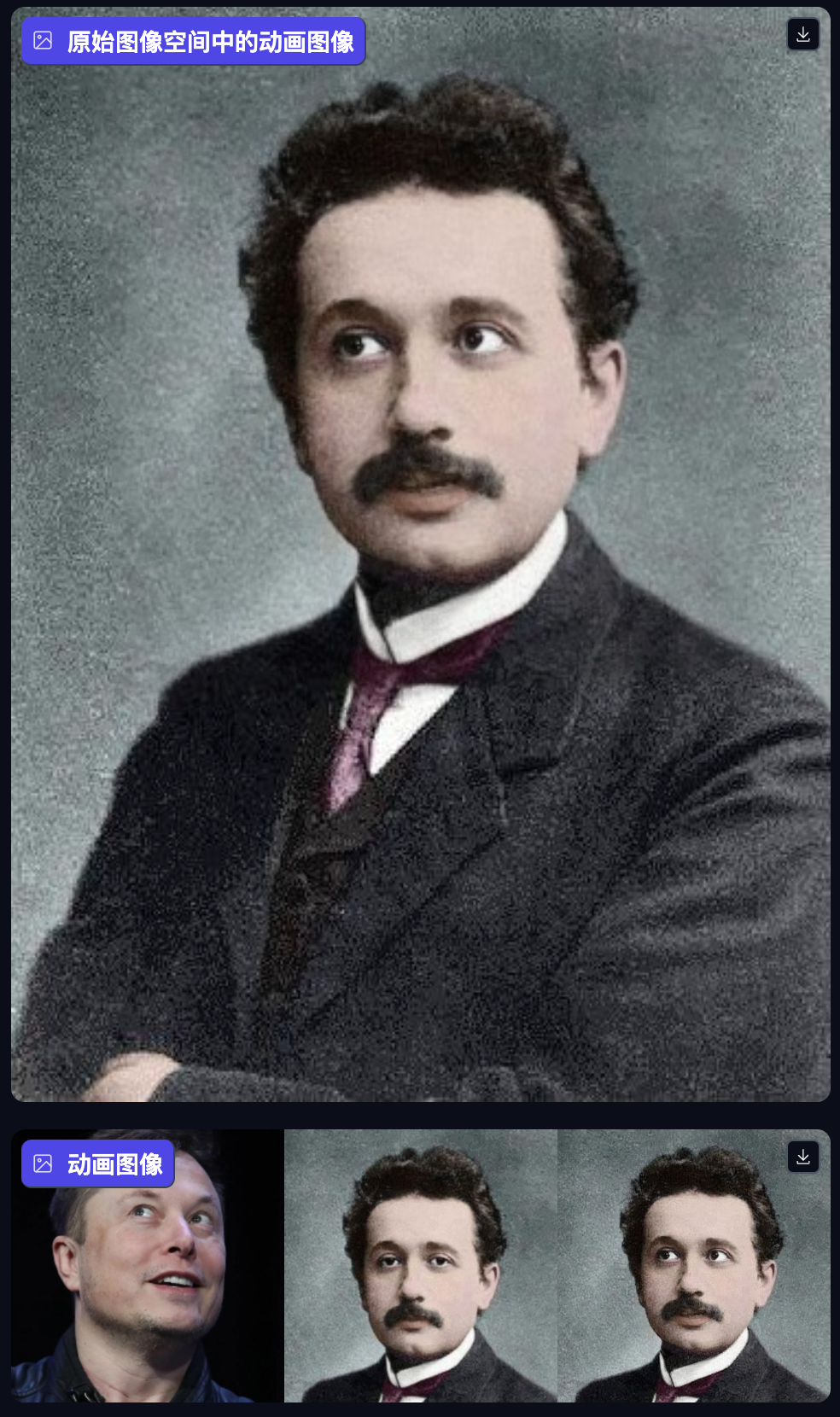

驱动图像

快速上手

点击驱动图像选项

源图像上传你想要更换表情的图片,驱动图像上传你想要迁移的表情图片。

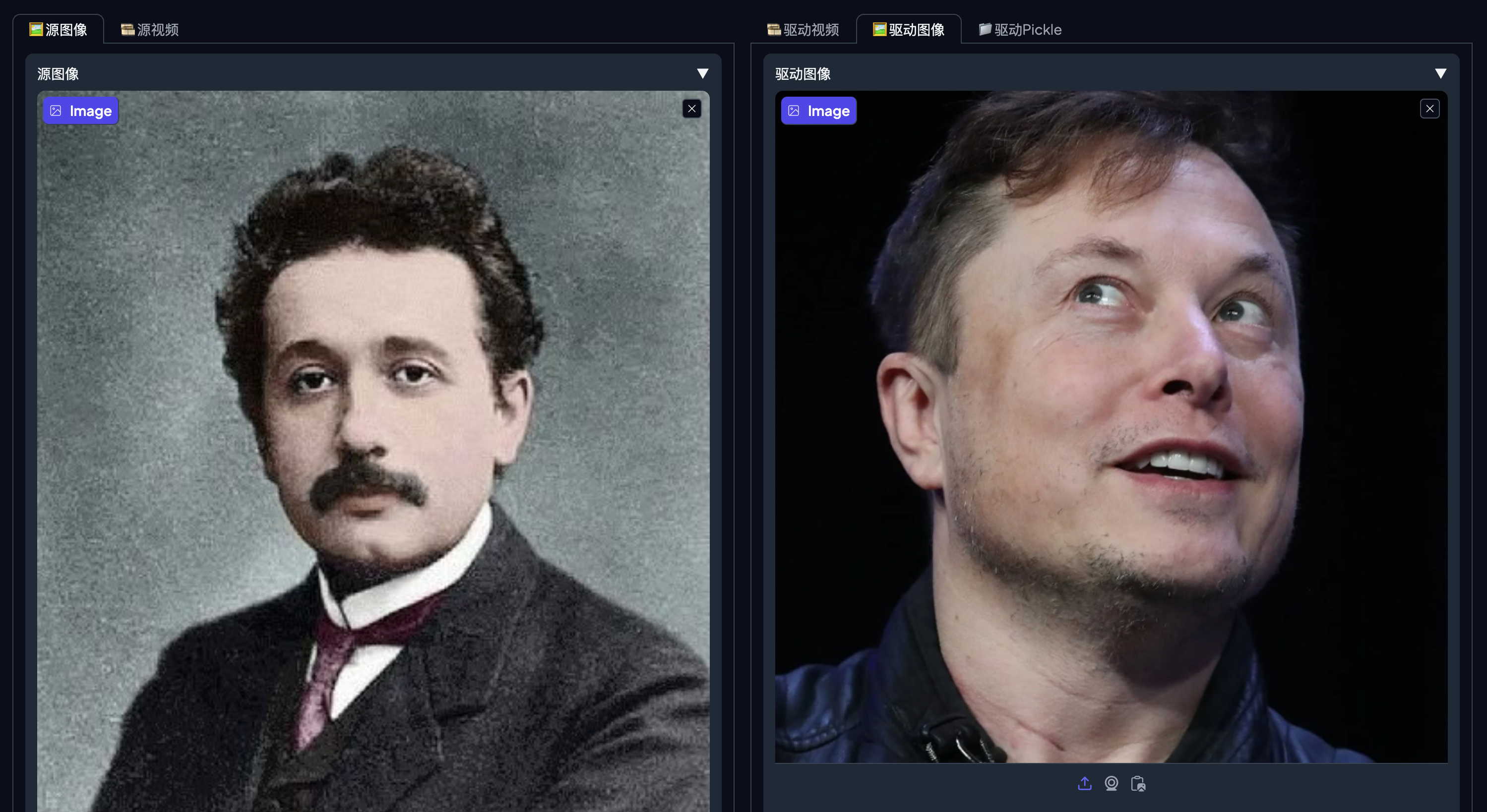

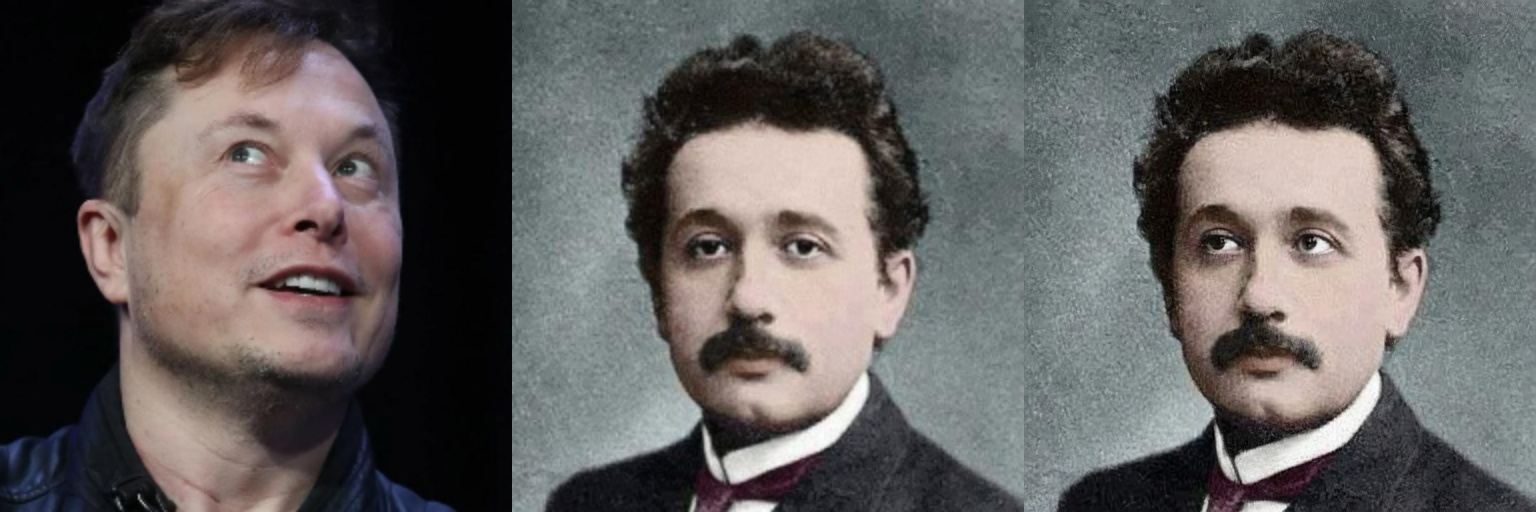

例如这样

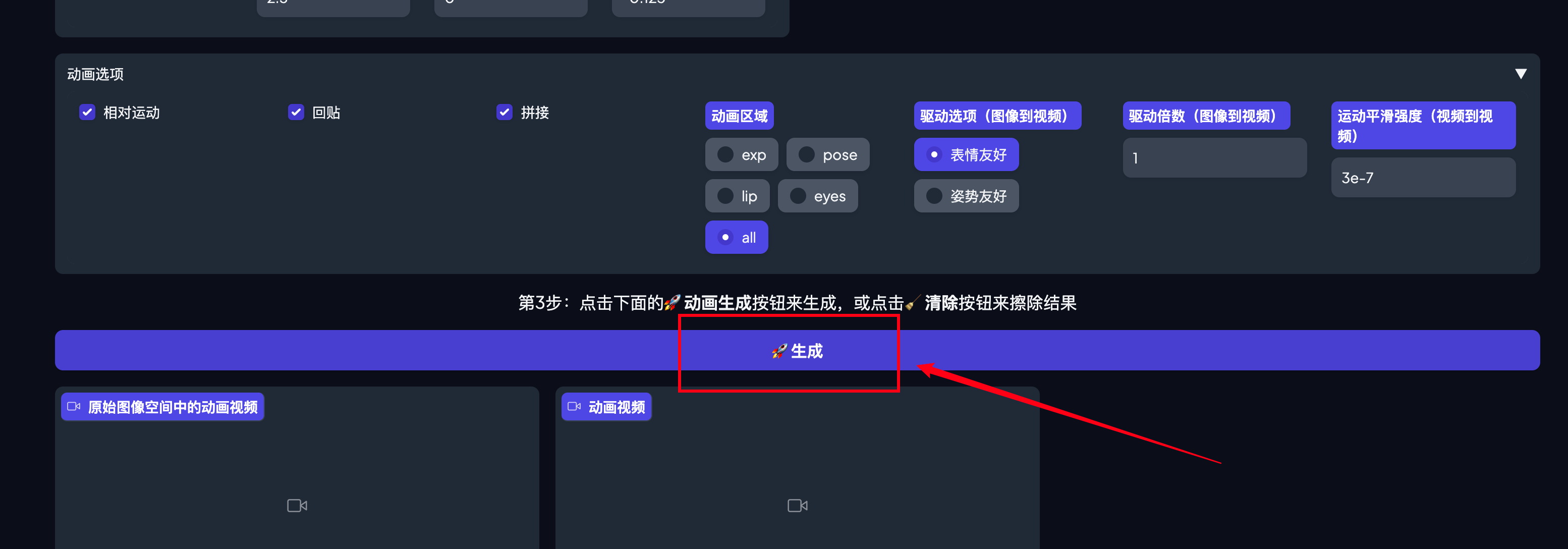

其他参数先不设置,来到下方直接点击生成

生成结果

可以看到LivePortrait将驱动图像的表情迁移到了源图像中。

下面介绍对应的参数的含义

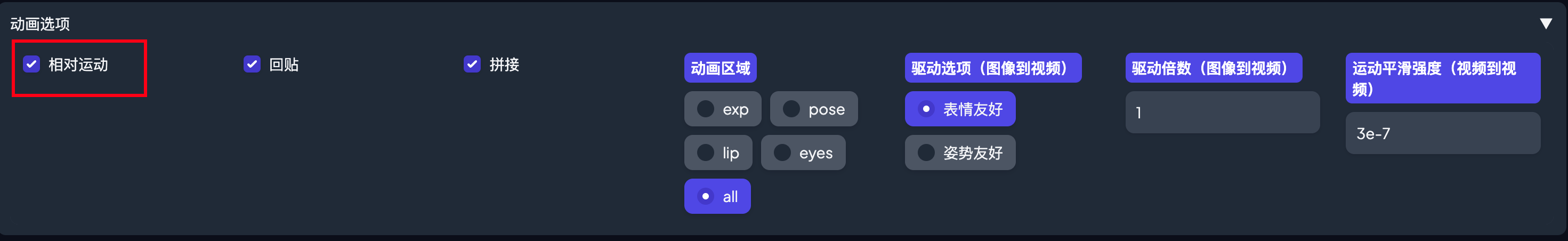

相对运动

这个参数控制如何应用运动变形,特别是在使用图像作为驱动输入时。

勾选☑️为开启相对运动。

取消勾选为开启绝对运动。

当为相对运动时,程序会计算驱动图像与其规范形式之间的运动差异,生成更自然的效果。

当为绝对运动时,程序会放大驱动的强度,完全根据驱动图像的姿态来生成,但有可能导致"身份泄漏"(即结果中可能会出现驱动图像的一些特征)。

所以开不开启相对运动根据你的情况来。

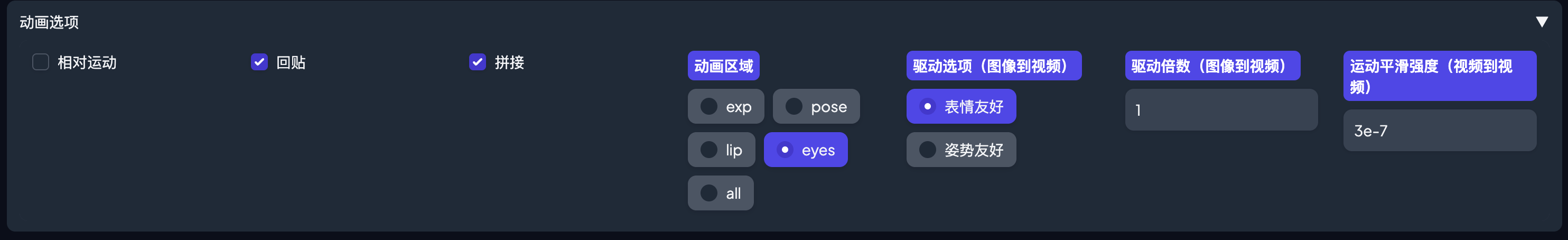

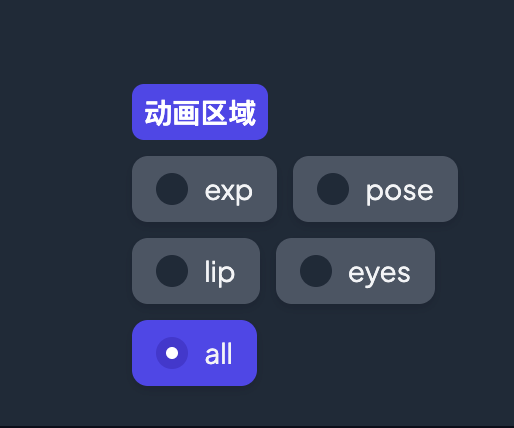

动画区域

这个参数用于精确控制驱动的部位。默认是全部

exp:驱动输入的表情。pose:驱动输入的头部姿势。lip:驱动输入的嘴唇部分。eyes:驱动输入的眼部。all:驱动所有的输入姿态。

不同选项生成的结果

exp

系统只会提取驱动输入中的表情变化(如微笑、皱眉等),并将这些表情变化应用到源图像/视频上。

pose

头部姿势驱动源图像/视频。包括头部的旋转(左右转动)、俯仰(上下点头)和偏转(头部向肩膀倾斜)。

lip

嘴唇动作驱动源图像/视频。嘴唇的开合、伸展、撅起等各种动作。

eye

眼睛运动驱动源图像/视频。眼球的转动、眨眼、眼睑的开合等各种眼部动作。

all

驱动输入的所有动作都被应用到源图像/视频上。

请注意,图像驱动或区域控制在某些情况下可能表现不佳。请随意尝试不同的选项,并保持耐心。😊

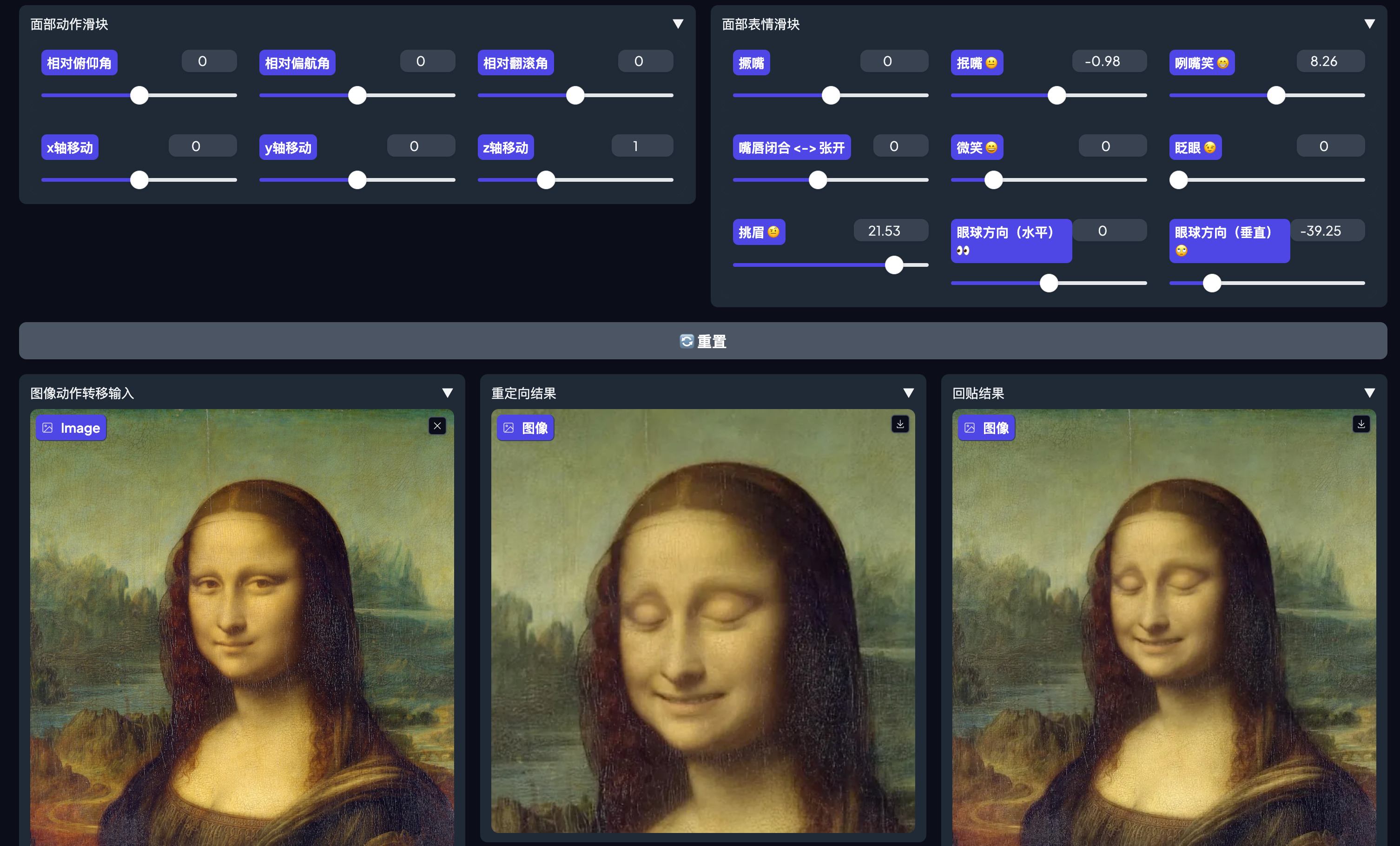

重定向图像

另外重定向图像这里也增加了更多的参数控制。

"闭眼睛的蒙娜丽莎"

其他模块没有太大的变动。

配置

WIN

需要N卡,6G以上显存。(RTX 3090 可以在 50 秒内生成 20 秒的动画)

MAC

- MacOS(Apple Silicon - M1/M2/M3)

- intel芯片暂不支持。

整合包获取

👇🏻👇🏻👇🏻下方下方下方👇🏻👇🏻👇🏻

关注我们的公众号,发送【LivePortraitV3】关键字获取整合包。

如果发了关键词没回复你!记得看下复制的时候是不是把空格给粘贴进去了!

注意关键字大小写

【LivePortraitV3,支持图像驱动和区域控制,更精确的人像控制(WIN,MAC)】 https://www.bilibili.com/video/BV1LmsKeaEMd/?share_source=copy_web&vd_source=09316244e4ff3a9793930d67cf748288

制作不易,如果本文对您有帮助,还请点个免费的赞或在看!感谢您的阅读!