深度学习回归任务训练代码模版

深度学习回归任务训练代码模版

文章目录

- 深度学习回归任务训练代码模版

- 参数设置

- 功能函数

- 数据加载

- 自定义数据集加载类

- 特征选择(可选)

- 数据读取

- 定义模型

- 训练模型

- 训练迭代+验证迭代

- 使用 `tensorboard` 输出模型训练过程和指标可视化(可选)

- 结果预测

- 参考

参数设置

超参设置:config 包含所有训练需要的超参数(便于后续的调参),以及模型需要存储的位置

device = 'cuda' if torch.cuda.is_available() else 'cpu'

config = {

'seed': 5201314, # 随机种子,可以自己填写. :)

'select_all': False, # 是否选择全部的特征

'valid_ratio': 0.2, # 验证集大小(validation_size) = 训练集大小(train_size) * 验证数据占比(valid_ratio)

'n_epochs': 3000, # 数据遍历训练次数

'batch_size': 256,

'learning_rate': 1e-5,

'early_stop': 400, # 如果early_stop轮损失没有下降就停止训练.

'save_path': './models/model.ckpt' # 模型存储的位置

}

功能函数

导入需要的Python包

# 数值、矩阵操作

import math

import numpy as np

# 数据读取与写入

import pandas as pd

import os

import csv

# 进度条

# from tqdm import tqdm

# 如果是使用notebook 推荐使用以下(颜值更高 : ) )

from tqdm.notebook import tqdm

# Pytorch 深度学习张量操作框架

import torch

import torch.nn as nn

from torch.utils.data import Dataset, DataLoader, random_split

# 绘制pytorch的网络

from torchviz import make_dot

# 学习曲线绘制

from torch.utils.tensorboard import SummaryWriter

一些重要的方法(随机种子设置、数据拆分、模型预测)

# 定义一个函数来设置随机种子,以确保实验的可复现性

def same_seed(seed):

"""

设置随机种子(便于复现)

"""

# 设置CUDA的确定性,确保每次运行的结果是确定的

torch.backends.cudnn.deterministic = True

# 关闭CUDA的benchmark模式,因为这与确定性运行模式冲突

torch.backends.cudnn.benchmark = False

# 设置NumPy的随机种子

np.random.seed(seed)

# 设置PyTorch的随机种子

torch.manual_seed(seed)

# 如果CUDA可用,则为GPU设置随机种子

if torch.cuda.is_available():

torch.cuda.manual_seed_all(seed)

# 打印设置的种子值

print(f'Set Seed = {seed}')

# 定义一个函数来将数据集随机拆分为训练集和验证集

def train_valid_split(data_set, valid_ratio, seed):

"""

数据集拆分成训练集(training set)和 验证集(validation set)

"""

# 计算验证集的大小

valid_set_size = int(valid_ratio * len(data_set))

# 训练集的大小是数据集总大小减去验证集大小

train_set_size = len(data_set) - valid_set_size

# 使用PyTorch的random_split函数来拆分数据集,传入随机种子以确保可复现性

train_set, valid_set = random_split(data_set, [train_set_size, valid_set_size], generator=torch.Generator().manual_seed(seed))

# 将拆分得到的数据集转换为NumPy数组格式并返回

return np.array(train_set), np.array(valid_set)

# 定义一个函数来进行模型的预测

def predict(test_loader, model, device):

# 将模型设置为评估模式

model.eval()

# 初始化一个列表来存储预测结果

preds = []

# 遍历测试数据集

for x in tqdm(test_loader):

# 将数据移动到指定的设备上(CPU或GPU)

x = x.to(device)

# 使用with torch.no_grad()来禁止计算梯度,因为在预测模式下不需要计算梯度

with torch.no_grad():

# 进行前向传播以获得预测结果

pred = model(x)

# 将预测结果从GPU移回CPU,并将其从计算图中分离出来

preds.append(pred.detach().cpu())

# 将所有批次的预测结果拼接成一个NumPy数组,并返回

preds = torch.cat(preds, dim=0).numpy()

return preds

数据加载

自定义数据集加载类

# 定义一个COVID19数据集类,继承自PyTorch的Dataset类

class COVID19Dataset(Dataset):

"""

x: np.ndarray 特征矩阵.

y: np.ndarray 目标标签, 如果为None,则是预测的数据集

"""

def __init__(self, x, y=None):

# 如果y不是None,则将y转换为PyTorch的FloatTensor类型,否则y保持为None

if y is None:

self.y = y

else:

self.y = torch.FloatTensor(y)

# 将x转换为PyTorch的FloatTensor类型

self.x = torch.FloatTensor(x)

def __getitem__(self, idx):

# 根据索引idx获取数据项

# 如果y是None,表示这是一个预测数据集,只返回x

if self.y is None:

return self.x[idx]

# 否则,返回一个包含x和y的元组

return self.x[idx], self.y[idx]

def __len__(self):

# 返回数据集中x的数量,即数据集的大小

return len(self.x)

特征选择(可选)

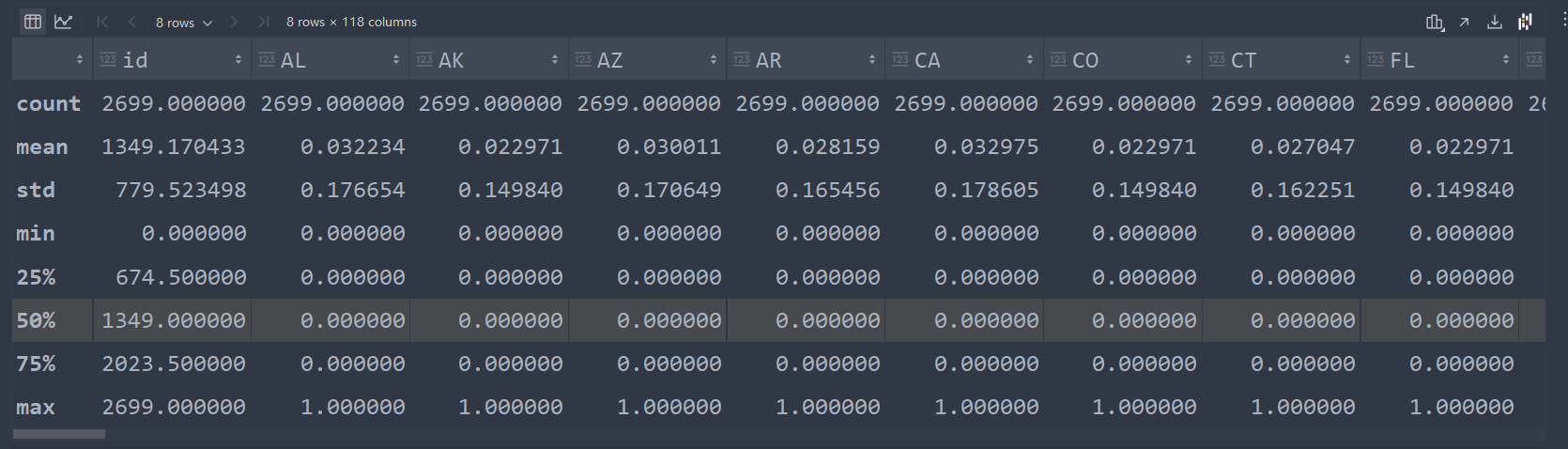

观察数据,选择更有效的数据

df = pd.read_csv('./covid.train.csv')

df.describe()

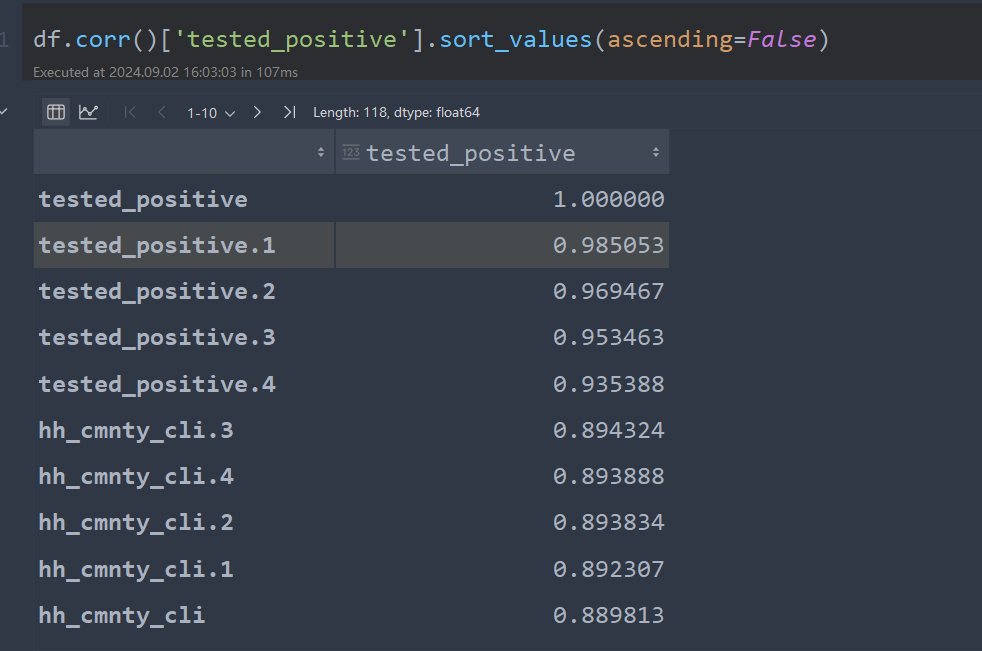

利用Pearson相关系数分析不同feature与label的相关性强弱。

df.corr()['tested_positive'].sort_values(ascending=False)

# 定义一个函数来选择特征,用于拟合回归模型

def select_feat(train_data, valid_data, test_data, select_all=True):

"""

特征选择

选择较好的特征用来拟合回归模型

"""

# 从训练数据中分离出目标变量y

y_train, y_valid = train_data[:, -1], valid_data[:, -1]

'''

[:, -1]:这是一个NumPy的切片操作,用于选择数组中的特定行和列。

:表示选择所有行,即选择整个数据集。

-1表示选择最后一列。在Python中,使用负数索引可以从数组的末尾开始计数,-1就是数组中的最后一个元素,对于二维数组来说,就是最后一列。

'''

# 从训练数据、验证数据和测试数据中分离出特征矩阵x

raw_x_train, raw_x_valid, raw_x_test = train_data[:, :-1], valid_data[:, :-1], test_data

'''

[:, :-1]:这是一个NumPy的切片操作,用于选择数组中的特定行和列。

:表示选择所有行,即选择整个数据集。

:-1表示选择从第一列开始直到倒数第二列的所有列。在Python中,使用负数索引可以从数组的末尾开始计数,-1就是数组中的最后一个元素之前的所有元素,对于二维数组来说,就是除了最后一列之外的所有列。

'''

# 如果select_all为True,则选择所有特征

if select_all:

feat_idx = list(range(raw_x_train.shape[1]))

else:

# 否则,根据某些标准(需要自行调研特征选择方法)选择特征

# 根据Pearson系数降序排列的结果,我们重新选择特征。

# 去掉第一列 id 列

feat_idx = list(range(1, 38)) + [53, 69, 85, 101]

# 返回选定的特征矩阵和目标变量

return raw_x_train[:, feat_idx], raw_x_valid[:, feat_idx], raw_x_test[:, feat_idx], y_train, y_valid

数据读取

- 从文件中读取数据

pd.read_csv - 数据拆分成三份 训练(training)、验证(validation)、测试(testing)

train_valid_split: 分成训练、验证select_feat:拆分特征和label,并进行特征选择COVID19Dataset: 分别将训练、验证、测试集的特征和label组合成可以用于快速迭代训练的数据集train_dataset, valid_dataset, test_dataset

# 设置随机种子便于复现

same_seed(config['seed'])

# 训练集大小(train_data size) : 2699 x 118 (id + 37 states + 16 features x 5 days)

# 测试集大小(test_data size): 1078 x 117 (没有label (last day's positive rate))

pd.set_option('display.max_column', 200) # 设置显示数据的列数

train_df, test_df = pd.read_csv('./covid.train.csv'), pd.read_csv('./covid.test.csv')

display(train_df.head(3)) # 显示前三行的样本

train_data, test_data = train_df.values, test_df.values

del train_df, test_df # 删除数据减少内存占用

train_data, valid_data = train_valid_split(train_data, config['valid_ratio'], config['seed'])

# 打印数据的大小

print(f"""train_data size: {train_data.shape}

valid_data size: {valid_data.shape}

test_data size: {test_data.shape}""")

# 特征选择

x_train, x_valid, x_test, y_train, y_valid = select_feat(train_data, valid_data, test_data, config['select_all'])

# 打印出特征数量

print(f'number of features: {x_train.shape[1]}')

train_dataset, valid_dataset, test_dataset = COVID19Dataset(x_train, y_train), \

COVID19Dataset(x_valid, y_valid), \

COVID19Dataset(x_test)

# 使用Pytorch中Dataloader类按照Batch将数据集加载

train_loader = DataLoader(train_dataset, batch_size=config['batch_size'], shuffle=True, pin_memory=True)

valid_loader = DataLoader(valid_dataset, batch_size=config['batch_size'], shuffle=True, pin_memory=True)

test_loader = DataLoader(test_dataset, batch_size=config['batch_size'], shuffle=False, pin_memory=True)

定义模型

# 定义一个自定义的模型类My_Model,继承自nn.Module

class My_Model(nn.Module):

def __init__(self, input_dim):

super(My_Model, self).__init__()

# 定义模型的结构为一个顺序模型(Sequential),包含线性层(Linear)和激活函数(ReLU)

self.layers = nn.Sequential(

# 第一层线性层,输入维度为input_dim,输出维度为16

nn.Linear(input_dim, 16),

# ReLU激活函数

nn.ReLU(),

# 第二层线性层,输入维度为16,输出维度为8

nn.Linear(16, 8),

# ReLU激活函数

nn.ReLU(),

# 第三层线性层,输入维度为8,输出维度为1

nn.Linear(8, 1)

)

def forward(self, x):

# 在前向传播中,输入x通过定义的层(layers)

x = self.layers(x)

# 使用squeeze函数移除输出张量的一个维度,使其从形状(B, 1)变为(B)

x = x.squeeze(1)

# 返回模型的输出

return x

训练模型

训练迭代+验证迭代

def trainer(train_loader, valid_loader, model, config, device):

criterion = nn.MSELoss(reduction='mean') # 损失函数的定义

# 定义优化器

# TODO: 可以查看学习更多的优化器 https://pytorch.org/docs/stable/optim.html

# TODO: L2 正则( 可以使用optimizer(weight decay...) )或者 自己实现L2正则.

optimizer = torch.optim.SGD(model.parameters(), lr=config['learning_rate'], momentum=0.9)

# tensorboard 的记录器

writer = SummaryWriter()

if not os.path.isdir('./models'):

# 创建文件夹-用于存储模型

os.mkdir('./models')

n_epochs, best_loss, step, early_stop_count = config['n_epochs'], math.inf, 0, 0

for epoch in range(n_epochs):

model.train() # 训练模式

loss_record = []

# tqdm可以帮助我们显示训练的进度

train_pbar = tqdm(train_loader, position=0, leave=True)

# 设置进度条的左边 : 显示第几个Epoch了

train_pbar.set_description(f'Epoch [{epoch+1}/{n_epochs}]')

for x, y in train_pbar:

optimizer.zero_grad() # 将梯度置0.

x, y = x.to(device), y.to(device) # 将数据一到相应的存储位置(CPU/GPU)

pred = model(x) # 前向传播

loss = criterion(pred, y) # 计算损失

loss.backward() # 反向传播 计算梯度.

optimizer.step() # 更新网络参数

step += 1

loss_record.append(loss.detach().item())

# 训练完一个batch的数据,将loss 显示在进度条的右边

train_pbar.set_postfix({'loss': loss.detach().item()})

mean_train_loss = sum(loss_record)/len(loss_record)

# 每个epoch,在tensorboard 中记录训练的损失(后面可以展示出来)

writer.add_scalar('Loss/train', mean_train_loss, step)

model.eval() # 将模型设置成 evaluation 模式.

loss_record = []

for x, y in valid_loader:

x, y = x.to(device), y.to(device)

with torch.no_grad():

pred = model(x)

loss = criterion(pred, y)

loss_record.append(loss.item())

mean_valid_loss = sum(loss_record)/len(loss_record)

print(f'Epoch [{epoch+1}/{n_epochs}]: Train loss: {mean_train_loss:.4f}, Valid loss: {mean_valid_loss:.4f}')

# 每个epoch,在tensorboard 中记录验证的损失(后面可以展示出来)

writer.add_scalar('Loss/valid', mean_valid_loss, step)

# 如果当前验证损失优于最佳损失,则保存模型

if mean_valid_loss < best_loss:

best_loss = mean_valid_loss

torch.save(model.state_dict(), config['save_path']) # 模型保存

print('Saving model with loss {:.3f}...'.format(best_loss))

early_stop_count = 0

else:

early_stop_count += 1

# 如果连续多次验证损失没有改善,则停止训练

if early_stop_count >= config['early_stop']:

print('\nModel is not improving, so we halt the training session.')

return

开始训练

model = My_Model(input_dim=x_train.shape[1]).to(device) # 将模型和训练数据放在相同的存储位置(CPU/GPU)

trainer(train_loader, valid_loader, model, config, device)

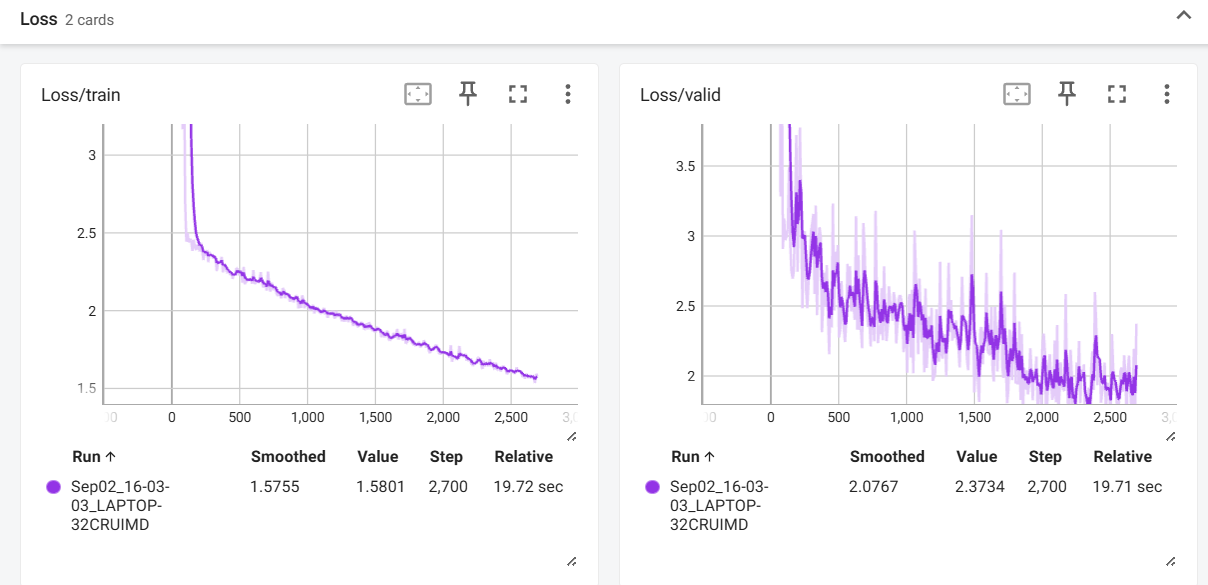

使用 tensorboard 输出模型训练过程和指标可视化(可选)

tensorboard 可视化工具:可以记录并展现模型的训练过程中的各种指标,这里我们是记录模型的损失

%reload_ext tensorboard

%tensorboard --logdir=./runs/ --port=6007

结果预测

测试集的预测结果保存到pred.csv.

def save_pred(preds, file):

""" 将模型保存到指定位置 """

with open(file, 'w', newline='') as fp: # 添加 newline='' 防止在Windows上出现额外的空行

writer = csv.writer(fp)

writer.writerow(['id', 'tested_positive'])

for i, p in enumerate(preds):

writer.writerow([i, p])

model = My_Model(input_dim=x_train.shape[1]).to(device)

model.load_state_dict(torch.load(config['save_path']))

preds = predict(test_loader, model, device)

save_pred(preds, 'pred.csv')

参考

完整代码见:Hongyi_Lee_dl_homeworks/HW1_Regression at master · huaiyuechusan/Hongyi_Lee_dl_homeworks (github.com)

参考文章:

【李宏毅《机器学习》2022】作业1:COVID 19 Cases Prediction (Regression)_李宏毅2022作业-CSDN博客

Hongyi_Lee_dl_homeworks/Warmup/Pytorch_Tutorial_2.pdf at master · huaiyuechusan/Hongyi_Lee_dl_homeworks (github.com)

e/master/HW1_Regression)

参考文章:

【李宏毅《机器学习》2022】作业1:COVID 19 Cases Prediction (Regression)_李宏毅2022作业-CSDN博客

Hongyi_Lee_dl_homeworks/Warmup/Pytorch_Tutorial_2.pdf at master · huaiyuechusan/Hongyi_Lee_dl_homeworks (github.com)