利用Python爬虫实现数据收集与挖掘

Python爬虫是一种自动化程序,可以模拟浏览器行为,自动地从互联网上抓取、分析和收集数据。Python爬虫通常使用requests、selenium等库来发送HTTP请求,获取网页内容,并使用BeautifulSoup、lxml等库来解析网页,提取所需的数据。

以下是一个简单的Python爬虫示例,用于从某个网页上抓取数据:

import requests

from bs4 import BeautifulSoup

# 发送HTTP请求,获取网页内容

url = 'https://example.com'

response = requests.get(url)

html = response.text

# 使用BeautifulSoup解析网页

soup = BeautifulSoup(html, 'html.parser')

# 提取所需的数据

titles = soup.find_all('h1')

for title in titles:

print(title.text)

上述代码中,我们首先使用requests库发送HTTP请求,获取指定URL的网页内容。然后,我们使用BeautifulSoup库解析网页,并查找所有的h1标签。最后,我们遍历所有的h1标签,并打印出它们的文本内容。

当然,实际的爬虫程序可能会更加复杂,需要处理各种异常情况、使用代理IP、设置请求头等信息,以避免被网站屏蔽或限制。同时,我们也需要注意遵守网站的爬虫协议和法律法规,不要进行恶意爬取或滥用爬虫技术。

除了上述示例中的requests和BeautifulSoup库之外,Python爬虫还可以使用其他库和工具来提高效率和准确性。例如,Scrapy是一个强大的Python爬虫框架,可以帮助我们快速地构建高效的爬虫程序。Selenium库可以模拟真实的浏览器行为,以应对一些反爬虫机制。同时,我们还可以使用各种数据库或存储技术来保存和处理爬取到的数据。

需要注意的是,爬虫技术有一定的技术门槛和法律风险,建议在使用前充分了解相关法律法规和平台规定,并谨慎操作。

爬虫的高级特性

-

- 动态内容爬取:有些网页使用JavaScript动态加载内容。这种情况下,直接使用

requests库可能无法获取到全部内容。解决方案包括使用Selenium(模拟真实浏览器环境)或Pyppeteer(控制无头Chrome或Chromium浏览器)来加载和执行JavaScript。

- 动态内容爬取:有些网页使用JavaScript动态加载内容。这种情况下,直接使用

-

- 处理Cookies和Sessions:对于需要登录的网站,爬虫需要处理Cookies和Sessions以保持登录状态。

requests.Session对象可以自动处理Cookies,使得在多个请求之间保持会话状态。

- 处理Cookies和Sessions:对于需要登录的网站,爬虫需要处理Cookies和Sessions以保持登录状态。

-

- 设置请求头:为了避免被网站识别为爬虫并阻止访问,通常需要设置请求头(User-Agent等),以模拟正常浏览器访问。

-

- 处理分页和异步加载:对于分页或异步加载的内容,需要分析网站的请求方式,模拟相应的请求以获取完整数据。

-

- 数据清洗和存储:爬取到的数据通常需要进行清洗和整理,以便后续分析。可以使用

pandas库进行数据清洗,并将数据保存到CSV、Excel、数据库等。

- 数据清洗和存储:爬取到的数据通常需要进行清洗和整理,以便后续分析。可以使用

-

- 多线程/异步爬虫:为了提高爬虫效率,可以使用多线程(

threading模块)或异步IO(如asyncio库)来并发发送请求。

- 多线程/异步爬虫:为了提高爬虫效率,可以使用多线程(

-

- **遵守

robots.txt**:在爬取网站之前,应检查robots.txt文件,以确保你的爬虫遵循网站所有者的规定。

- **遵守

-

- 错误处理和日志记录:爬虫程序应包含错误处理机制,并记录详细的日志以便于调试和监控。

操作代码示例(使用Selenium)

以下是一个使用Selenium爬取动态加载网页内容的简单示例:

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.support.ui import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

# 启动Chrome浏览器(需要安装对应的ChromeDriver)

driver = webdriver.Chrome()

# 打开目标网页

driver.get("https://example.com/dynamic-page")

# 等待某个元素加载完成(例如:一个特定的ID或类名)

element = WebDriverWait(driver, 10).until(

EC.presence_of_element_located((By.ID, "dynamic-content"))

)

# 提取所需数据(这里以文本为例)

content = element.text

print(content)

# 关闭浏览器窗口

driver.quit()

在这个示例中,我们使用了Selenium来启动一个真实的Chrome浏览器窗口,并等待动态加载的内容出现后再提取数据。这种方式比单纯使用requests库更强大,但也会消耗更多的资源,并且运行速度可能较慢。

请注意,在使用Selenium时,你需要确保已经安装了对应的WebDriver(如ChromeDriver),并且它与你的浏览器版本兼容。此外,Selenium爬虫更容易被网站检测到,因此在使用时应谨慎。

爬虫的应用场景

-

- 数据收集与挖掘:爬虫可以用于收集特定领域的数据,如市场价格、竞争对手分析、学术研究等。

-

- 内容聚合:例如新闻聚合网站,通过爬虫实时抓取各大新闻源的最新报道。

-

- 搜索引擎优化:搜索引擎使用爬虫(也称为网络蜘蛛或机器人)来索引互联网上的内容,以便为用户提供搜索服务。

-

- 安全与渗透测试:在网络安全领域,爬虫可用于检测网站的安全漏洞。

爬虫开发的关键步骤

-

- 确定目标:明确需要爬取的数据类型和目标网站。

-

- 分析网站结构:了解目标网站的HTML结构、URL格式、可能存在的反爬虫机制等。

-

- 设计爬虫策略:选择合适的库(如requests、BeautifulSoup、Scrapy等),编写爬虫逻辑。

-

- 发送请求并处理响应:模拟浏览器向服务器发送请求,接收并解析服务器的响应。

-

- 提取数据:从响应内容中提取所需的数据。

-

- 存储数据:将数据保存到本地文件、数据库或其他存储系统中。

-

- 测试和调优:测试爬虫的准确性和性能,根据实际情况进行调整和优化。

注意事项与合规性

-

- 遵守法律法规:在爬虫开发过程中,必须遵守相关的法律法规,如版权法、个人信息保护法等。

-

- 尊重网站的爬虫协议:检查并遵守目标网站的

robots.txt文件中的规定。

- 尊重网站的爬虫协议:检查并遵守目标网站的

-

- 避免对目标网站造成过大负担:合理设置爬虫的请求频率,避免对目标服务器造成过大的访问压力。

-

- 数据准确性和时效性:确保爬取的数据准确无误,并关注数据的更新频率。

-

- 网络安全和隐私保护:在爬虫开发过程中,要注意网络安全和隐私保护,避免泄露敏感信息。

示例代码(使用Scrapy框架)

Scrapy是一个强大的Python爬虫框架,可以简化爬虫的开发过程。以下是一个简单的Scrapy爬虫示例:

import scrapy

class MySpider(scrapy.Spider):

name = 'example_spider'

start_urls = ['https://example.com']

def parse(self, response):

for title in response.css('h1.title'): # 假设网页中的标题位于h1标签中,且有一个'title'的类名

yield {'title': title.get_text()}

在这个示例中,我们创建了一个名为MySpider的爬虫类,它继承自scrapy.Spider。我们定义了爬虫的起始URL和解析方法。在parse方法中,我们使用CSS选择器来定位并提取网页中的标题文本。最后,我们使用yield语句将提取的数据以字典的形式返回。

请注意,这只是一个简单的示例,实际的爬虫代码可能会更加复杂,并需要处理各种异常情况和反爬虫机制。

最后,这里免费分享给大家一套免费的学习资料,包含视频、源码/电子书,希望能帮到那些不满现状,想提升自己却又没有方向的朋友,也可以加我微信一起来学习交流。

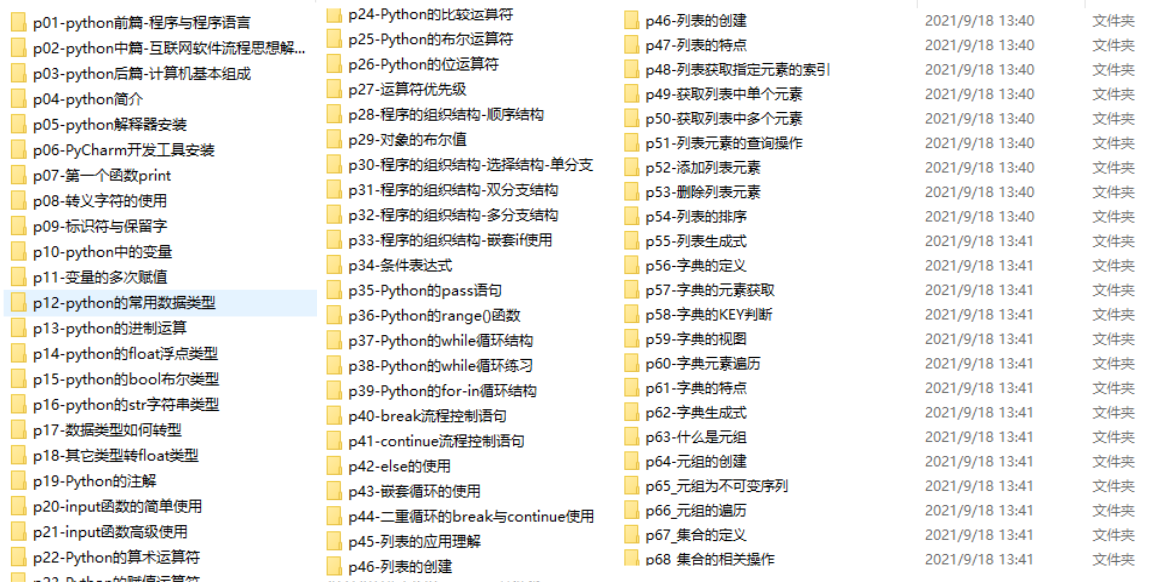

① Python方向的学习路线图,清楚各个方向要学什么东西

② 100多节Python课程视频,涵盖必备基础、爬虫和数据分析

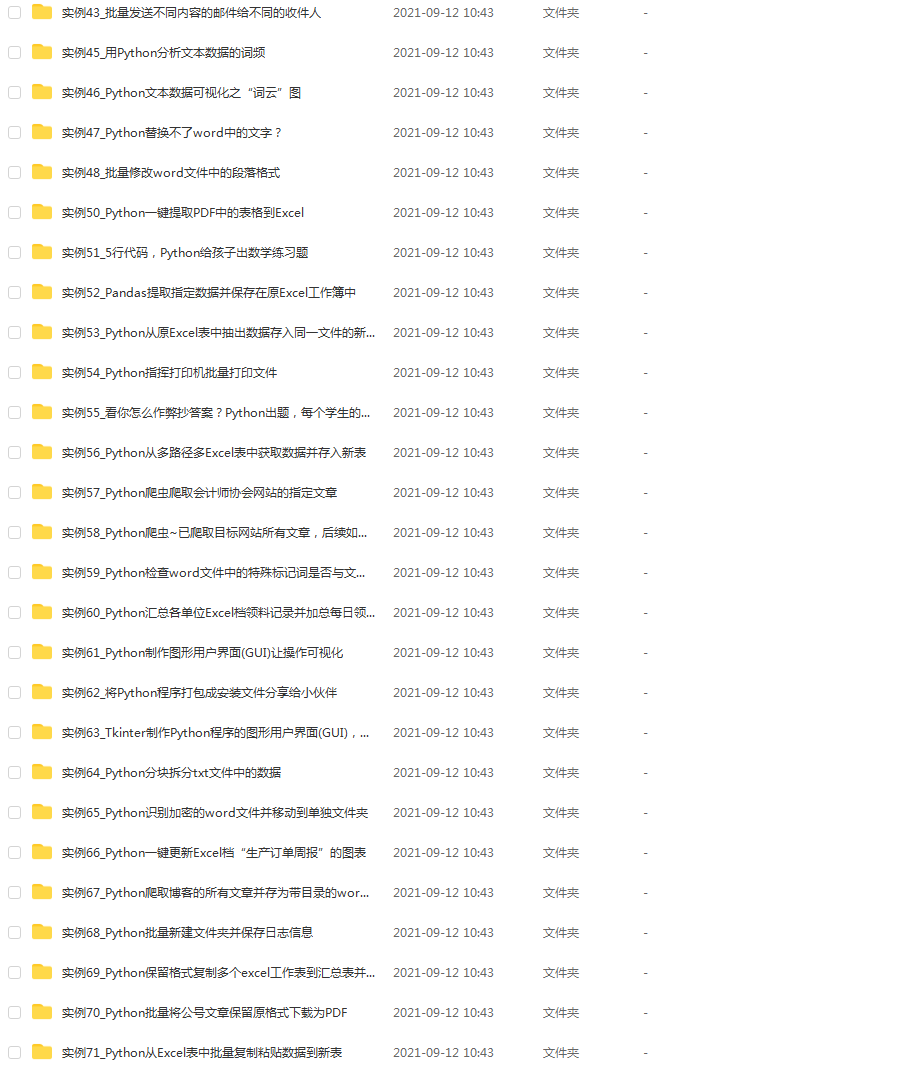

③ 100多个Python实战案例,学习不再是只会理论

④ Python漫画教程,手机也能学习

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

**学习资源已打包,需要的小伙伴可以戳这里【学习资源】