DINO-DETR在CADC数据集进行实验与分析

先前使用DINO-DETR模型在COCO缩减版上进行实验,效果并不是很理想,主要猜测是由于在该数据集中车辆信息的特征信息存在模糊,背景复杂,缺失等情况,而bus目标属于大目标,特征信息表示完整,且出现时背景较为单一,故而效果比较明显。

紧接着,博主想到可以在该模型上使用CADC数据集进行实验,看看其表现如何。

CADC数据集是博主从网上寻找的冰雪环境下的自动驾驶数据集,共计5250张图片,博主首先划分出1050张作为测试集,随后将剩余的4200张按照4:1划分训练集与验证集,即3360张作为训练集,840张作为验证集,之所以将1050张划分为测试集,是因为整体数据集主要划分为5个驾驶场景,为保证测试集与训练集完全独立,即训练集中没有获取到测试集的信息,故将最后一个驾驶场景作为测试集。

博主采用了与训练COCO数据集时相同的参数,即batch-size=2,lr = 0.0001,epochs=12。

最终训练完成后在验证集上进行评估:

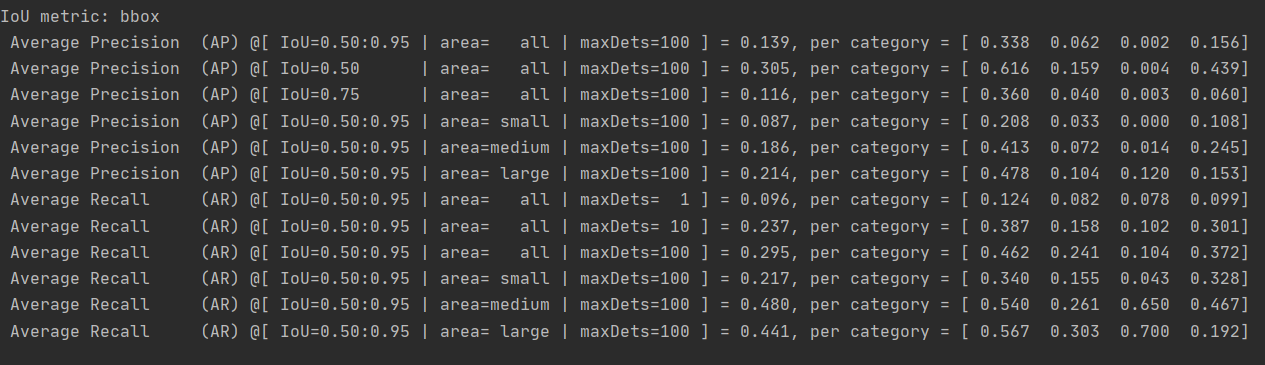

训练12个epoch的结果:

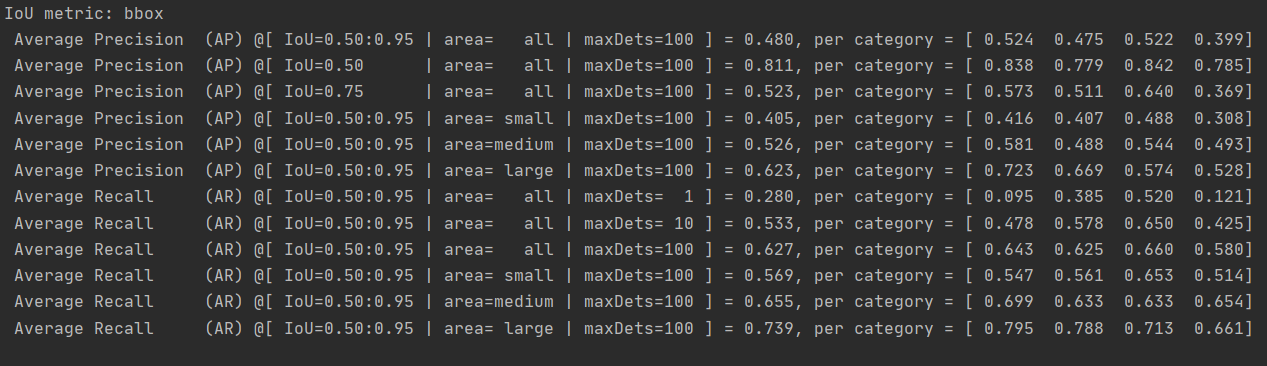

训练24个epoch的结果:

这个结果相对而言还是不错的,尽管相对于目前主流的目标检测模型,如YOLO等依旧稍逊一筹,但其却达到了与官方在完整COCO数据集的效果。

接下来,博主会将模型在测试上来检测其性能。

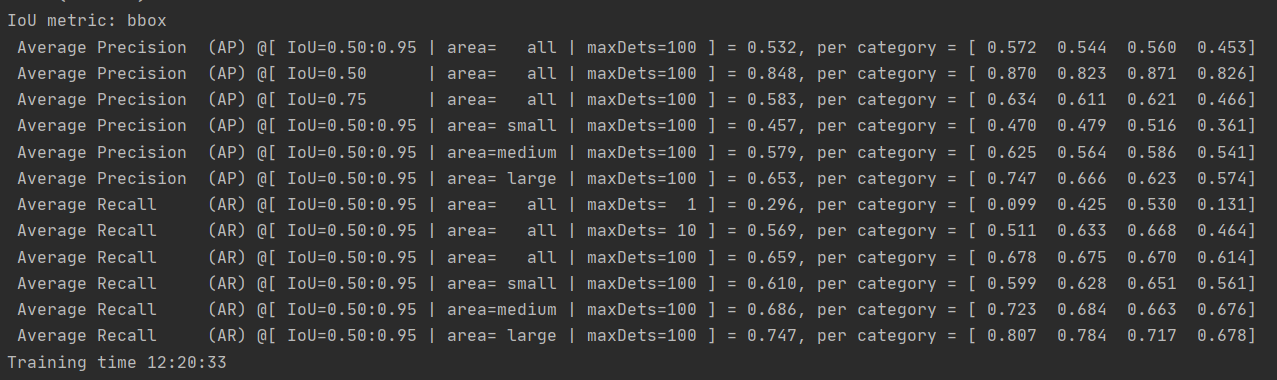

使用最好模型进行测试结果如下:

可以看到差距还是及其明显的。

[‘car’, ‘truck’, ‘bus’, ‘person’]