Pytorch学习笔记(七)Learn the Basics - Optimizing Model Parameters

这篇博客瞄准的是 pytorch 官方教程中 Learn the Basics 章节的 Optimizing Model Parameters 部分。

- 官网链接:https://pytorch.org/tutorials/beginner/basics/optimization_tutorial.html

完整网盘链接: https://pan.baidu.com/s/1L9PVZ-KRDGVER-AJnXOvlQ?pwd=aa2m 提取码: aa2m

Optimizing Model Parameters

训练模型是一个迭代过程;在每次迭代中模型都会对输出进行预测,计算预测与真实值的误差(即损失),对误差相对于其参数的导数使用梯度下降优化这些参数。

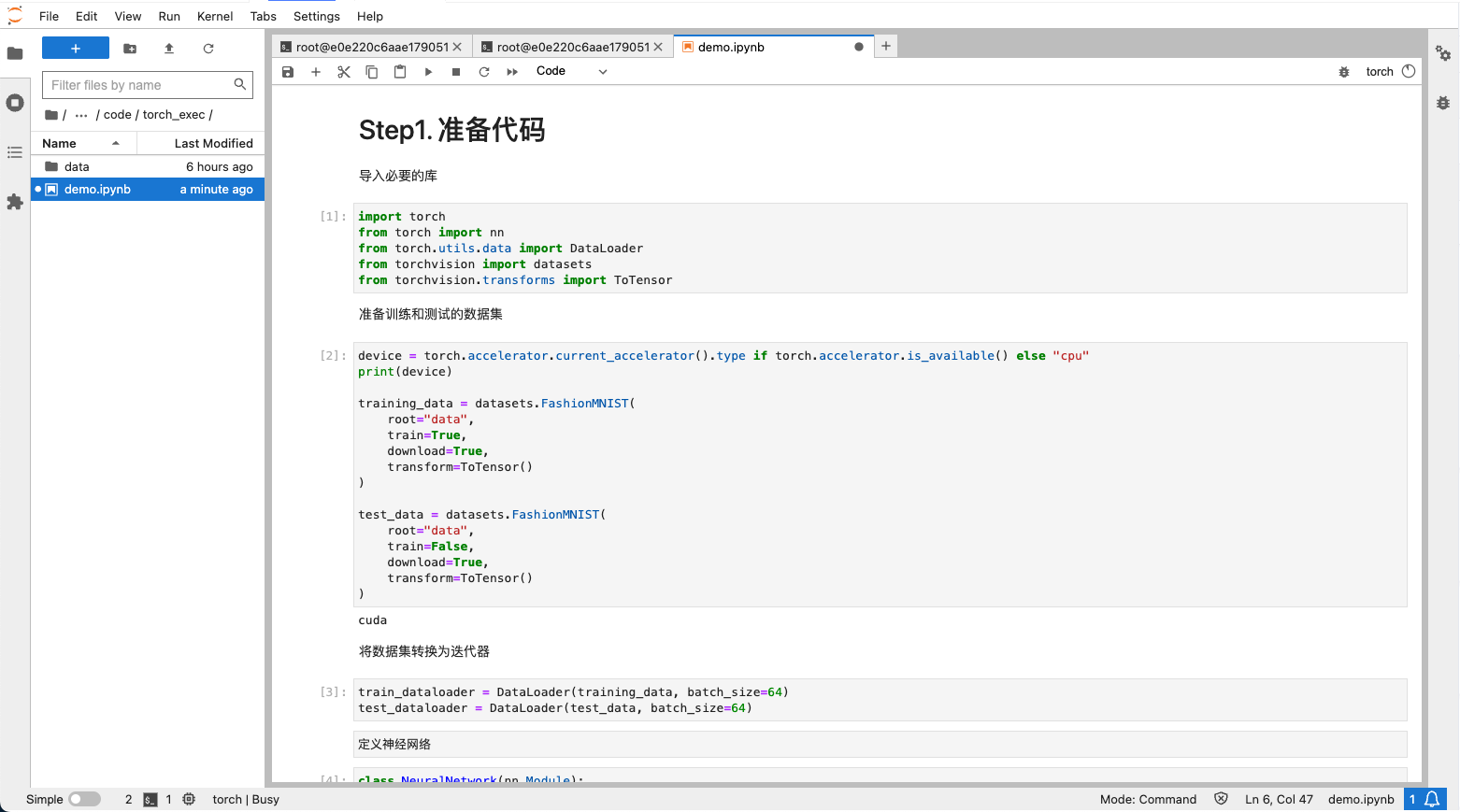

Step1. 准备代码

这里使用前面关于 datasets 和 DataLoader 以及构建模型的部分加载代码。

- 导入必要的库

import torch

from torch import nn

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision.transforms import ToTensor

- 准备训练与测试数据集

device = torch.accelerator.current_accelerator().type if torch.accelerator.is_available() else "cpu"

print(device)

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor()

)

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor()

)

- 将数据集转换为迭代器

train_dataloader = DataLoader(training_data, batch_size=64)

test_dataloader = DataLoader(test_data, batch_size=64)

- 定义神经网络模型

class NeuralNetwork(nn.Module):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.linear_relu_stack = nn.Sequential(

nn.Linear(28*28, 512),

nn.ReLU(),

nn.Linear(512, 512),

nn.ReLU(),

nn.Linear(512, 10)

)

def forward(self, x):

x = self.flatten(x)

logitc = self.linear_relu_stack(x)

return logitic

device = torch.accelerator.current_accelerator().type if torch.accelerator.is_available() else "cpu"

model = NeuralNetwork().to(device)

Step2. 定义超参数

超参数是可调整的参数,用来控制模型优化过程。不同的超参数值会影响模型训练和收敛速度。

通常情况下至少存在以下三个超参数:

- Number of Epochs : 迭代数据集的次数;

- Batch Size: 每次训练的样本数量;

- Learning Rate: 在每个批次/迭代中更新模型参数的程度。较小的值会导致学习速度变慢,而较大的值可能会导致训练期间的行为不可预测。

learning_rate = 1e-3

batch_size = 64

epochs = 5

Step3. 定义优化器与损失函数

一旦确定了超参数就可以使用优化循环来训练和优化模型。优化循环的每次迭代称为一个epoch。每个epoch由两个主要部分组成:

- The Train Loop:迭代训练数据集并尝试收敛到最佳参数;

- The Validation/Test Loop:迭代测试数据集以检查模型性能是否有所改善;

当训练数据时,未经训练的网络很大概率不会给出正确答案。损失函数所得结果与目标值的差值是我们在训练期间想要最小化的目标。为了计算损失,使用给定数据样本的输入进行推理,并将其与真实数据标签值进行比较。常见的损失函数包括用于回归任务的 nn.MSELoss(均方误差)和用于分类的 nn.NLLLoss(负对数似然)。nn.CrossEntropyLoss 结合了 nn.LogSoftmax 和 nn.NLLLoss 两者的功能。将模型的输出 logits 传递给 nn.CrossEntropyLoss,由它将对 logits 进行规范化并计算预测误差:

- 定义损失函数:

loss_fn = nn.CrossEntropyLoss()

- 定义优化器:

optimizer = torch.optim.SGD(model.parameters(), lr=learning_rate)

在训练循环中,优化分为三个步骤:

- 调用

optimizer.zero_grad()重置模型参数的梯度。默认情况下梯度会相加;为了防止重复计算,在每次迭代时明确将其归零; - 通过调用

loss.backward()反向传播预测损失。PyTorch 会存储相对于每个参数的损失梯度; - 一旦获得了梯度,调用

optimizer.step()来根据反向传递中收集的梯度调整参数。

Step4. 定义训练与测试循环

- 训练循环:

def train_loop(dataloader, model, loss_fn, optimizer):

size = len(dataloader)

model.train()

for batch, (X,y) in enumerate(dataloader):

# 计算loss

X,y = X.to(device), y.to(device)

pred = model(X)

loss = loss_fn(pred, y)

# 反向传播

loss.backward()

optimizer.step()

optimizer.zero_grad()

if batch % 100 == 0:

loss, current = loss.item(), batch*batch_size+len(X)

print(f"loss: {loss:>7f}, [{current:>5d}/{size:>5d}]")

- 测试循环:

def test_loop(dataloader, model, loss_fn):

model.eval()

size = len(dataloader)

num_batches = len(dataloader)

test_loss, correct = 0, 0

with torch.no_grad():

for X, y in dataloader:

X,y = X.to(device), y.to(device)

pred = model(X)

test_loss += loss_fn(pred, y).item()

correct += (pred.argmax(1) == y).type(torch.float).sum().item()

test_loss /= num_batches

correct /= size

print(f"Test Error: \n Accuracy: {(correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

Step5. 训练

epochs = 20

for t in range(epochs):

print(f"Epoch {t+1}/{epochs}\n------------------------")

train_loop(train_dataloader, model, loss_fn, optimizer)

test_loop(test_dataloader, model, loss_fn)

print("Done")