【深度学习】P1 神经网络、监督学习与深度学习、深度学习的驱动力量

神经网络、监督学习与深度学习、深度学习的驱动力量

- 神经网络

- 深度学习与监督学习

- 标准神经网络(Standard Neural Network)

- 卷积神经网络(Convolutional Neural Network)

- 循环神经网络(Recurrent Generative Network)

- 深度学习背后的驱动力量

- 数据 Data

- 算力 Computation

- 算法 Algorithm

神经网络

深度学习,一般指的是训练神经网络,有时是非常大(深)的神经网络。

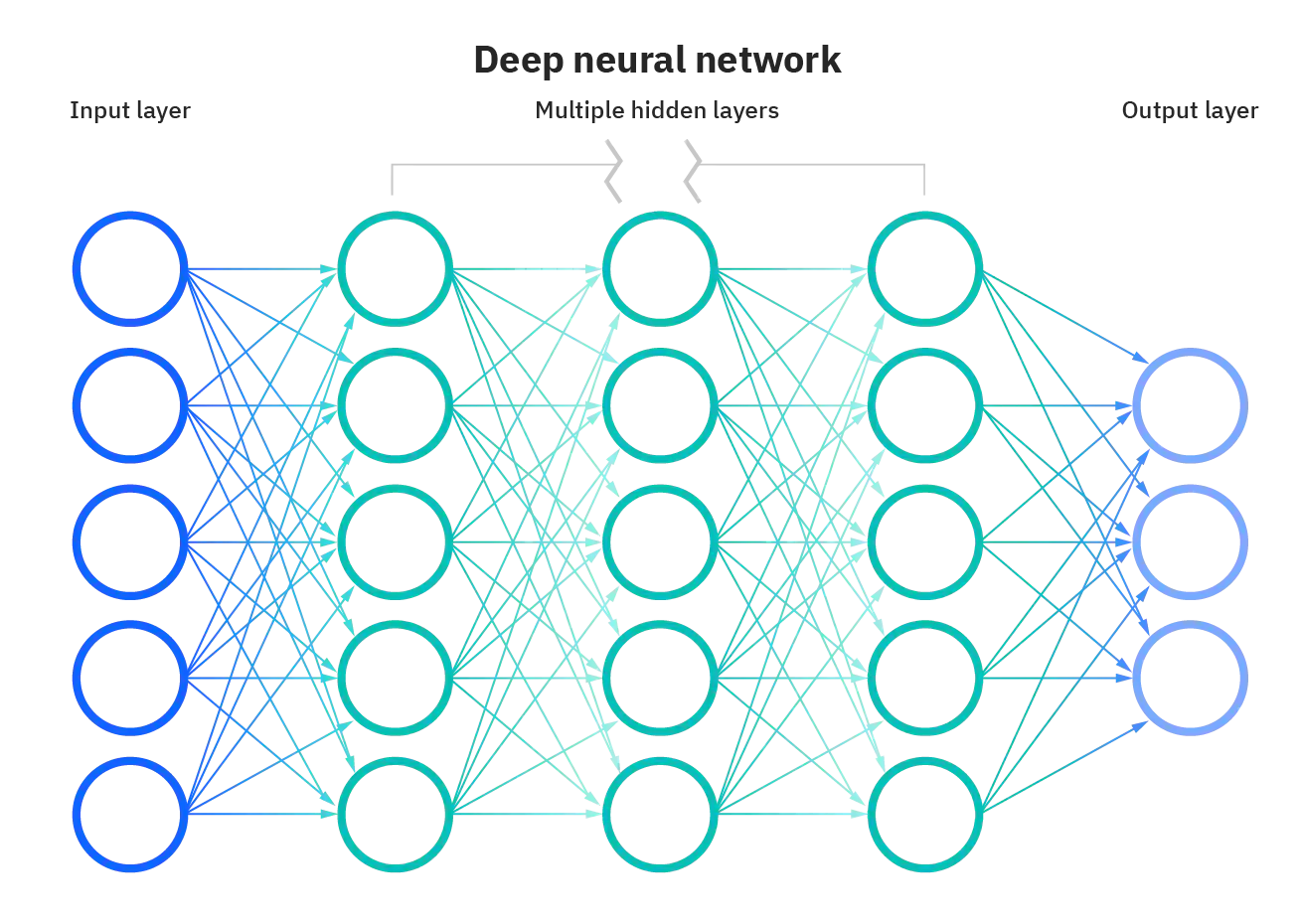

神经网络是一种计算模型,灵感来源于人类神经系统的结构和功能。它是由一系列相互连接的节点(简称“神经元” neural)组成。这些节点接收输入信号并通过连接的加权和激活函数生成输出信号。

一个典型的神经网络通常由三个类型的神经元层组成:输入层(input layer)、隐藏层(hidden layer)和输出层(output layer)。输入层接收原始数据作为输入,隐藏层进行各种复杂的变换和计算,输出层产生最终的预测或者分类结果。在训练过程中,神经网络通过调整连接的权重和偏差来最小化损失函数,从而使得模型的预测结果更加准确。

深度学习与监督学习

监督学习是深度学习最常见的应用之一,需要大量的标注数据集,通过训练深度神经网络,使得网络可以对未知的数据进行预测和分类。

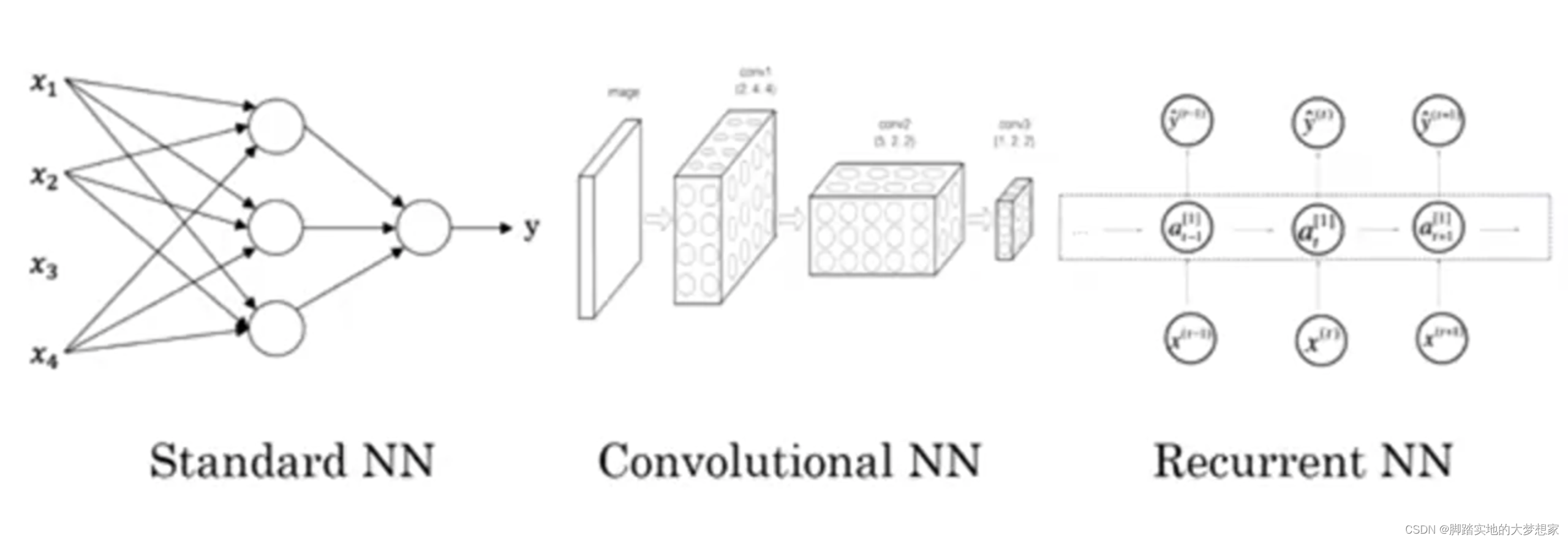

深度学习在监督学习领域的范畴可以分为:标准神经网络(Standard NN),卷积神经网络(CNN),循环神经网络(RNN)。

标准神经网络(Standard Neural Network)

标准神经网络,又称多层感知器,属于深度学习领域监督学习范畴。由多个神经网络层组成,每个神经网络层由多个神经元组成,并且每个神经元都与前一层的所有神经元相连。

在标准神经网络中,输入数据会经过一系列的隐藏层,最终输出一个或者多个预测结果。在监督学习中,标准神经网络的训练需要提供输入数据及其对应的标签,通过反向传播算法计算损失并更新权重参数,使得神经网络能够更好的拟合训练数据。

标准神经网络广泛应用于图像分类,语音识别,自然语言处理等任务,是深度学习领域中最为基础和重要的模型。

卷积神经网络(Convolutional Neural Network)

卷积神经网络,属于深度学习领域监督学习范畴。

卷积神经网络主要用于图像识别、语音识别、自然语言处理等任务。CNN的输入是二维的图像数据,通过卷积、池化等操作来提取图像特征,然后通过全连接层将特征映射到输出类别上。在训练过程中,CNN通过反向传播算法来更新网络中的权重参数,使得网络能够更好的拟合训练数据。

循环神经网络(Recurrent Generative Network)

循环神经网络,属于深度学习领域监督学习范畴。

循环神经网络主要用于处理序列数据,例如自然语言文本、音频、时间序列等。RNN中的隐藏层状态会保存历史数据,通过时间步的不断迭代,可以处理不同长度的序列数据。

在监督学习中,RNN的训练需要提供输入序列和对应的标签序列,通过反向传播算法计算损失并更新权重参数。通常情况下,RNN的目标是最小化输出序列与标签序列之间的差异,例如采用交叉熵损失函数。

总结来说:

标准神经网络:由多个全连接层组成,每个层的所有神经元都与上一层的所有神经元相连;

标准神经网络常用于处理结构化数据。

卷积神经网络:由卷积层、池化层和全连接层组成,用于处理具有网格结构的数据,如图像和语音;

卷积层通过卷积操作来提取图像特征,池化层用于降采样,全连接层用于分类。

循环神经网络:通过循环操作来处理序列数据,序列数据如文本或语音;

循环操作使得每个时间步的输出都与之前的状态有关。RNN中长短时记忆网络(LSTM),和门控循环单元(GRU)等模型在序列建模中广泛应用。

深度学习背后的驱动力量

数据,算力与算法。

数据 Data

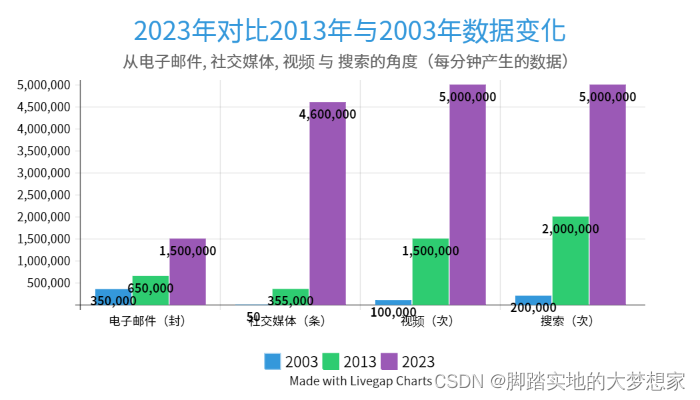

现今,人类每分钟产生的数据可参照如下:

- 电子邮件:全球每分钟发送的电子邮件数量为 150万封,其中70%是垃圾邮件;

- 社交媒体:全球每分钟上传到 FaceBook 上的照片数量约为 350万张,上传到 Instagram 上的照片数量约为 60万张,发送到 Twitter 上的推文数量约为 50万条。

- 视频:每分钟上传到 YouTube 上的视频数量约为 500小时;

- 搜索:全球每分钟进行的 Google 搜索数量约为 400万次;

- 传感器等;

综上所属,现今人类比较10年前,每分钟产生的数据的数量级都发生了变化。拥有大量的数据,我们才能训练出准确的模型。

算力 Computation

伴随着 GPU 和 TPU 等专用加速器的出现和发展,深度学习的计算能力得到了大幅度的提升,加速了深度学习算法的训练和推理过程。

图片来源于 2016年,英伟达将全球首款人工智能专用GPU献给OpenAI公司

算法 Algorithm

相较于传统的机器学习算法,深度学习算法可以自动地从数据中学习到高层次的特征表示,并具有更强的泛化能力。这些优势使得深度学习在图像识别、自然语言处理、语音识别等领域取得了巨大的成功,促进了深度学习算法的不断发展。

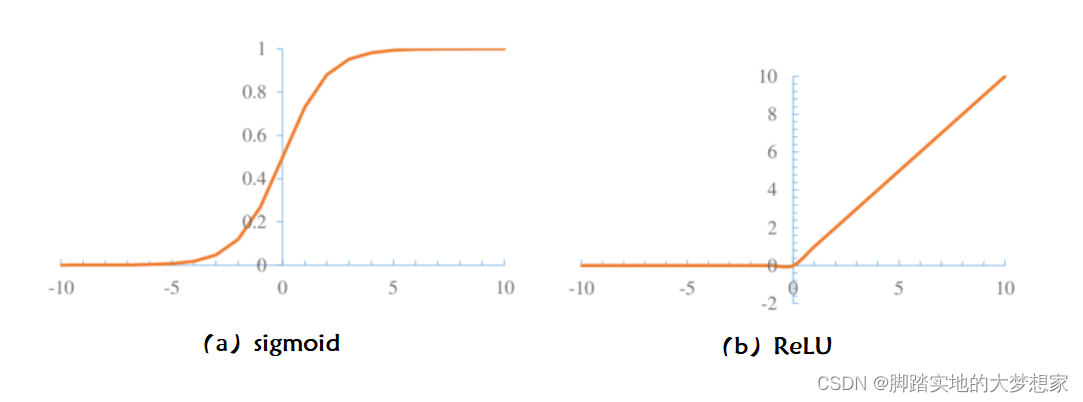

e . g . e.g. e.g. 算法优化的举例,常常都是 Sigmoid 到 ReLU

- 形状

- 性质

Sigmoid 函数优点是连续可导;缺点是梯度在输入值较小和输出值较大的请款修改会变得很小,导致梯度消失现象,会影响神经网络的训练效果;

ReLU 函数优点是在输入为正的情况下导数恒为1,从而避免了梯度消失现象,并且计算速度非常快。缺点是输入为负数时导数为0,意味着一旦输入为负,神经元不会对神经网络的输出产生任何影响,导致“死亡ReLU”问题。