双交叉注意学习用于细粒度视觉分类和目标重新识别

目录

- Dual Cross-Attention Learning for Fine-Grained Visual Categorization and Object Re-Identification

- 摘要

- 本文方法

- 消融实验

Dual Cross-Attention Learning for Fine-Grained Visual Categorization and Object Re-Identification

摘要

目的:

探索了如何扩展自注意模块,以更好地学习识别细粒度对象的微妙特征嵌入,例如,不同的鸟类物种或人的身份。

方法:

提出了一种双交叉注意学习(DCAL)算法来协调自注意学习。

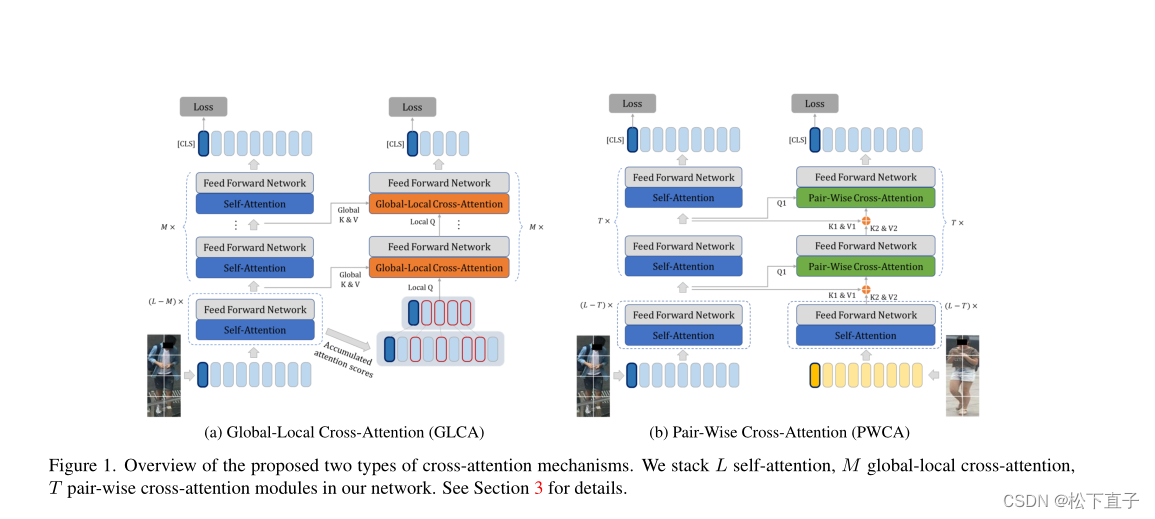

- 首先,提出了全局-局部交叉注意(GLCA)来增强全局图像与局部高响应区域之间的相互作用,这有助于增强识别的空间识别线索。

- 其次,提出了成对交叉注意(PWCA)来建立图像对之间的相互作用。PWCA可以通过将另一幅图像作为干扰物来规范图像的注意力学习,并在推理过程中被移除。

我们观察到DCAL可以减少误导注意力,分散注意反应,发现更多的互补部分进行识别。

论文链接

本文方法

GLCA

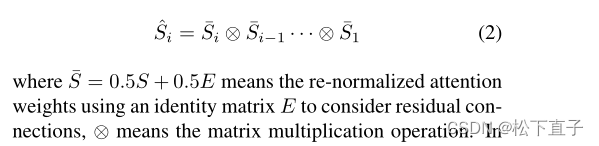

首先,按照注意rollout计算第i个块的累计注意得分:

然后从Query中选取对应于CLS累积权重中最高的前R个,构造一个新的查询矩阵Ql,表示最关注的局部token。

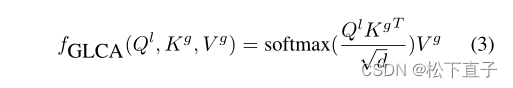

所选局部query与全局key-value对之间的交叉注意,如下所示:

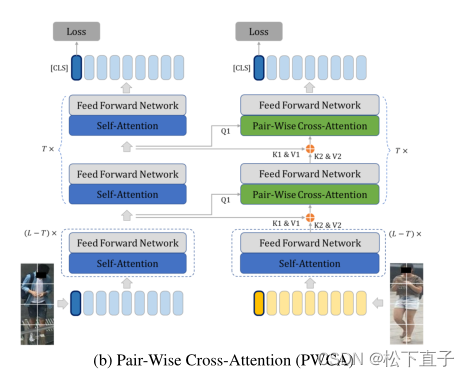

PWCA

一种新的正则化方法来正则化注意力学习,从相同的训练集中随机抽取两张图像(I1, I2)来构建这对图像

查询、键和值向量分别为一对图像的两个图像计算

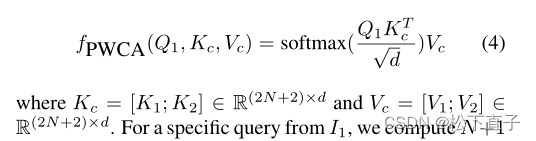

对于训练I1,我们将两个图像的键值矩阵进行拼接,然后计算目标图像的查询与键值对之间的注意力

计算l1自身N+1个自注意得分,以及与计算I2的N+1个自注意得分,以及与I2的N+1个交叉注意得分。

减少了对样本特定特征的过拟合

使用T = 12 PWCA块。请注意,PWCA仅用于训练,在不消耗额外计算成本的情况下将被移除用于推断。

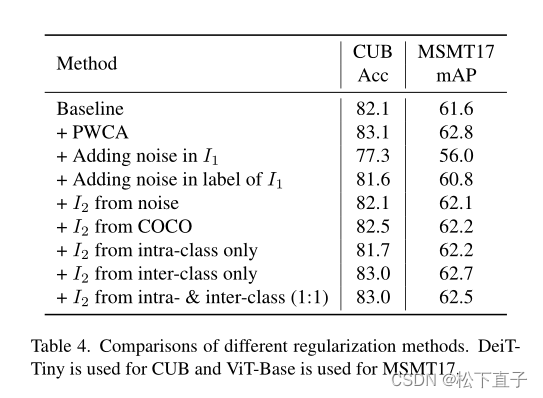

消融实验