吴恩达《机器学习》9-1:代价函数

一、引入新标记方法

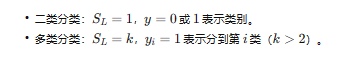

首先,引入一些新的标记方法,以便更好地讨论神经网络的代价函数。考虑神经网络的训练样本,其中每个样本包含输入 x 和输出信号 y。我们用 L 表示神经网络的层数,![]() 表示每层的神经元个数(

表示每层的神经元个数(![]() 表示输出层神经元个数)。对于分类问题,将神经网络的分类定义为两种情况:二类分类和多类分类。

表示输出层神经元个数)。对于分类问题,将神经网络的分类定义为两种情况:二类分类和多类分类。

二、代价函数的变化

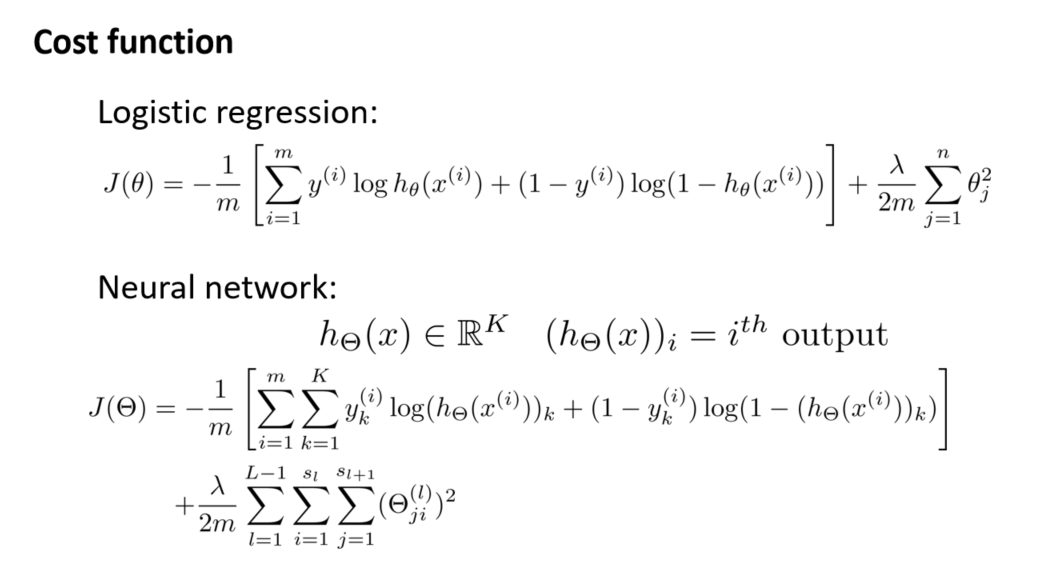

回顾逻辑回归问题中的代价函数,有:

![]()

在神经网络中,输出变量和因变量都是向量,因此代价函数更为复杂:

这个代价函数考虑了每个样本的每个类别的预测,并通过嵌套的求和来处理不同层的权重。最后一项是正则化项,用于排除每一层的偏置项后,每一层的权重矩阵的平方和。

三、正则化的重要性

正则化项在神经网络中同样发挥着重要作用,帮助防止过拟合。通过惩罚权重矩阵中的大值,可以有效地控制模型的复杂性,提高其泛化能力。

通过代价函数,能够观察算法预测结果与实际情况的误差,为调整模型参数提供有力的指导。深入理解神经网络代价函数的结构和作用,有助于更好地理解模型的训练过程和性能评估。

参考资料:

[中英字幕]吴恩达机器学习系列课程

黄海广博士 - 吴恩达机器学习个人笔记