Omost容器构建教程

一、介绍

GitHub - lllyasviel/Omost:你的图像快到了!

Omost 是一个将 LLM 的编码能力转换为图像生成(或更准确地说,图像合成)能力的项目。“O”代表“omni”多模态,象征着项目支持多种形式的输入与输出,而“most”则表达了项目致力于最大化挖掘 LLM 模型潜力的决心,力求从每一个细节中释放出最多的图像生成可能性。作为 ControlNet 作者倾力打造的创新项目,标志着图像生成技术的一次革命性飞跃。该项目巧妙地将大型语言模型(LLM)的强大编码能力转化为直观且高效的图像生成能力,为用户带来前所未有的创作体验。

二、特点

用户只需通过简单的语言或提示词描述他们想要的画面,虚拟画布代理便能理解并转化为相应的视觉指令代码,通过全局描述和局部描述来定义图像特征。随后,这些指令会被传输给特定的图像生成器,后者负责将代码转换为惟妙惟肖的图像。用户还可以通过交互式编辑更改描述,进行代码重新编写。

Omost 提供了 LLM 模型,这些模型将编写代码,以使用 Omost 的虚拟代理来组合图像视觉内容。这可以通过图像生成器的特定实现来呈现,以实际生成图像。目前,提供了 3 个基于 Llama3 和 Phi3 变体的预训练 LLM 模型。

所有模型都使用混合数据进行训练:

(1)包括 Open-Images 在内的多个数据集的地面实况注释,

(2)通过自动注释图像提取数据,

(3)来自 DPO(直接偏好优化,“代码是否可以由 python 3.10 编译”作为直接偏好)的强化,

(4)来自 OpenAI GPT4o 多模态功能的少量调整数据。

三、容器构建

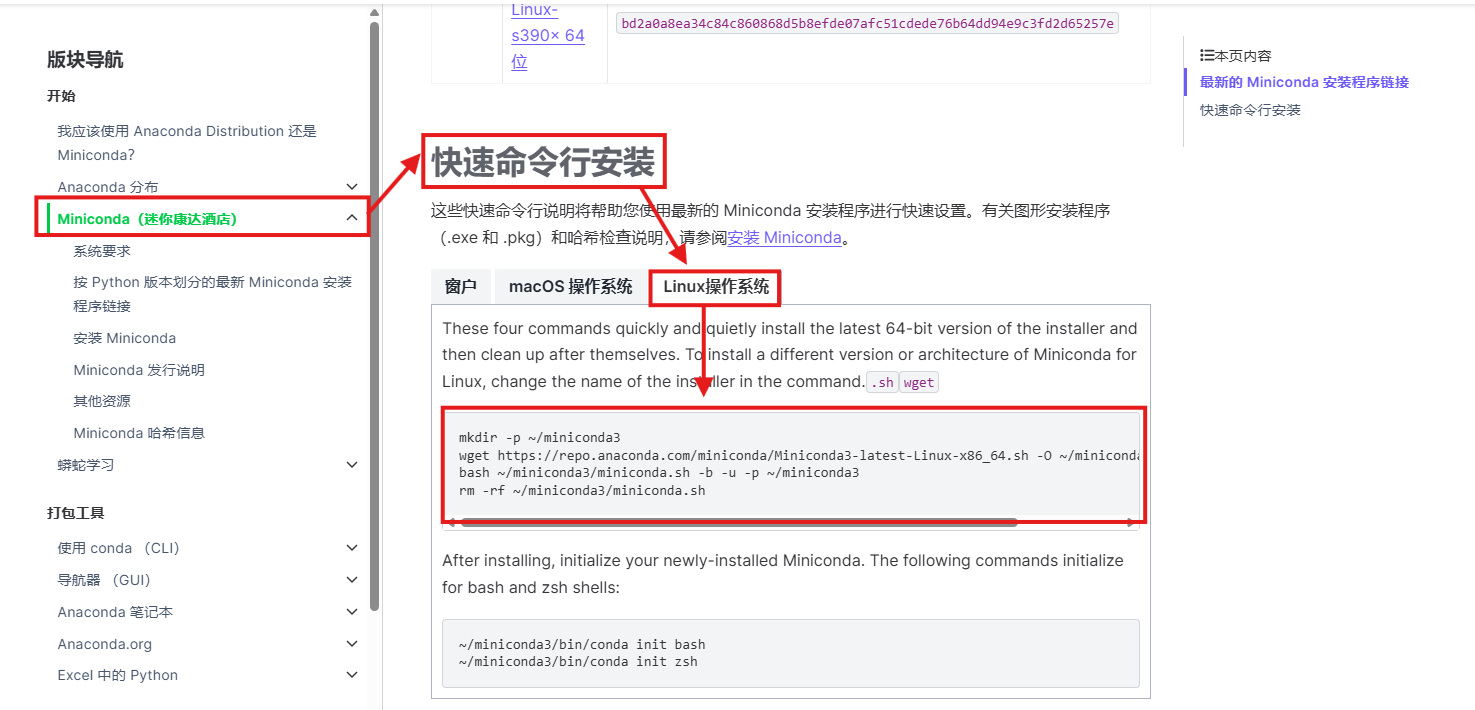

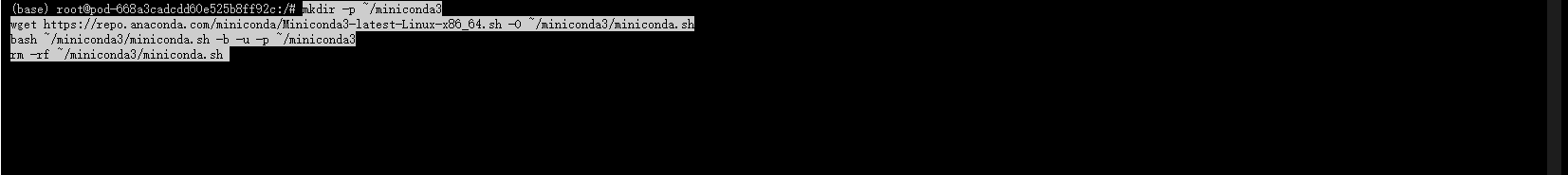

1. 安装miniconda

进入Anaconda官网:

Miniconda — Anaconda 文档

找到快速命令行安装,选择Linux系统,复制代码进入终端中进行安装。

等待安装完成。

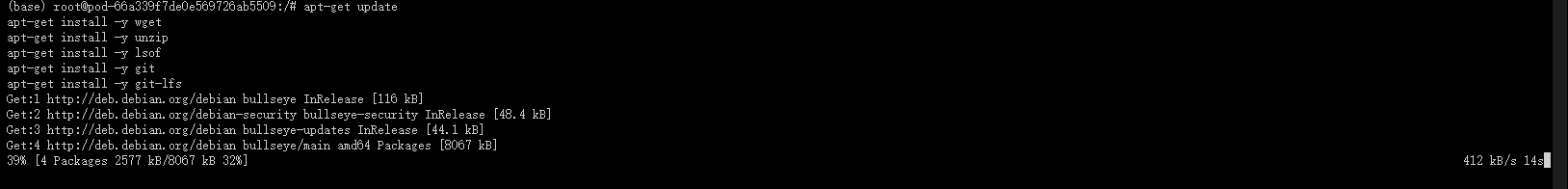

2. 安装并更新基础命令,供后续使用更快捷: wget、unzip、lsof、git、git-lfs

apt-get update

apt-get install -y wget

apt-get install -y unzip

apt-get install -y lsof

apt-get install -y git

apt-get install -y git-lfs

3. 项目配置

(1)克隆项目,需要科学上网并且之后包的下载容易出错(不建议)。

#git clone https://github.com/lllyasviel/Omost.git

(2)运用国内的项目能成功运行

直接输入 git clone https://github.com/xhoxye/Omost_CN 直接下载至相应地址。

如果拉取不上来就手动进入网站下载压缩包上传至终端解压。

https://github.com/xhoxye/Omost_CN

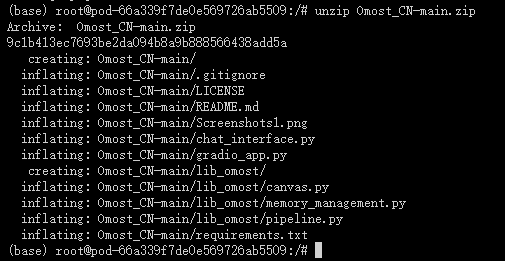

unzip Omost_CN-main.zip

解压完成

(3)打开Omost_CN-main项目文件

cd Omost_CN-main

(4)创建python为3.10版本的虚拟环境,名称为omost

conda create -n omost python=3.10

遇到下列代码行时输入y回车后将继续创建

(5)激活虚拟环境omost

conda activate omost

(6)通过pip安装所需的torch环境(国内镜像源快一些,以下使用了清华源)

pip install torch torchvision --index-url https://download.pytorch.org/whl/cu121 -i https://pypi.tuna.tsinghua.edu.cn/simple

(7)安装项目依赖文件

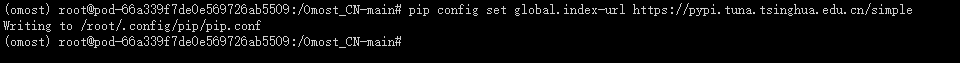

为了安装速度更快可以将pip进行永久换源

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

pip install -r requirements.txt

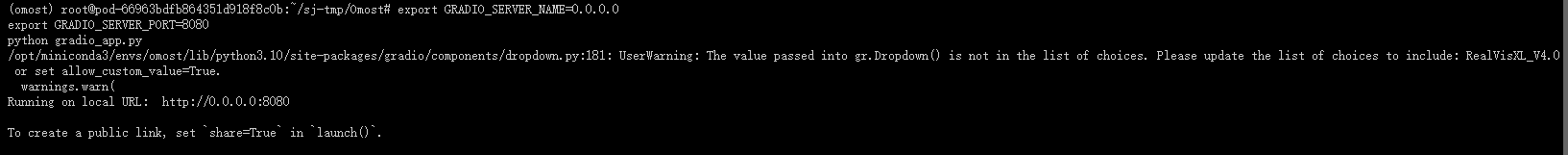

(8)指定端口,运行py文件

export GRADIO_SERVER_NAME=0.0.0.0

export GRADIO_SERVER_PORT=8080

python gradio_app.py

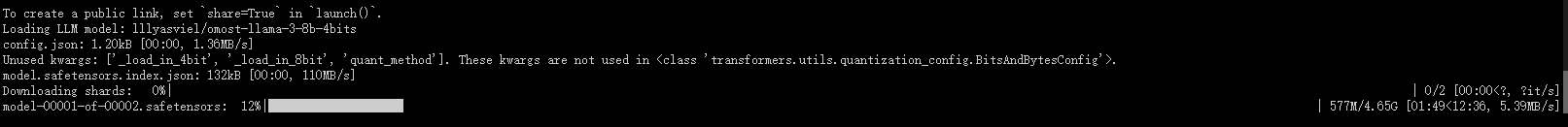

出现以下页面代表运行成功:

第一次在端口界面运行时,需要等待自动下载模型包(比较多大概需要一小时左右请耐心等待),下包的进度会在终端显示,下载完成后回到web界面就会开始出现结果。由于需要反复在 GPU 内加载 LLM 和 SDXL 大模型,因此运行模型出图速度比较慢,用 RTX3060 显卡进行运行,时间大概在八分钟左右。

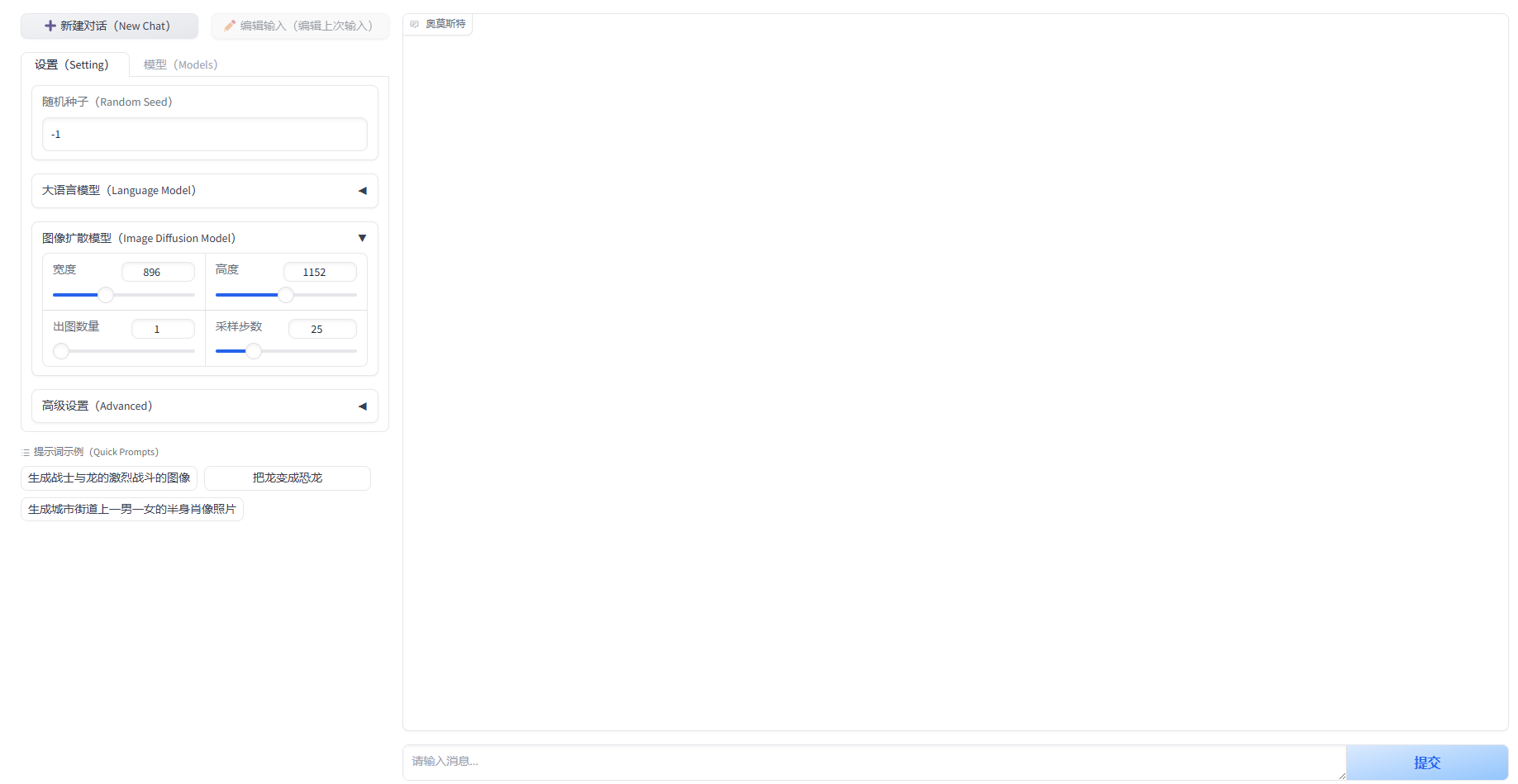

四、网页演示

运行成功后获取访问链接,进入 webUI 界面后即可操作: