deepseek本地部署及可视化输入

deepseek本地部署及可视化输入

- 0 引言

- 1 安装ollama

- 2 下载并运行DeepSeek模型

- 3 在Chatbox中接入Deepseek

- 4 结语

0 引言

💻💻AI一下💻💻

先了解下什么是deepseek:

DeepSeek 是一家专注于人工智能技术研发的公司,致力于打造高性能、低成本的 AI 模型。它的目标是让 AI 技术更加普惠,让更多人能够用上强大的 AI 工具。

DeepSeek具有国产化、开源、普惠 AI的特点。它是自主研发的 AI 模型,打破了国外技术垄断,为国内企业和开发者提供了更多选择;它支持本地部署,让开发者可以自由定制和优化模型;相比国外模型(如 GPT-4o),它的使用成本更低,适合中小企业和个人开发者。

性能上DeepSeek-V3模型有 6710 亿个参数(671B),虽然只激活了 370 亿参数(37B),但它的表现已经非常接近国际顶尖模型。在知识问答、长文本处理、代码生成、数学能力等方面,DeepSeek-V3 都展现出了强大的实力。

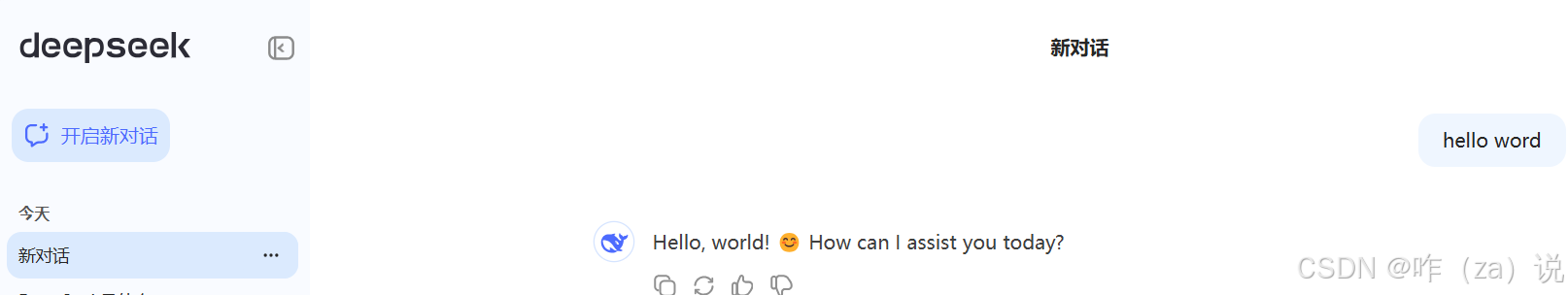

本篇结合网上资料,整理并分享本地部署deepseek的过程。在部署之前可以在deepseek官网先了解下deepseek AI大模型。官网支持在线提问,提供手机app下载方式,方便在移动端使用deepseek资源。进入官网如下图界面,直接点击开始对话就能开始提问,利用AI帮你解惑。

1 安装ollama

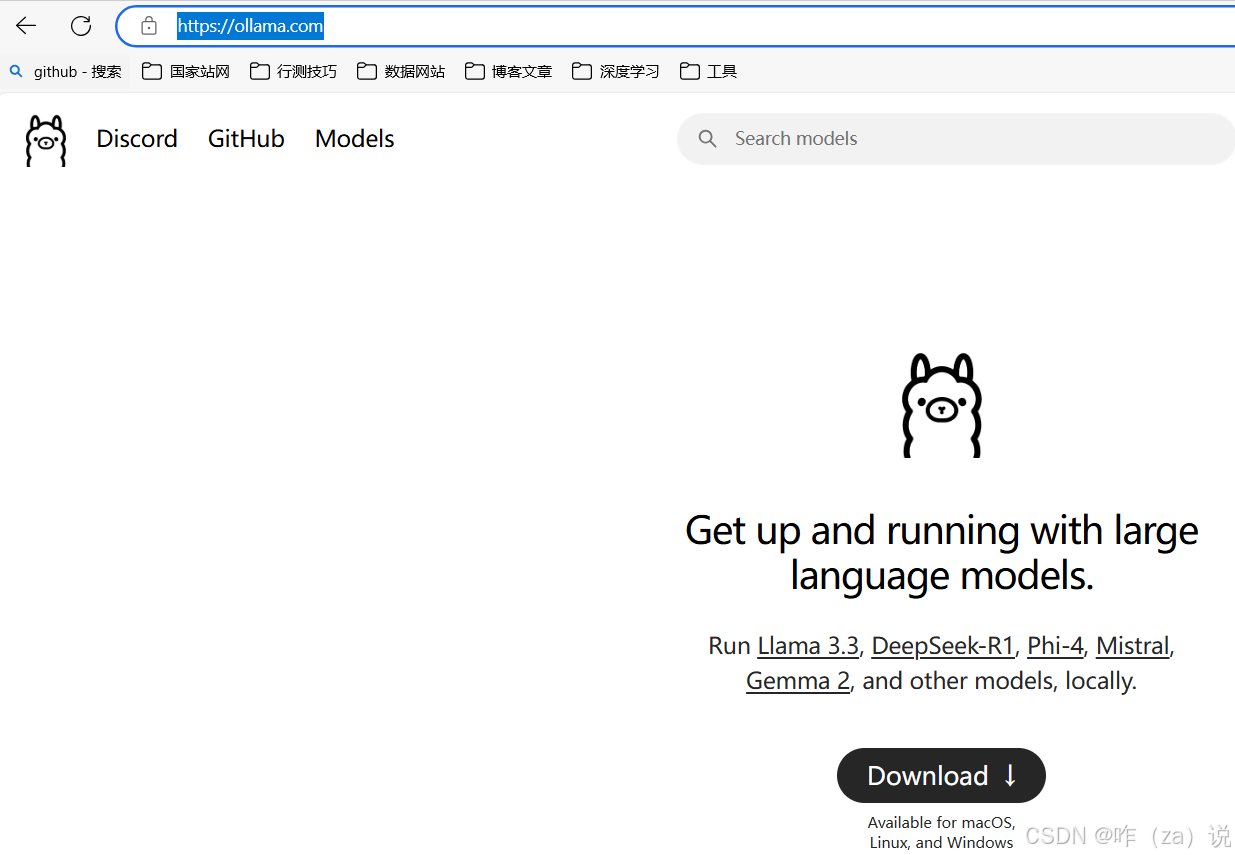

(1)进入ollama官网,下载安装程序,该安装程序下载过程较慢,有需要的可以在资源中获取;

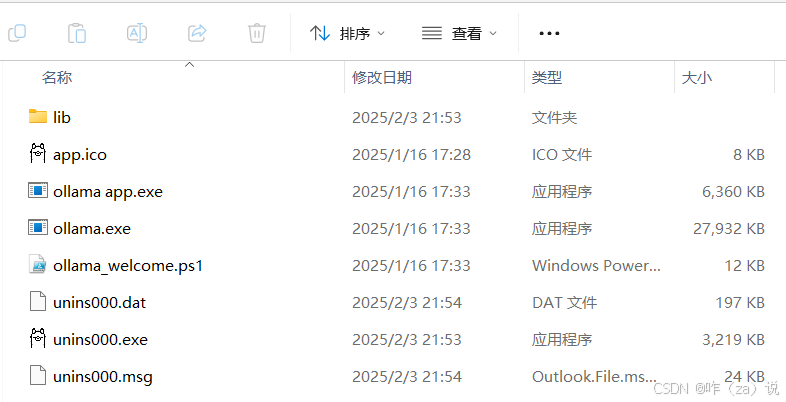

(2)安装Ollama,最简单的方法是双击OllamaSetup.exe,Ollama会被自动安装到系统盘中 [推荐] 。如果系统盘内存不足,可以使用下面命令将Ollama安装到自定义位置。安装完成后在安装目录中能看到下面文件。

(1) win+R进入cmd窗口

(2) cd 到OllamaSetup.exe所在的路径

(3) 执行命令 OllamaSetup.exe /DIR="自定义安装位置"

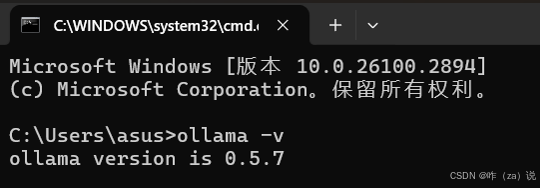

(3) 安装完成之后通过命令(ollama -v),查看安装是否成功,当成功显示ollama的版本号时说明ollama已经安装完成,可以开始下一步操作了。

2 下载并运行DeepSeek模型

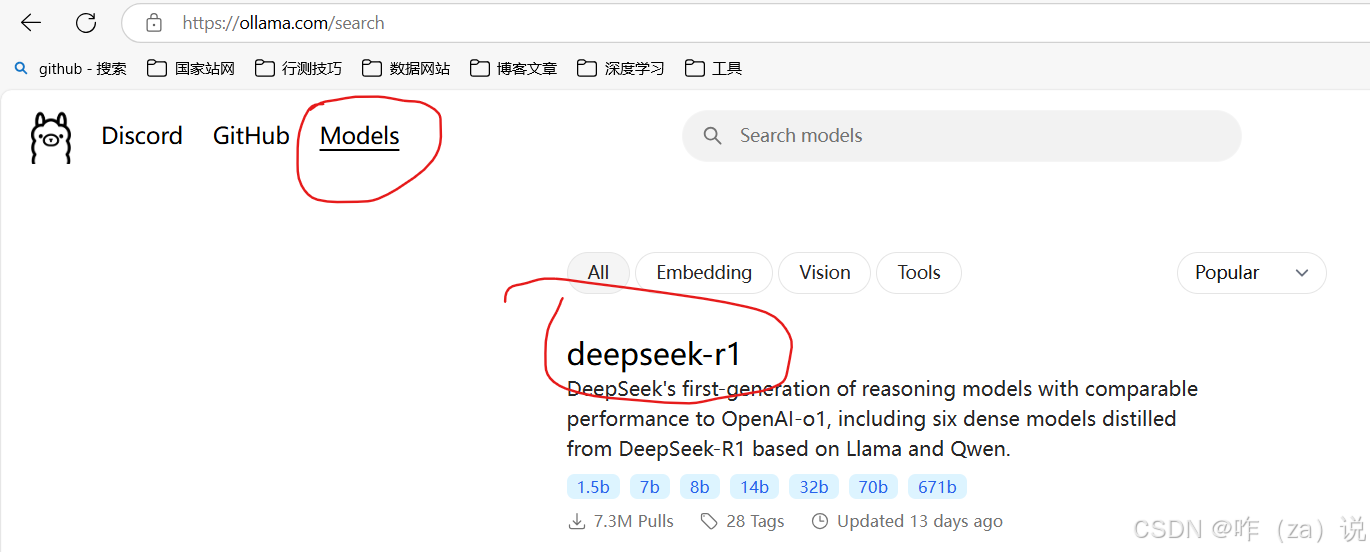

还是在ollama官网,点击Models标签,然后找到并进入我们需要的大模型,这里选择下图的deepseek-r1。

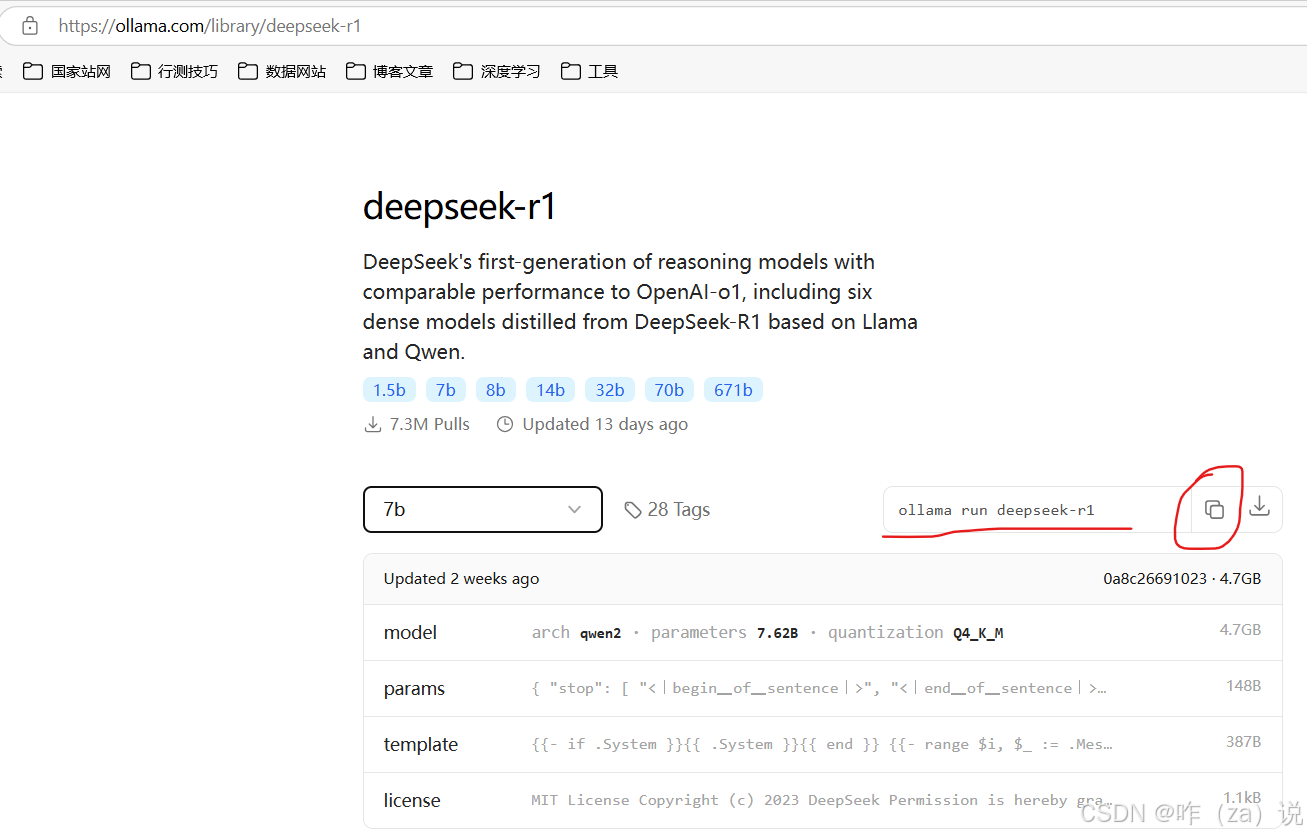

进到下面界面后,根据自己电脑的配置选择一种模型,然后复制对应语句,在CMD窗口回车执行;

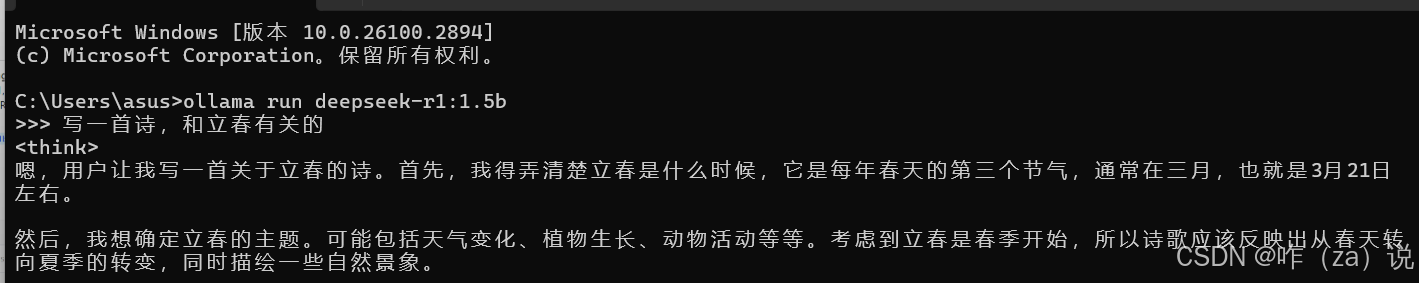

示例语句:ollama run deepseek-r1:1.5b

执行完成之后就实现了deepseed与ollama的关联,就可以在命令窗口中进行一些提问了。deepseed是具有推理能力的一种模型,所给的提问越具体,得到的结果越准确。

3 在Chatbox中接入Deepseek

每次在黑框框中进行提问前都要先用命令启动deepseek模型,不符合大众使用习惯,所以这一部分,在Chatbox中接入Deepseek API,充分发挥Chatbox和Deepseek的优势,提高提问效率。下面是主要过程:

(1) 获取Chatbox: 打开Chatbox网站,界面如下,直接免费下载需要的版本。

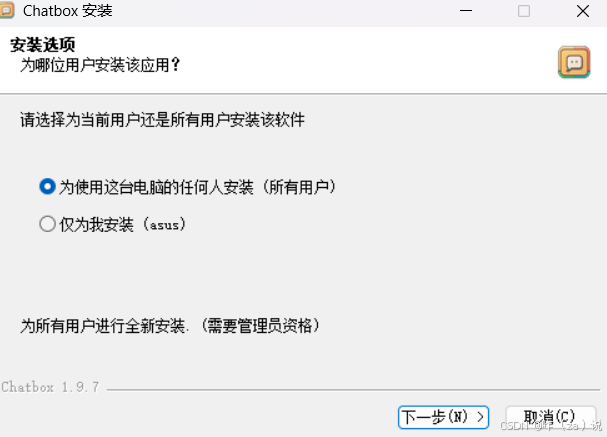

(2) Chatbox安装:安装较为简单,没有特别需要注意的地方,可以将软件安装到自定义路径。

(3) 打开软件,界面如下。左下角点击 “设置”, 切换到“模型”标签。在模型提供方选择 “OLLAMA API”,填写对应的 API 域名(选择模型后会自动填充 )。从模型下拉菜单中选定 “deepseek - r1:7b”,并根据需求调整上下文消息数量上限(如设为 20)和严谨与想象程度(Temperature,如设为 0.7),完成后点击 “保存”。

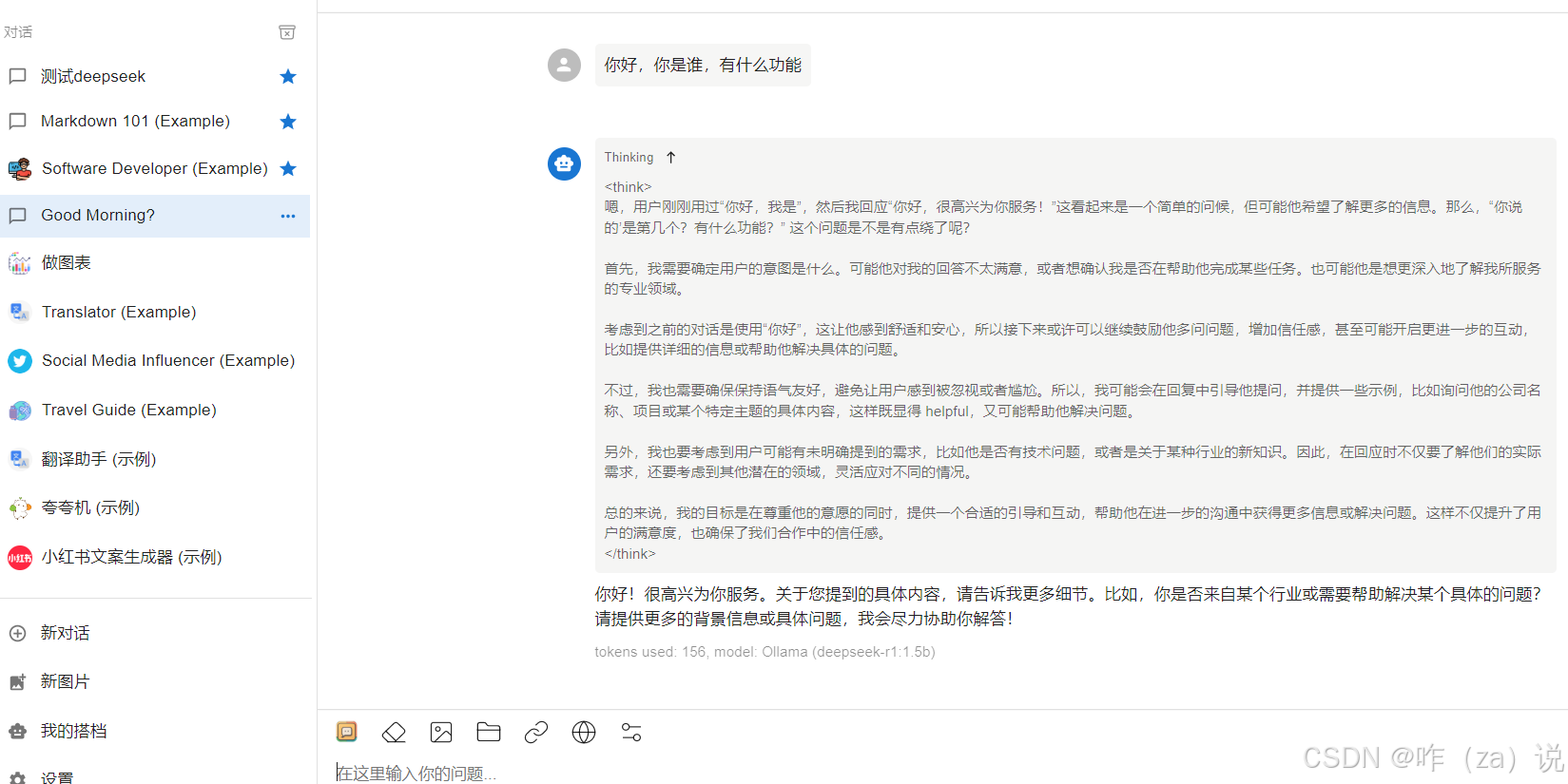

(4) 上面设置完成后,在对话窗口中就可以开始提问了。如果在ChatBox中进行提问时长时间未反映,可以将deepseek的更换为占用较小的 “deepseek - r1:1.5b”。如果出现deepseek API调用失败的问题,需要对流程进行重新尝试。

4 结语

本篇简单梳理了deepseed本地部署的有关过程,进行了尝试可以在本地进行提问。希望对你有所帮助。

😜

😜😜

😜😜😜😜