NLP实战:基于Pytorch的文本分类入门实战

目录

一、前期准备

1.环境准备

2.加载数据

二、代码实战

1.构建词典

2.生成数据批次和迭代器

3. 定义模型

4. 定义实例

5.定义训练函数与评估函数

6.拆分数据集并运行模型

三、使用测试数据集评估模型

四、总结

这是一个使用PyTorch实现的简单文本分类实战案例。在这个例子中,我们将使用AG News数据集进行文本分类。

文本分类一般分为语料库、文本清晰、分词、文本向量化和建模这五步。

一、前期准备

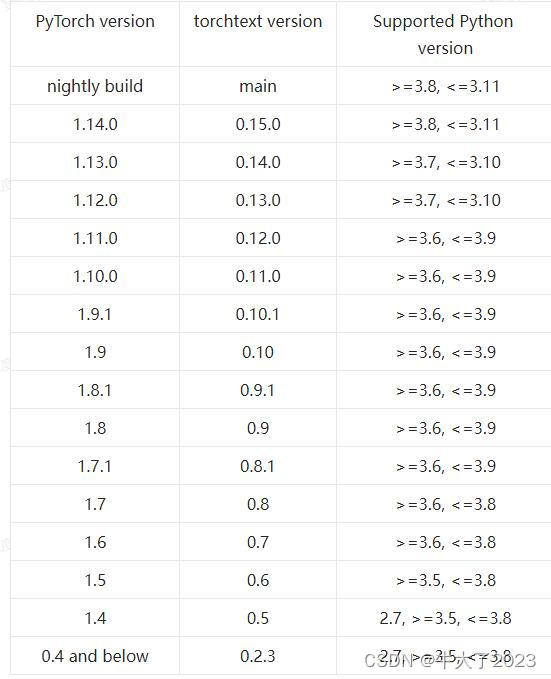

1.环境准备

做nlp项目建议anaconda专门新建一个环境,首先安装torchtext与portalocker库

我用的版本号是:

●torchtext==0.15.1

●portalocker==2.7.0

注:相近版本也可,不必完全一致

安装参考:

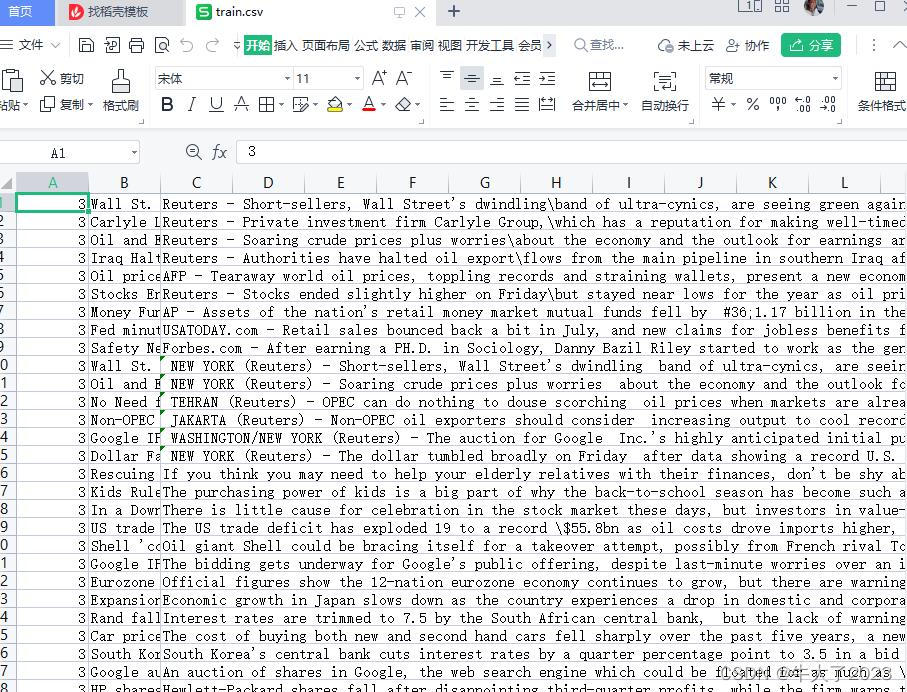

AG News(AG’s News Topic Classification

Dataset)是一个广泛用于文本分类任务的数据集,尤其是在新闻领域。该数据集是由AG’s Corpus of News

Articles收集整理而来,包含了四个主要的类别:世界、体育、商业和科技

2.加载数据

像以前的目标检测项目一样,调用gpu

import torch

import torch.nn as nn

import torchvision

from torchvision import transforms, datasets

import os,PIL,pathlib,warnings

warnings.filterwarnings("ignore") #忽略警告信息

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(device)cuda

from torchtext.datasets import AG_NEWS

train_iter = AG_NEWS(split='train') # 加载 AG News 数据集可以在对应目录下查看内容(我的是C:\Users\Chen02\.cache\torch\text\datasets\AG_NEWS

二、代码实战

1.构建词典

from torchtext.data.utils import get_tokenizer

from torchtext.vocab import build_vocab_from_iterator

tokenizer = get_tokenizer('basic_english') # 返回分词器函数,训练营内“get_tokenizer函数详解”一文

def yield_tokens(data_iter):

for _, text in data_iter:

yield tokenizer(text)

vocab = build_vocab_from_iterator(yield_tokens(train_iter), specials=["<unk>"])

vocab.set_default_index(vocab["<unk>"]) # 设置默认索引,如果找不到单词,则会选择默认索引

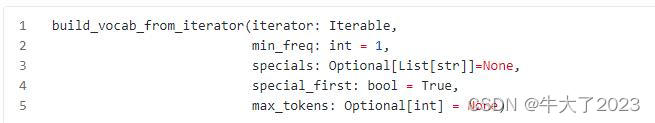

.build_vocab_from_iterator()函数详解

torchtext.vocab.build_vocab_from_iterator 这个函数的作用是从一个可迭代对象中统计token的频次,并返回一个vocab(词汇字典)

上述是官网API接口的定义形式,参数有五个,返回值是Vocab类型实例,五个参数分别是:

●iterator:一个用于创建vocab(词汇字典)的可迭代对象。

●min_freq:最小频数。只有在文本中出现频率大于等于min_freq的token才会被保留下来

●specials:特殊标志,字符串列表。用于在词汇字典中添加一些特殊的token/标记,比如最常用的'<unk>',用于代表词汇字典中未存在的token,当然也可以用自己喜欢的符号来代替,具体的意义也取决于用的人。

●special_first:表示是否将specials放到字典的最前面,默认是True

●max_tokens:即限制一下这个词汇字典的最大长度。且这个长度包含的specials列表的长度

print(vocab(['here', 'is', 'an', 'example']))[475, 21, 30, 5297]

text_pipeline = lambda x: vocab(tokenizer(x))

label_pipeline = lambda x: int(x) - 1

print(text_pipeline('here is the an example'))[475, 21, 2, 30, 5297]

print(label_pipeline('10'))9

2.生成数据批次和迭代器

from torch.utils.data import DataLoader

def collate_batch(batch):

label_list, text_list, offsets = [], [], [0]

for (_label, _text) in batch:

# 标签列表

label_list.append(label_pipeline(_label))

# 文本列表

processed_text = torch.tensor(text_pipeline(_text), dtype=torch.int64)

text_list.append(processed_text)

# 偏移量,即语句的总词汇量

offsets.append(processed_text.size(0))

label_list = torch.tensor(label_list, dtype=torch.int64)

text_list = torch.cat(text_list)

offsets = torch.tensor(offsets[:-1]).cumsum(dim=0) #返回维度dim中输入元素的累计和

return label_list.to(device), text_list.to(device), offsets.to(device)

# 数据加载器

dataloader = DataLoader(train_iter,

batch_size=8,

shuffle =False,

collate_fn=collate_batch)

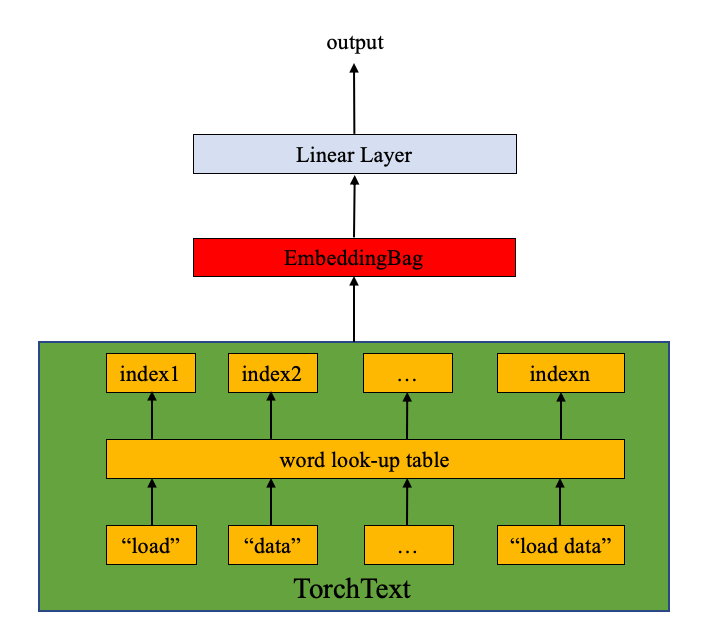

3. 定义模型

这里我们定义TextClassificationModel模型,首先对文本进行嵌入,然后对句子嵌入之后的结果进行均值聚合。

from torch import nn

class TextClassificationModel(nn.Module):

def __init__(self, vocab_size, embed_dim, num_class):

super(TextClassificationModel, self).__init__()

self.embedding = nn.EmbeddingBag(vocab_size, # 词典大小

embed_dim, # 嵌入的维度

sparse=False) #

self.fc = nn.Linear(embed_dim, num_class)

self.init_weights()

def init_weights(self):

initrange = 0.5

self.embedding.weight.data.uniform_(-initrange, initrange)

self.fc.weight.data.uniform_(-initrange, initrange)

self.fc.bias.data.zero_()

def forward(self, text, offsets):

embedded = self.embedding(text, offsets)

return self.fc(embedded)

self.embedding.weight.data.uniform_(-initrange, initrange)这段代码是在 PyTorch 框架下用于初始化神经网络的词嵌入层(embedding layer)权重的一种方法。这里使用了均匀分布的随机值来初始化权重,具体来说,其作用如下:

1 self.embedding: 这是神经网络中的词嵌入层(embedding layer)。词嵌入层的作用是将离散的单词表示(通常为整数索引)映射为固定大小的连续向量。这些向量捕捉了单词之间的语义关系,并作为网络的输入。

2 self.embedding.weight: 这是词嵌入层的权重矩阵,它的形状为 (vocab_size, embedding_dim),其中 vocab_size 是词汇表的大小,embedding_dim 是嵌入向量的维度。

3 self.embedding.weight.data: 这是权重矩阵的数据部分,我们可以在这里直接操作其底层的张量。

4 .uniform_(-initrange, initrange): 这是一个原地操作(in-place operation),用于将权重矩阵的值用一个均匀分布进行初始化。均匀分布的范围为 [-initrange, initrange],其中 initrange 是一个正数。

通过这种方式初始化词嵌入层的权重,可以使得模型在训练开始时具有一定的随机性,有助于避免梯度消失或梯度爆炸等问题。在训练过程中,这些权重将通过优化算法不断更新,以捕捉到更好的单词表示。

4. 定义实例

num_class = len(set([label for (label, text) in train_iter]))

vocab_size = len(vocab)

em_size = 64

model = TextClassificationModel(vocab_size, em_size, num_class).to(device)

5.定义训练函数与评估函数

import time

def train(dataloader):

model.train() # 切换为训练模式

total_acc, train_loss, total_count = 0, 0, 0

log_interval = 500

start_time = time.time()

for idx, (label, text, offsets) in enumerate(dataloader):

predicted_label = model(text, offsets)

optimizer.zero_grad() # grad属性归零

loss = criterion(predicted_label, label) # 计算网络输出和真实值之间的差距,label为真实值

loss.backward() # 反向传播

optimizer.step() # 每一步自动更新

# 记录acc与loss

total_acc += (predicted_label.argmax(1) == label).sum().item()

train_loss += loss.item()

total_count += label.size(0)

if idx % log_interval == 0 and idx > 0:

elapsed = time.time() - start_time

print('| epoch {:1d} | {:4d}/{:4d} batches '

'| train_acc {:4.3f} train_loss {:4.5f}'.format(epoch, idx, len(dataloader),

total_acc/total_count, train_loss/total_count))

total_acc, train_loss, total_count = 0, 0, 0

start_time = time.time()

def evaluate(dataloader):

model.eval() # 切换为测试模式

total_acc, train_loss, total_count = 0, 0, 0

with torch.no_grad():

for idx, (label, text, offsets) in enumerate(dataloader):

predicted_label = model(text, offsets)

loss = criterion(predicted_label, label) # 计算loss值

# 记录测试数据

total_acc += (predicted_label.argmax(1) == label).sum().item()

train_loss += loss.item()

total_count += label.size(0)

return total_acc/total_count, train_loss/total_count

6.拆分数据集并运行模型

from torch.utils.data.dataset import random_split

from torchtext.data.functional import to_map_style_dataset

# 超参数

EPOCHS = 10 # epoch

LR = 5 # 学习率

BATCH_SIZE = 64 # batch size for training

criterion = torch.nn.CrossEntropyLoss()

optimizer = torch.optim.SGD(model.parameters(), lr=LR)

scheduler = torch.optim.lr_scheduler.StepLR(optimizer, 1.0, gamma=0.1)

total_accu = None

train_iter, test_iter = AG_NEWS() # 加载数据

train_dataset = to_map_style_dataset(train_iter)

test_dataset = to_map_style_dataset(test_iter)

num_train = int(len(train_dataset) * 0.95)

split_train_, split_valid_ = random_split(train_dataset,

[num_train, len(train_dataset)-num_train])

train_dataloader = DataLoader(split_train_, batch_size=BATCH_SIZE,

shuffle=True, collate_fn=collate_batch)

valid_dataloader = DataLoader(split_valid_, batch_size=BATCH_SIZE,

shuffle=True, collate_fn=collate_batch)

test_dataloader = DataLoader(test_dataset, batch_size=BATCH_SIZE,

shuffle=True, collate_fn=collate_batch)

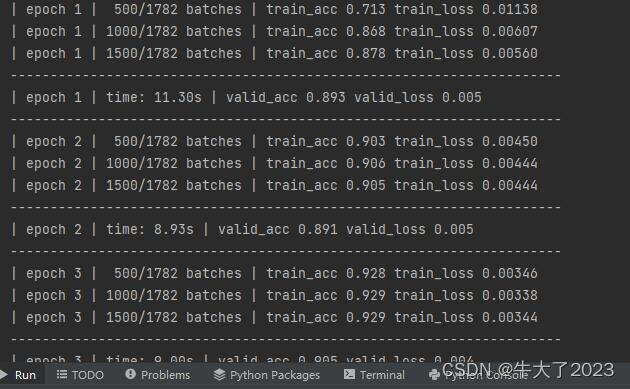

for epoch in range(1, EPOCHS + 1):

epoch_start_time = time.time()

train(train_dataloader)

val_acc, val_loss = evaluate(valid_dataloader)

if total_accu is not None and total_accu > val_acc:

scheduler.step()

else:

total_accu = val_acc

print('-' * 69)

print('| epoch {:1d} | time: {:4.2f}s | '

'valid_acc {:4.3f} valid_loss {:4.3f}'.format(epoch,

time.time() - epoch_start_time,

val_acc,val_loss))

print('-' * 69)

torchtext.data.functional.to_map_style_dataset 函数的作用是将一个迭代式的数据集(Iterable-style dataset)转换为映射式的数据集(Map-style dataset)。这个转换使得我们可以通过索引(例如:整数)更方便地访问数据集中的元素。

在 PyTorch 中,数据集可以分为两种类型:Iterable-style 和 Map-style。Iterable-style 数据集实现了 iter() 方法,可以迭代访问数据集中的元素,但不支持通过索引访问。而 Map-style 数据集实现了 getitem() 和 len() 方法,可以直接通过索引访问特定元素,并能获取数据集的大小。

TorchText 是 PyTorch 的一个扩展库,专注于处理文本数据。torchtext.data.functional 中的 to_map_style_dataset 函数可以帮助我们将一个 Iterable-style 数据集转换为一个易于操作的 Map-style 数据集。这样,我们可以通过索引直接访问数据集中的特定样本,从而简化了训练、验证和测试过程中的数据处理。

三、使用测试数据集评估模型

print('Checking the results of test dataset.')

test_acc, test_loss = evaluate(test_dataloader)

print('test accuracy {:8.3f}'.format(test_acc))Checking the results of test dataset.

test accuracy 0.905

四、总结

这篇文章介绍了使用PyTorch实现文本分类的实战案例,使用AG News数据集进行文本分类。实现过程分为前期准备、代码实战、使用测试数据集评估模型和总结四个部分。前期准备中准备环境、加载数据集;代码实战中构建词典、生成数据批次和迭代器,定义模型;使用测试数据集评估模型,对训练好的模型进行测试;总结对整个项目进行总结回顾。通过这篇文章,大家可以了解文本分类的基本流程,以及如何使用PyTorch实现文本分类模型。

以下是几个学习经验:

1.环境准备:建议使用anaconda专门新建一个环境,在其中安装需要的库。

2.数据加载:通过调用AG_NEWS数据集的train_iter方法加载数据,可以在对应目录下查看数据。

3.构建词典:使用get_tokenizer函数和build_vocab_from_iterator函数构建词典,可以根据需要设置默认索引,找不到单词时选择默认索引。

4.生成数据批次和迭代器:使用DataLoader函数生成数据批次和迭代器,其中的collate_batch函数用于将单个样本转换为模型输入。

5.定义模型:定义TextClassificationModel模型,首先对文本进行嵌入,然后对句子嵌入之后的结果进行均值聚合。

6.模型训练和评估:对模型进行训练和评估,包括定义损失函数、定义优化器、循环训练等步骤。