基于YOLOv8深度学习的智慧考场考试防作弊行为检测系统设计与实现(PyQt5界面+数据集+训练代码)

随着教育领域的数字化和智能化发展,考试中的作弊行为已成为影响考试公平性和效率的重要问题。为了解决这一问题,本研究设计并实现了一种基于YOLOv8深度学习模型的智慧考场考试防作弊行为检测系统。系统采用YOLOv8算法对考场中的视频图像数据进行实时分析,能够自动检测并识别考生的异常行为,如偷看、使用电子设备等潜在作弊行为。项目结合PyQt5开发了一个用户界面,方便考务人员对考试过程进行监控、分析和管理。

该系统的核心模块包括数据集的采集与标注、YOLOv8模型的训练与优化、作弊行为检测算法的设计,以及检测结果的展示与存储。数据集包含多个考场场景下的图片和视频数据,经过精确标注用于训练深度学习模型。训练后的YOLOv8模型可以对考场中的关键行为进行识别,并以图像、视频形式输出检测结果。系统提供了高效的数据存储与管理功能,便于后期分析和作弊证据的保留。

实验结果表明,基于YOLOv8的防作弊行为检测系统在多种考场环境下表现出优异的检测精度和处理速度,能够快速识别作弊行为,显著提升了考试管理的智能化水平。该系统具有较强的扩展性和实用性,可广泛应用于各类考试场景中,有助于提高考试的公正性和安全性。

通过本系统的设计与实现,展示了深度学习技术在智慧考场中的应用前景,并为未来考试作弊防控系统的发展提供了有力的技术支持。

算法流程

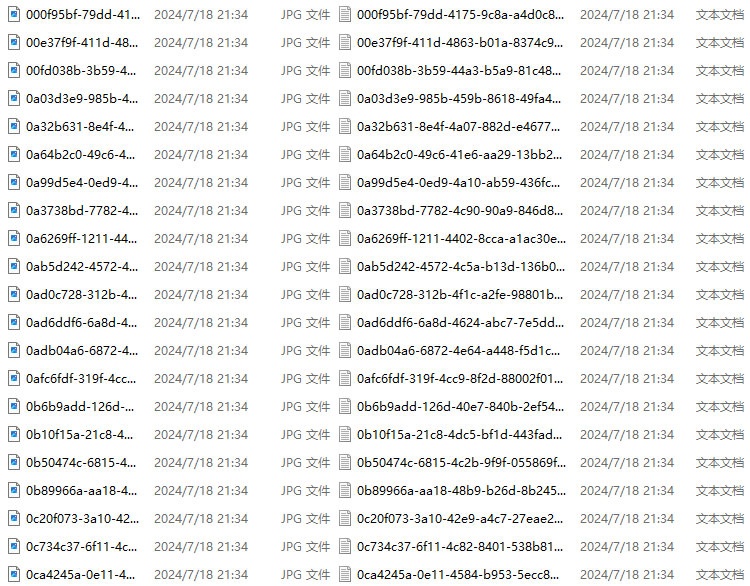

项目数据

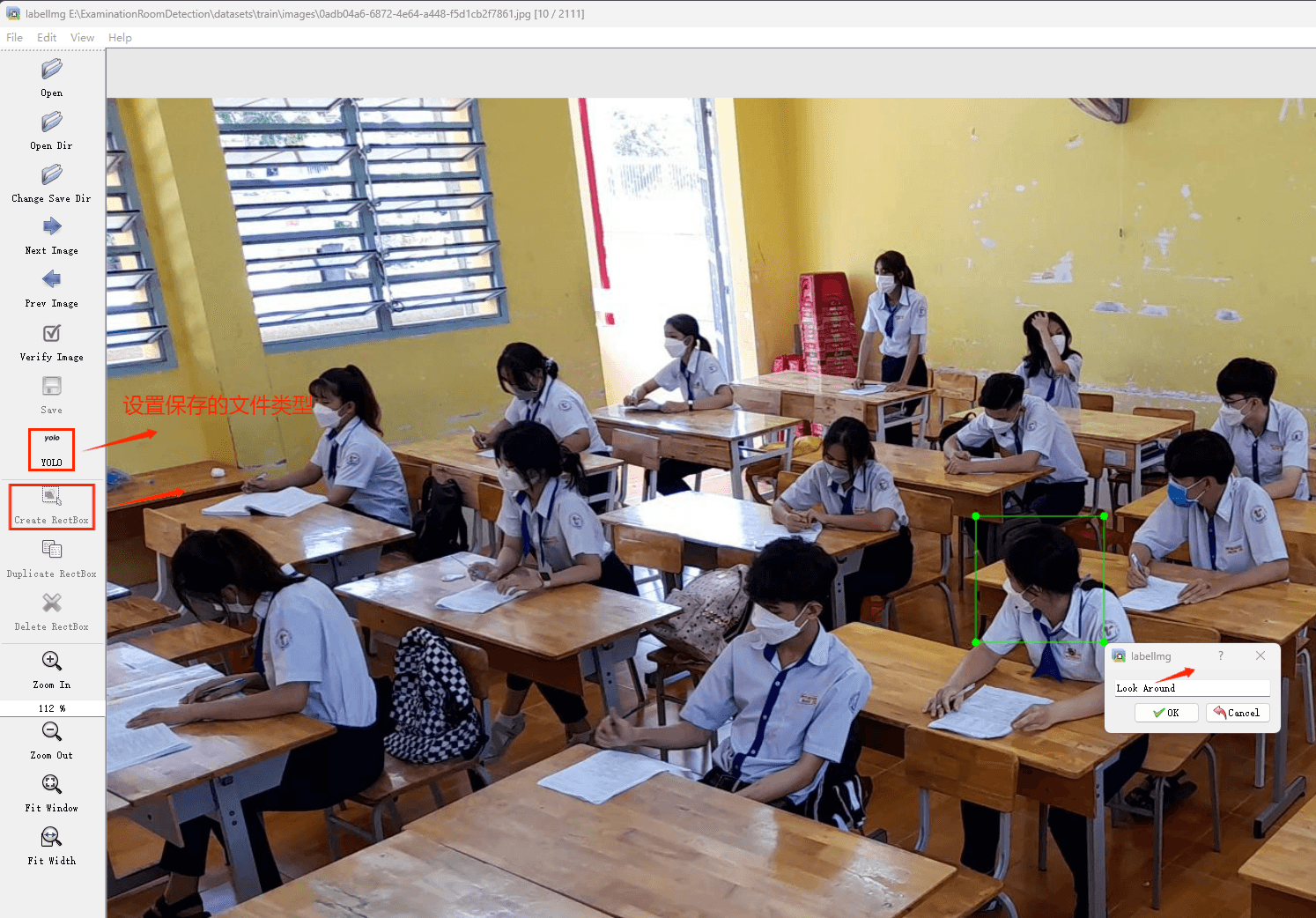

通过搜集关于数据集为各种各样的课堂行为相关图像,并使用Labelimg标注工具对每张图片进行标注,分3个检测类别,分别是Bend Over The Desk表示 “低头”、Hand Under Table表示 “手放在桌子下面”、环顾四周表示 “Look Around”、Normal表示 “正常”、Stand Up表示 “站立”、Wave表示”举手”。

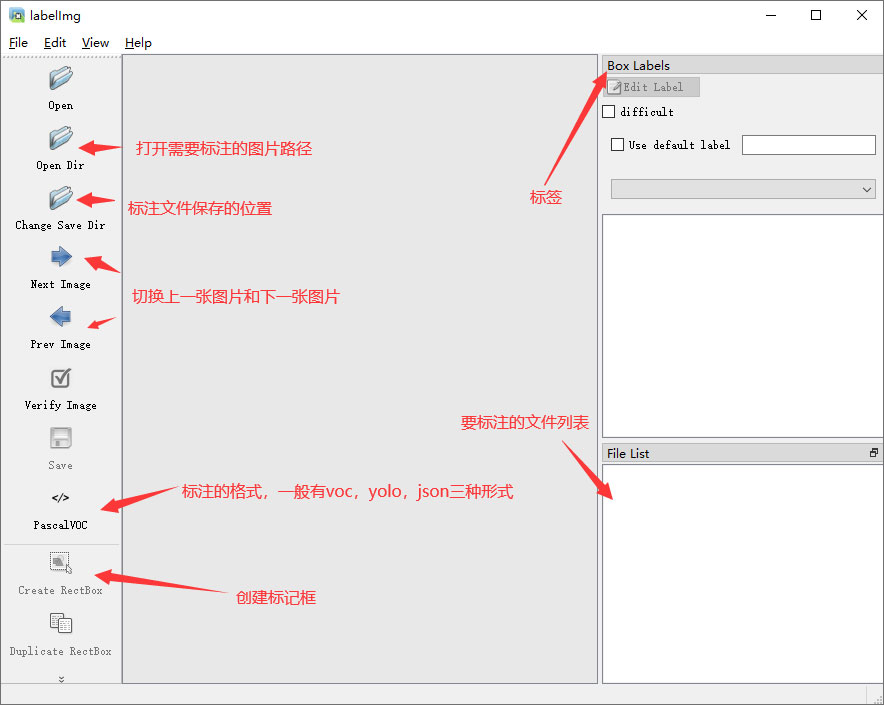

目标检测标注工具

(1)labelimg:开源的图像标注工具,标签可用于分类和目标检测,它是用python写的,并使用Qt作为其图形界面,简单好用(虽然是英文版的)。其注释以 PASCAL VOC格式保存为XML文件,这是ImageNet使用的格式。此外,它还支持 COCO数据集格式。

(2)安装labelimg 在cmd输入以下命令 pip install labelimg -i https://pypi.tuna.tsinghua.edu.cn/simple

![]()

结束后,在cmd中输入labelimg

![]()

初识labelimg

打开后,我们自己设置一下

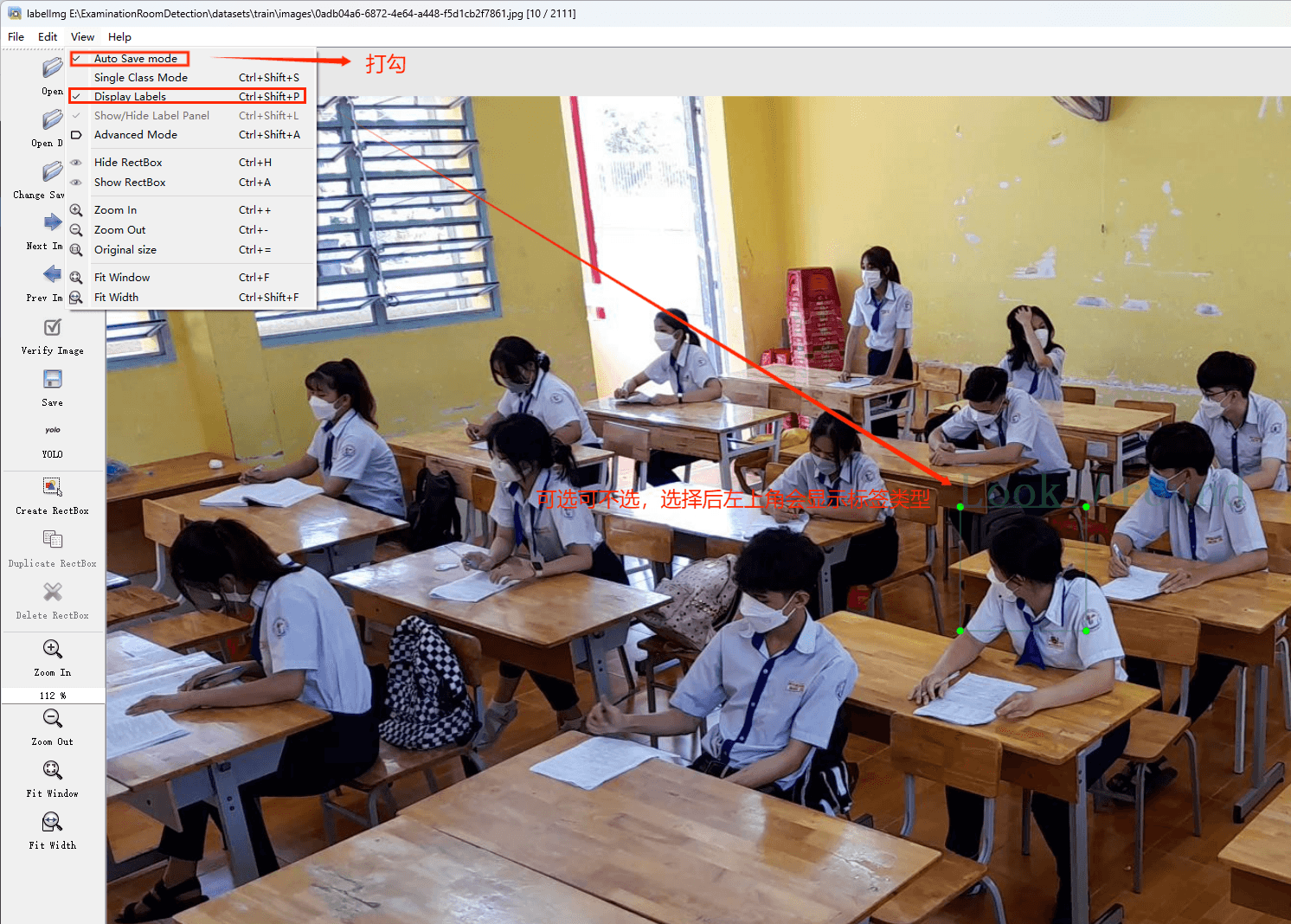

在View中勾选Auto Save mode

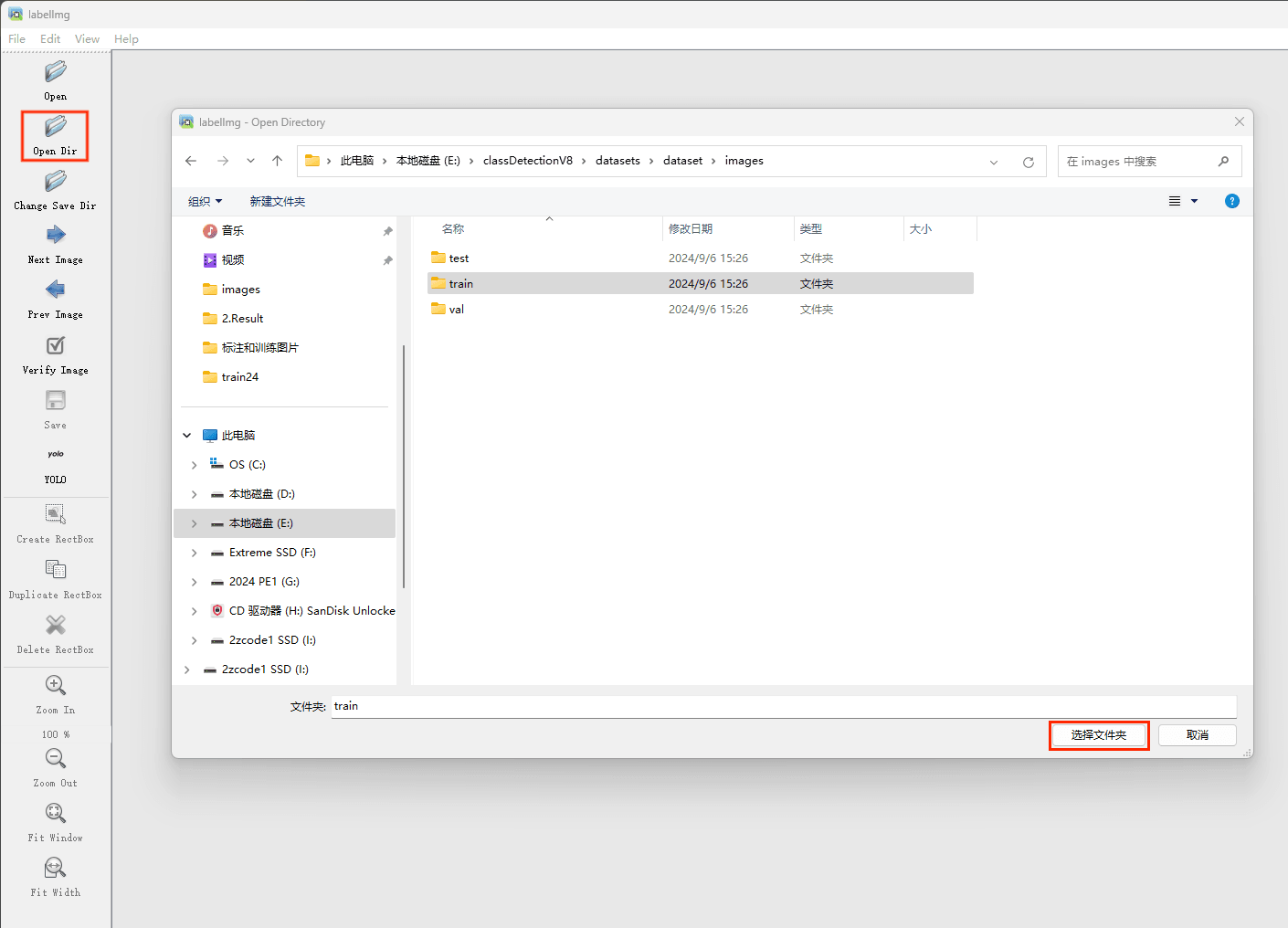

接下来我们打开需要标注的图片文件夹

并设置标注文件保存的目录(上图中的Change Save Dir)

接下来就开始标注,画框,标记目标的label,然后d切换到下一张继续标注,不断重复重复。

Labelimg的快捷键

(3)数据准备

这里建议新建一个名为data的文件夹(这个是约定俗成,不这么做也行),里面创建一个名为images的文件夹存放我们需要打标签的图片文件;再创建一个名为labels存放标注的标签文件;最后创建一个名为 classes.txt 的txt文件来存放所要标注的类别名称。

data的目录结构如下:

│─img_data

│─images 存放需要打标签的图片文件

│─labels 存放标注的标签文件

└ classes.txt 定义自己要标注的所有类别(这个文件可有可无,但是在我们定义类别比较多的时候,最好有这个创建一个这样的txt文件来存放类别)

首先在images这个文件夹放置待标注的图片,这里是一类图片,就是using phone。

生成文件如下:

“classes.txt”定义了你的 YOLO 标签所引用的类名列表。

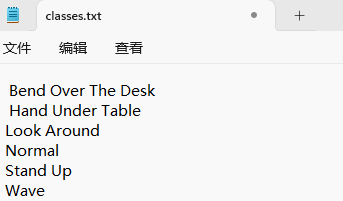

(4)YOLO模式创建标签的样式

存放标签信息的文件的文件名为与图片名相同,内容由N行5列数据组成。

每一行代表标注的一个目标,通常包括五个数据,从左到右依次为:类别id、x_center、y_center、width、height。

其中:

–x类别id代表标注目标的类别;

–x_center和y_center代表标注框的相对中心坐标;

–xwidth和height代表标注框的相对宽和高。

注意:这里的中心点坐标、宽和高都是相对数据!!!

存放标签类别的文件的文件名为classes.txt (固定不变),用于存放创建的标签类别。

完成后可进行后续的yolo训练方面的操作。

模型训练

模型的训练、评估与推理

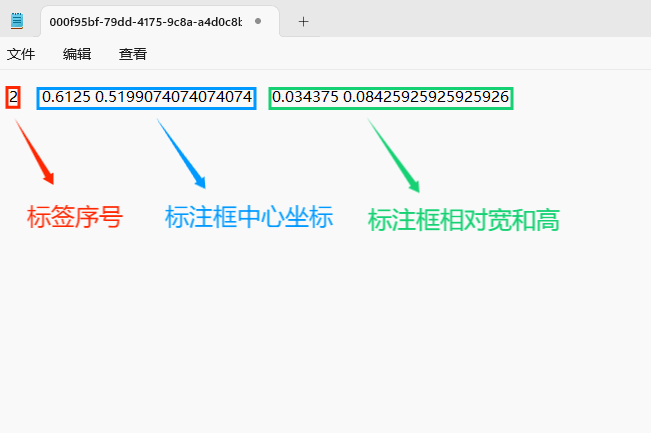

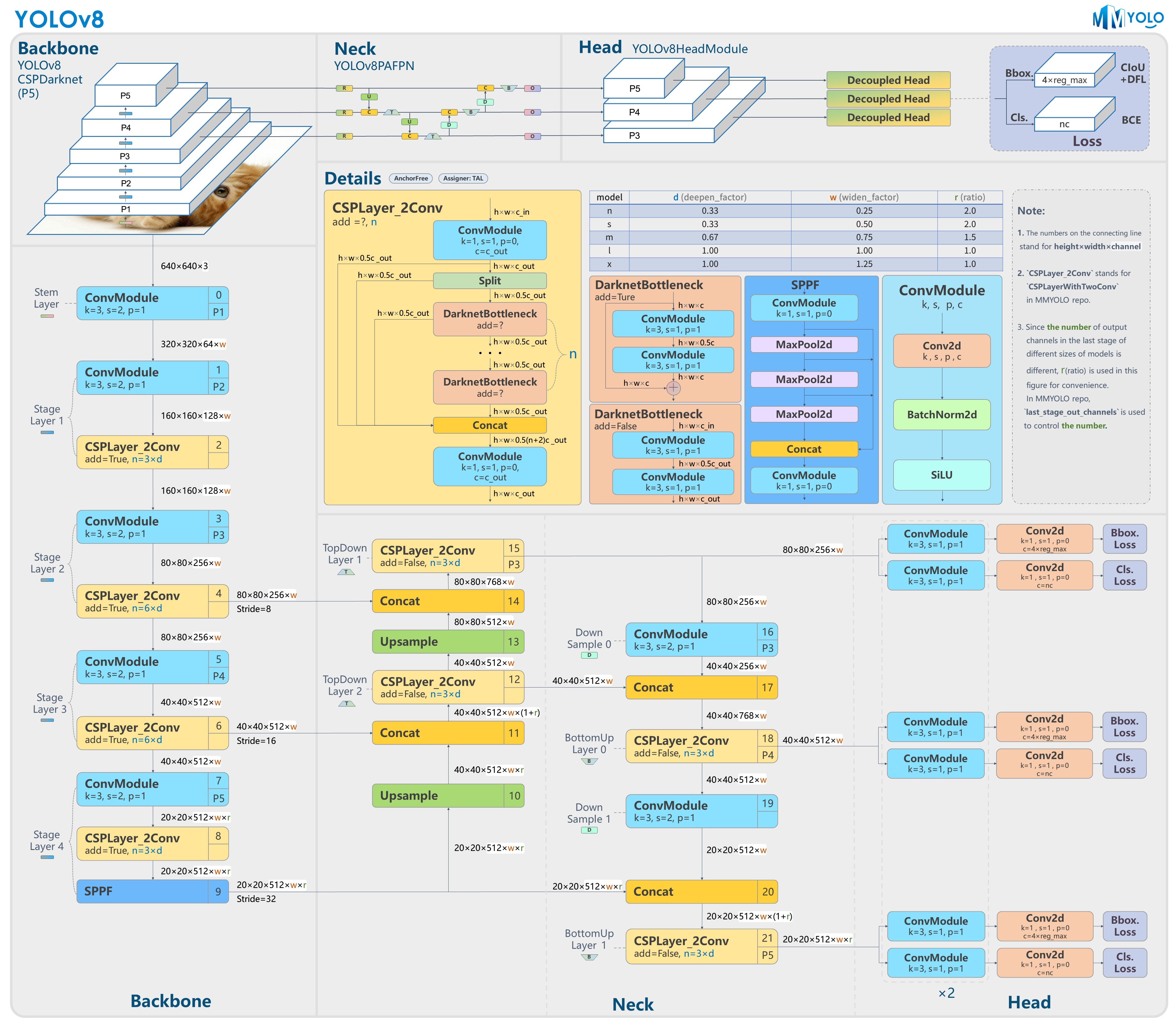

1.YOLOv8的基本原理

YOLOv8是一个SOTA模型,它建立在Yolo系列历史版本的基础上,并引入了新的功能和改进点,以进一步提升性能和灵活性,使其成为实现目标检测、图像分割、姿态估计等任务的最佳选择。其具体创新点包括一个新的骨干网络、一个新的Ancher-Free检测头和一个新的损失函数,可在CPU到GPU的多种硬件平台上运行。

YOLOv8是Yolo系列模型的最新王者,各种指标全面超越现有对象检测与实例分割模型,借鉴了Yolov5、Yolov6、YoloX等模型的设计优点,在全面提升改进Yolov5模型结构的基础上实现,同时保持了Yolov5工程化简洁易用的优势。

Yolov8模型网络结构图如下图所示:

2.数据集准备与训练

本研究使用了包含各种课堂行为相关图像的数据集,并通过Labelimg标注工具对每张图像中的目标边框(Bounding Box)及其类别进行标注。然后主要基于YOLOv8n这种模型进行模型的训练,训练完成后对模型在验证集上的表现进行全面的性能评估及对比分析。模型训练和评估流程基本一致,包括:数据集准备、模型训练、模型评估。本次标注的目标类别为学习、打手机、睡觉,数据集中共计包含2032张图像,其中训练集占1422张,验证集占203张,测试集占407张。部分图像如下图所示:

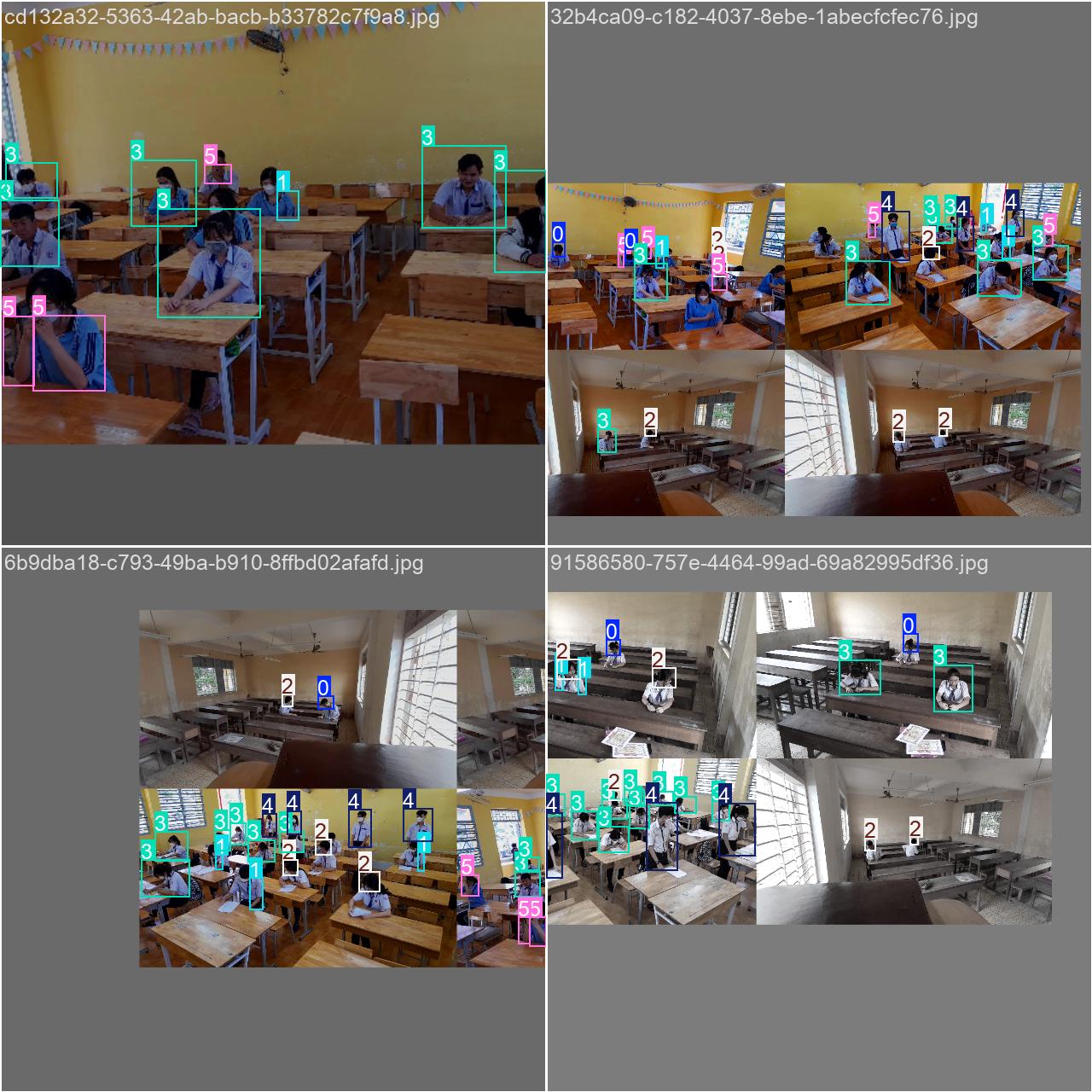

部分标注如下图所示:

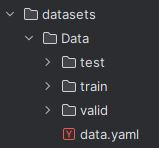

图片数据的存放格式如下,在项目目录中新建datasets目录,同时将检测的图片分为训练集与验证集放入Data目录下。

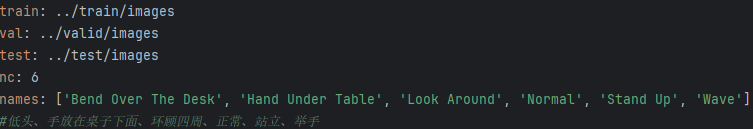

接着需要新建一个data.yaml文件,用于存储训练数据的路径及模型需要进行检测的类别。YOLOv8在进行模型训练时,会读取该文件的信息,用于进行模型的训练与验证。

data.yaml的具体内容如下:

train: ../train/images 训练集的路径

val: ../valid/images 验证集的路径

test: ../test/images 测试集的路径(可选)

nc: 6 模型检测的类别数,共有6个类别。

names: [‘Bend Over The Desk’, ‘Hand Under Table’, ‘Look Around’, ‘Normal’, ‘Stand Up’, ‘Wave’]

这个文件定义了用于模型训练和验证的数据集路径,以及模型将要检测的目标类别。

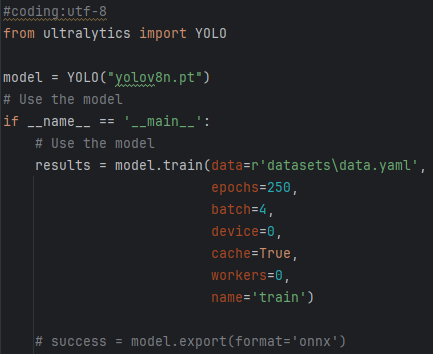

数据准备完成后,通过调用train.py文件进行模型训练,epochs参数用于调整训练的轮数,batch参数用于调整训练的批次大小(根据内存大小调整,最小为1)。

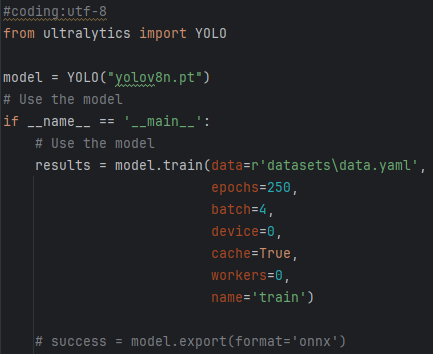

GPU训练代码如下:

加载名为 yolov8n.pt 的预训练YOLOv8模型,yolov8n.pt是预先训练好的模型文件。

使用YOLO模型进行训练,主要参数说明如下:

(1)data=data_yaml_path: 指定了用于训练的数据集配置文件。

(2)epochs=250: 设定训练的轮数为250轮。

(3)batch=4: 指定了每个批次的样本数量为4。

(4)device=0: 设定在GPU设备0上进行训练(如果有GPU)。

(5)cache=True: 设定为缓存数据集以加快训练速度。

(6)workers=0: 设定使用的并行处理线程数为0(在某些情况下,这可以避免数据加载瓶颈)。

(7)name=’train’: 指定了此次训练的命名标签,用于区分不同的训练实验。

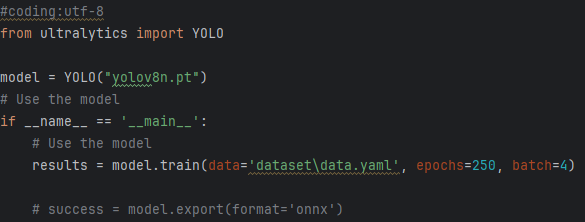

CPU训练代码如下:

加载名为 yolov8n.pt 的预训练YOLOv8模型,yolov8n.pt是预先训练好的模型文件。

使用YOLO模型进行训练,主要参数说明如下:

(1)data=data_yaml_path: 设置训练和验证数据集的路径,读取数据集配置信息。

(2)epochs=250: 设置训练的轮次为250轮。

(3)batch=4: 设置每个批次的样本数量为4。

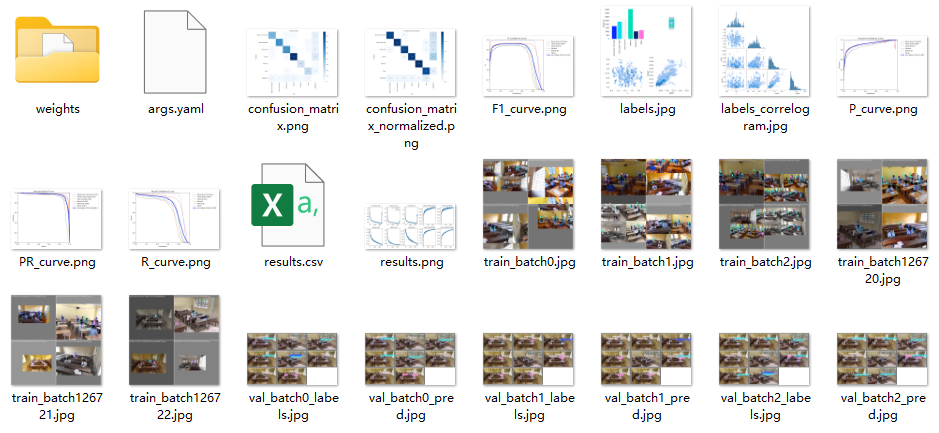

3.训练结果评估

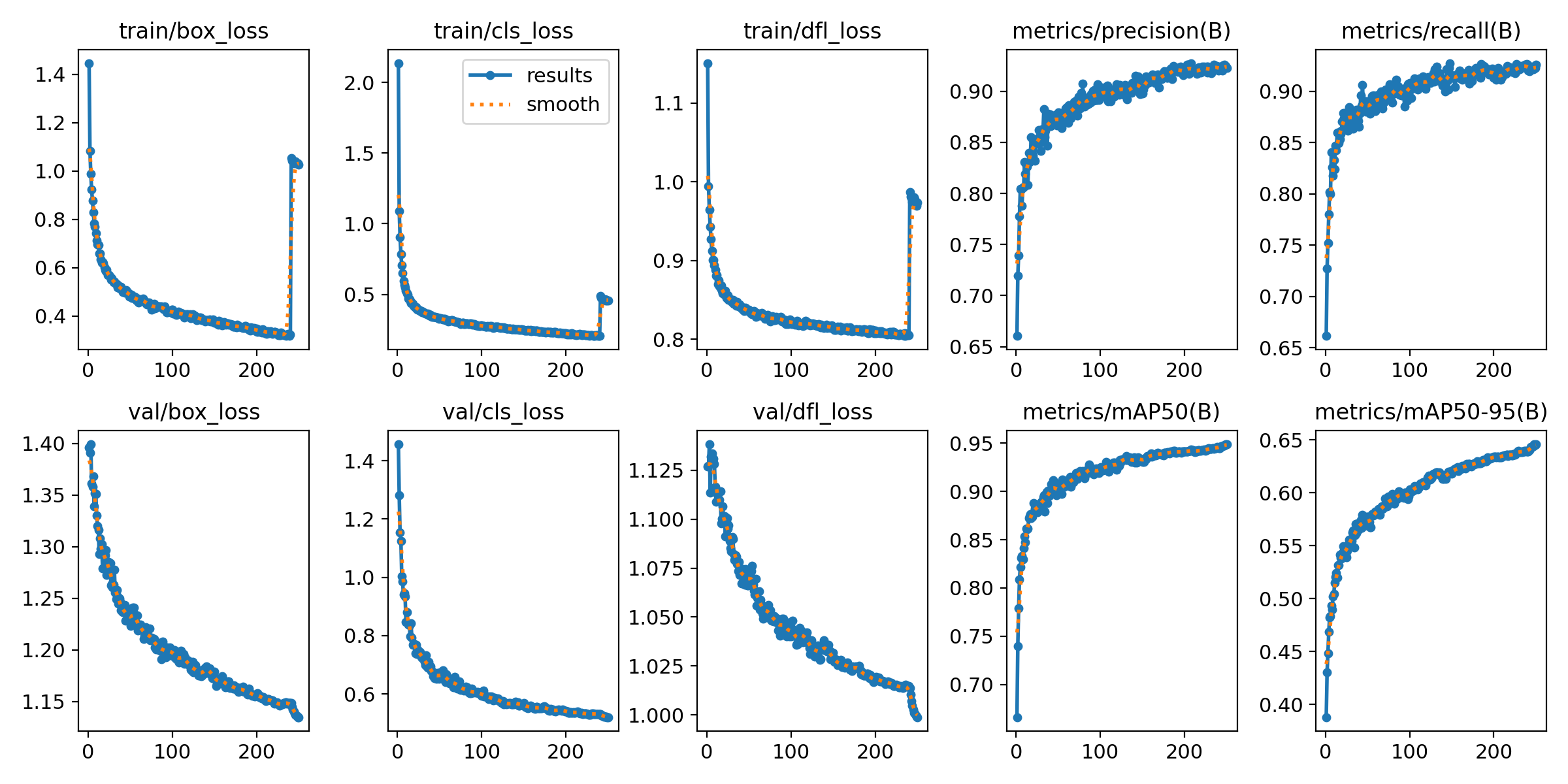

在深度学习的过程中,我们通常通过观察损失函数下降的曲线来了解模型的训练情况。对于YOLOv8模型的训练,主要涉及三类损失:定位损失(box_loss)、分类损失(cls_loss)以及动态特征损失(dfl_loss)。训练完成后,相关的训练过程和结果文件会保存在 runs/ 目录下,具体如下:

各损失函数作用说明:

定位损失box_loss:预测框与标定框之间的误差(GIoU),越小定位得越准;

分类损失cls_loss:计算锚框与对应的标定分类是否正确,越小分类得越准;

动态特征损失(dfl_loss):DFLLoss是一种用于回归预测框与目标框之间距离的损失函数。在计算损失时,目标框需要缩放到特征图尺度,即除以相应的stride,并与预测的边界框计算Ciou Loss,同时与预测的anchors中心点到各边的距离计算回归DFLLoss。这个过程是YOLOv8训练流程中的一部分,通过计算DFLLoss可以更准确地调整预测框的位置,提高目标检测的准确性。

训练结果如下:

这张图展示了YOLOv8模型在训练和验证过程中的多个重要指标的变化趋势,具体如下:

train/box_loss:

(1)这是模型在训练时关于预测框位置的损失(bounding box loss)。

(2)曲线随着训练的进行逐渐下降,表明模型在逐步学习准确预测目标的位置。

train/cls_loss:

(1)这是模型在训练时关于类别预测的损失(classification loss)。

(2)曲线下降表明模型在逐步学习如何正确分类目标对象。

train/dfl_loss:

(1)这是关于分布焦距损失(distribution focal loss)的曲线。

(2)它反映了模型在边界框回归中的学习情况。下降的趋势表明模型的边界框预测变得更加精确。

metrics/precision(B):

(1)这是训练过程中模型的精确率(precision)。

(2)精确率反映了模型正确预测为正类的比例。曲线逐渐上升,表示模型的精确率在提高。

metrics/recall(B):

(1)这是训练过程中模型的召回率(recall)。

(2)召回率反映了模型能正确检测到正类样本的比例。曲线显示随着训练,召回率逐渐提升。

val/box_loss:

(1)这是模型在验证集上关于预测框位置的损失。

(2)与训练集类似,曲线逐渐下降,表明模型在验证集上的性能也在提升。

val/cls_loss:

(1)这是验证集上的类别预测损失。

(2)表明模型在验证集上分类性能的提升。

val/dfl_loss:

(1)这是验证集上的分布焦距损失。

(2)曲线下降表示验证集上的边界框预测也在变得更好。

metrics/mAP50(B):

(1)这是基于IoU阈值50的平均精度(mean Average Precision, mAP)。

(2)曲线上升表示模型在预测目标时的整体准确性逐步提升。

metrics/mAP50-95(B):

(1)这是基于多个IoU阈值(从50到95)的平均精度。

(2)这项指标比mAP50更严格,随着训练进行,曲线也逐渐上升,表明模型在各种IoU阈值下的预测性能在提升。

这些图展示了模型训练过程中损失不断降低,性能指标不断提高的趋势,表明模型在不断优化。

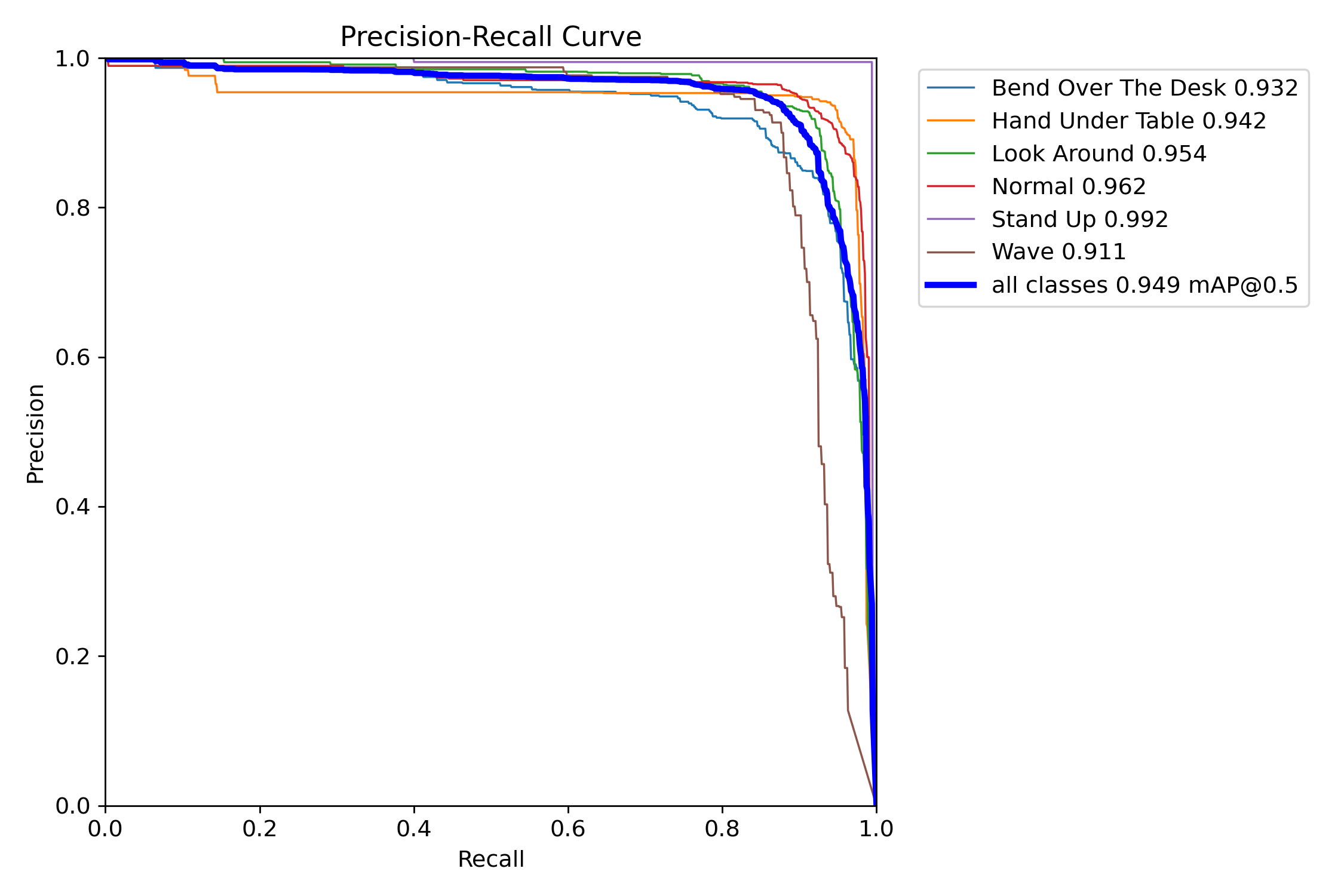

该图为精度-召回率曲线(Precision-Recall Curve),展示了不同类别的检测精度与召回率之间的关系。以下是详细解释:

Precision(精确率):

(1)表示模型所有预测为正类的样本中,实际为正类的比例。

(2)值越高,说明模型预测的结果更准确。

Recall(召回率):

(1)表示所有实际为正类的样本中,模型成功预测为正类的比例。

(2)值越高,说明模型找出的正类样本越全面。

不同颜色表示不同类别:图中展示了几类动作行为的检测效果,包括:

(1)Bend Over The Desk(趴在桌子上):0.932

(2)Hand Under Table(手在桌下):0.942

(3)Look Around(四处张望):0.954

(4)Normal(正常):0.962

(5)Stand Up(站立):0.992

(6)Wave(挥手):0.911

蓝色粗线表示所有类别的平均结果:

(1)该曲线代表所有类别的总体表现,平均精度在 IoU 阈值为 0.5 时(mAP@0.5)为 0.949。

(2)表示模型在检测各种行为时总体上具有较高的精确度和召回率。

曲线的形状:

(1)图中每条曲线的形状反映了模型在该类别上的表现。

(2)理想情况下,曲线应该靠近图的左上角,表示精确率和召回率都高。

(3)曲线靠近左上角的部分越多,模型在该类别上的性能越好。

不同类别的性能:

(1)从图中可以看到,类别 “Stand Up” 的表现最佳。

(2)精确率和召回率接近1,其他类别如 “Wave” 的表现相对稍弱。

这张图表明模型在大部分类别上的表现都比较出色,精确率和召回率都较高。

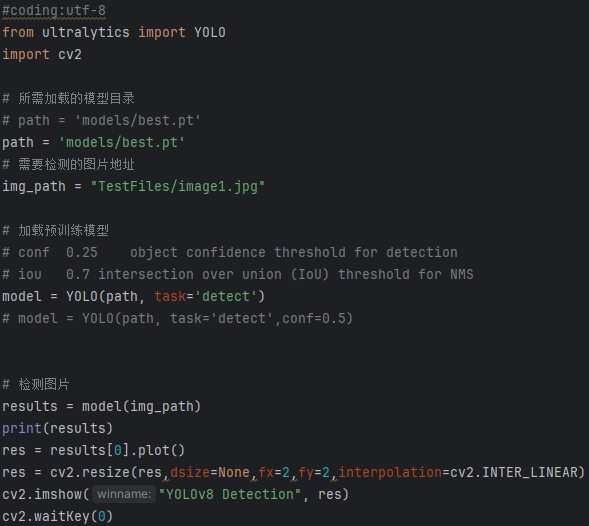

4.检测结果识别

模型训练完成后,我们可以得到一个最佳的训练结果模型best.pt文件,在runs/train/weights目录下。我们可以使用该文件进行后续的推理检测。

imgTest.py 图片检测代码如下:

加载所需库:

(1)from ultralytics import YOLO:导入YOLO模型类,用于进行目标检测。

(2)import cv2:导入OpenCV库,用于图像处理和显示。

加载模型路径和图片路径:

(1)path = ‘models/best.pt’:指定预训练模型的路径,这个模型将用于目标检测任务。

(2)img_path = “TestFiles/image1.jpg”:指定需要进行检测的图片文件的路径。

加载预训练模型:

(1)model = YOLO(path, task=’detect’):使用指定路径加载YOLO模型,并指定检测任务为目标检测 (detect)。

(2)通过 conf 参数设置目标检测的置信度阈值,通过 iou 参数设置非极大值抑制(NMS)的交并比(IoU)阈值。

检测图片:

(1)results = model(img_path):对指定的图片执行目标检测,results 包含检测结果。

显示检测结果:

(1)res = results[0].plot():将检测到的结果绘制在图片上。

(2)cv2.imshow(“YOLOv8 Detection”, res):使用OpenCV显示检测后的图片,窗口标题为“YOLOv8 Detection”。

(3)cv2.waitKey(0):等待用户按键关闭显示窗口

此代码的功能是加载一个预训练的YOLOv8模型,对指定的图片进行目标检测,并将检测结果显示出来。

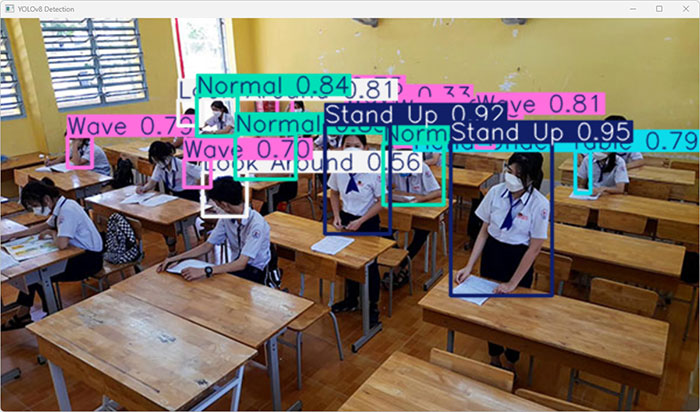

执行imgTest.py代码后,会将执行的结果直接标注在图片上,结果如下:

这段输出是基于YOLOv8模型对图片“image1.jpg”进行检测的结果,具体内容如下:

图像信息:

(1)图像路径为 E:\ExaminationRoomDetection\TestFiles\image1.jpg。

(2)图像的尺寸为 384×640。

检测结果:

模型检测出了以下行为:

(1)1 次 “Hand Under Table”(手在桌下)

(2)2 次 “Look Around”(四处张望)

(3)3 次 “Normal”(正常行为)

(4)2 次 “Stand Up”(站立)

(5)6 次 “Wave”(挥手)

处理速度:

(1)预处理时间:3.8 毫秒

(2)推理时间(模型推断):12.9 毫秒

(3)后处理时间:9.8 毫秒 这些时间是每张图像在输入形状为 (1, 3, 384, 640) 时的处理速度。

检测对象属性:

1.boxes: 表示检测到的边界框

2.names: 分类名称的映射,包括以下类别:

(1)0: “Bend Over The Desk”(趴在桌子上)

(2)1: “Hand Under Table”(手在桌下)

(3)2: “Look Around”(四处张望)

(4)3: “Normal”(正常行为)

(5)4: “Stand Up”(站立)

(6)5: “Wave”(挥手)

原始图像信息:

(1)orig_img: 原始图像的像素数组

(2)orig_shape: 原始图像的尺寸为 (338, 600)

(3)path: 图像路径

(4)save_dir: 结果保存路径为 runs\\detect\\predict

这段输出表示模型成功检测到了多个考场中的行为,并且在相对较短的时间内完成了图像的预处理、推理和后处理。

运行效果

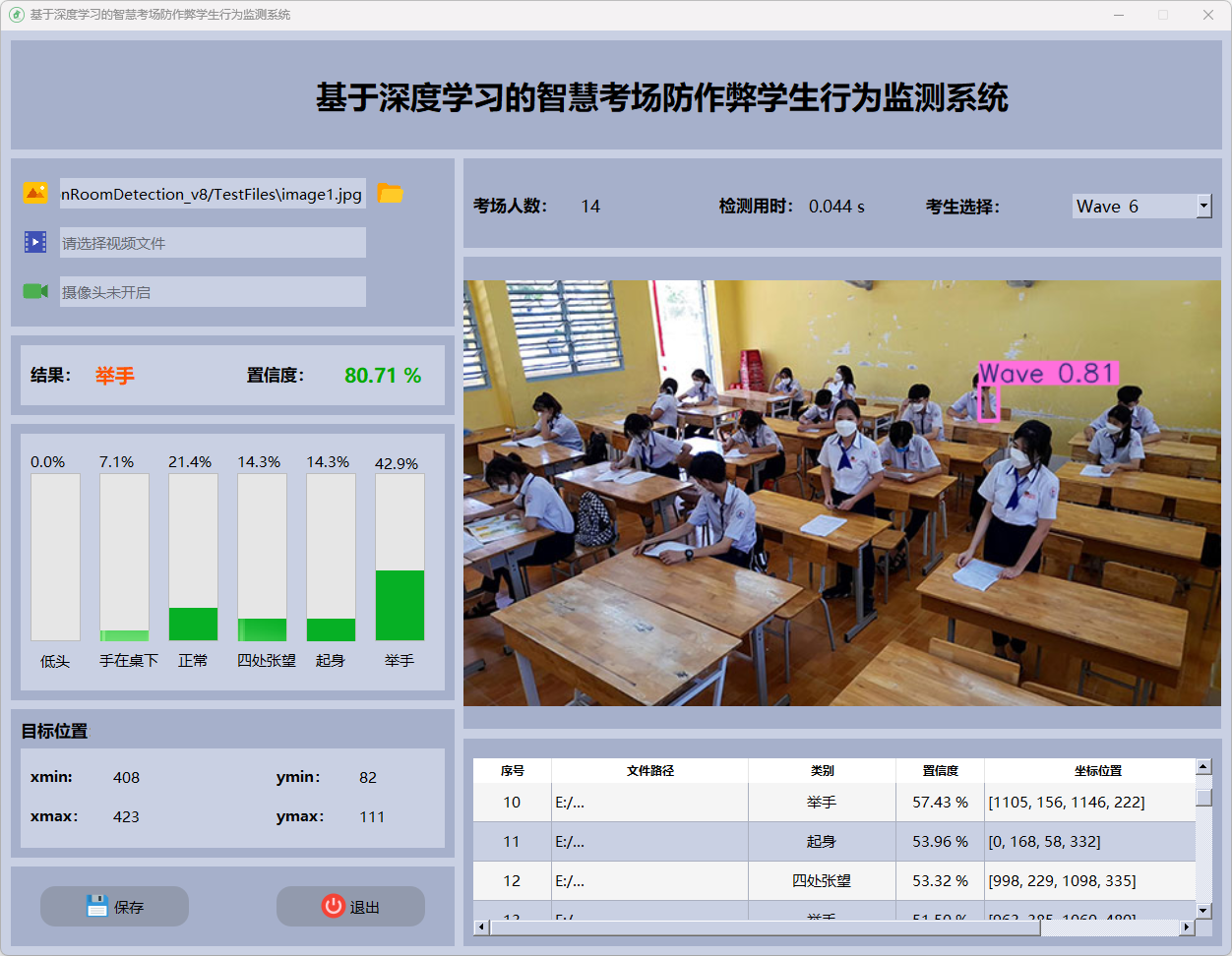

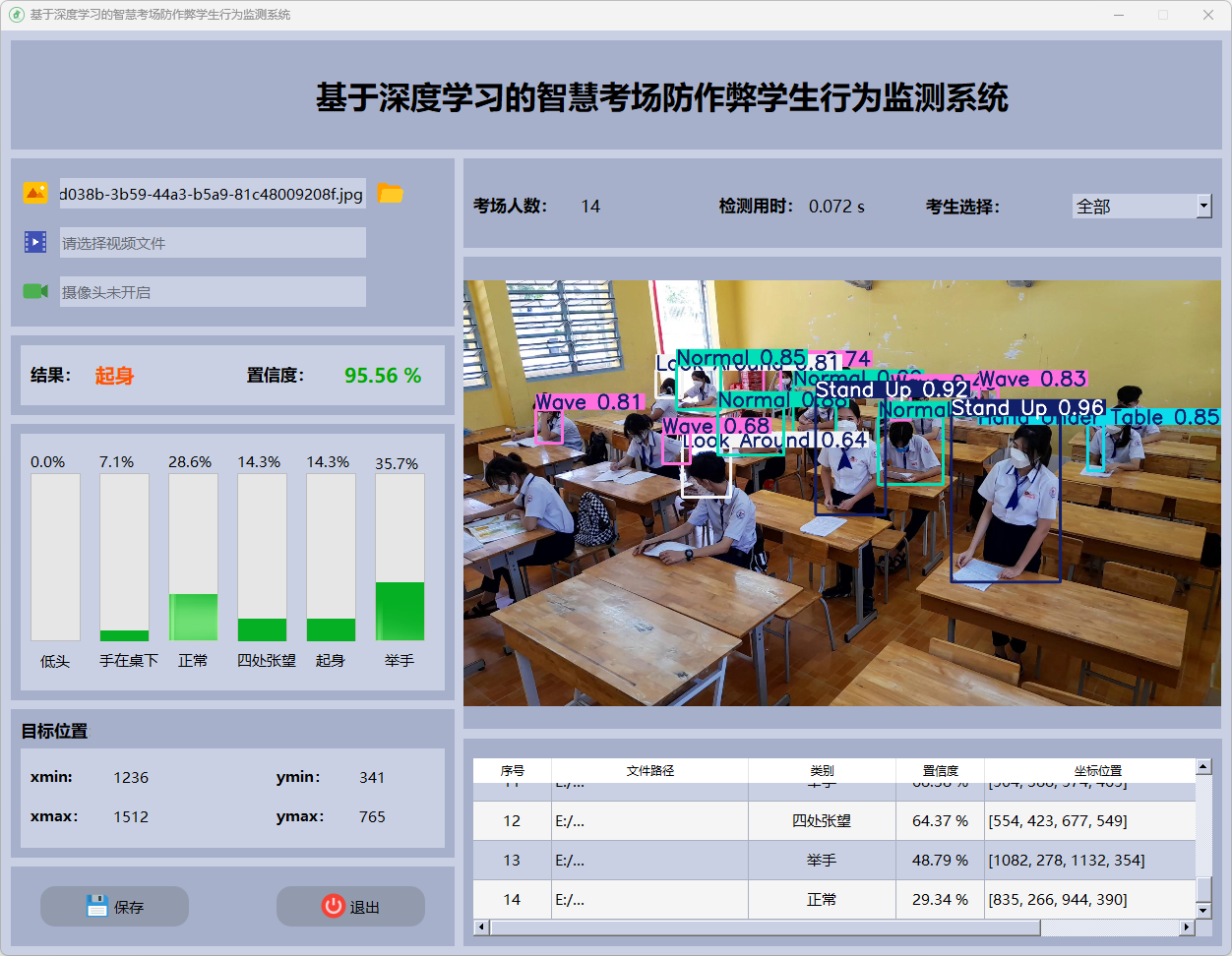

– 运行 MainProgram.py

1.主要功能:

(1)可用于实时检测考场图片中的防学生作弊行为;

(2)支持图片、视频及摄像头进行检测,同时支持图片的批量检测;

(3)界面可实时显示目标位置、目标总数、置信度、用时等信息;

(4)支持图片或者视频的检测结果保存。

2.检测结果说明:

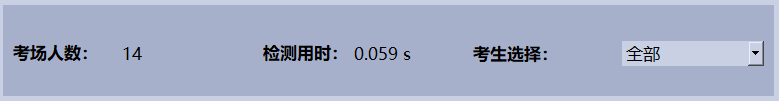

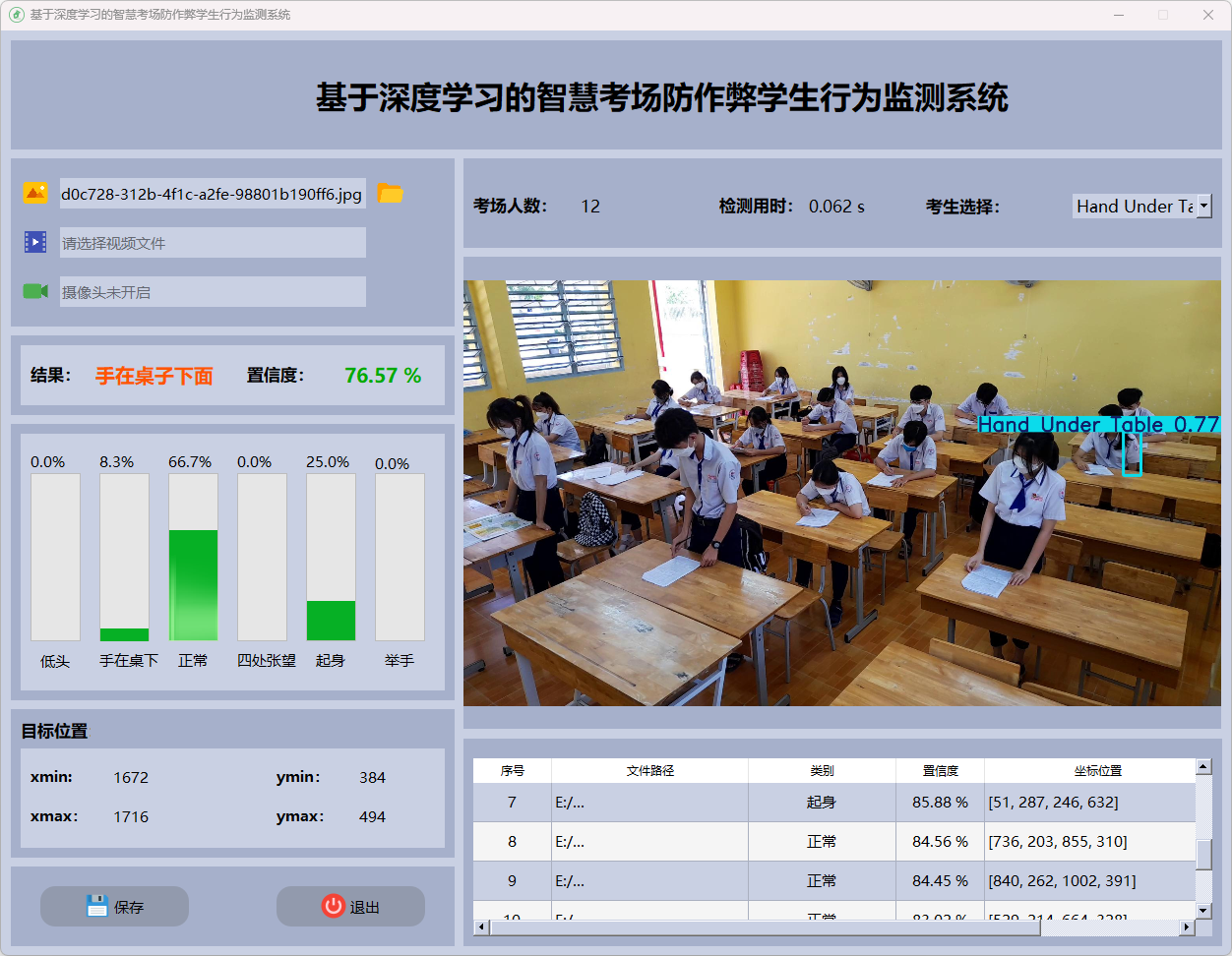

这张图表显示了基于YOLOv8模型的目标检测系统的检测结果界面。以下是各个字段的含义解释:

用时(Time taken):

(1)这表示模型完成检测所用的时间为0.059秒。

(2)这显示了模型的实时性,检测速度非常快。

目标数目(Number of objects detected):

(1)这表示在图像中检测到了14个目标。

目标选择(下拉菜单):全部:

(1)这里有一个下拉菜单,用户可以选择要查看的目标类型。

(2)在当前情况下,选择的是“全部”,意味着显示所有检测到的目标信息。

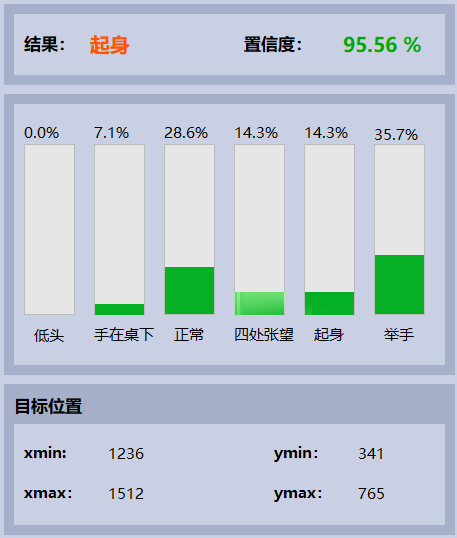

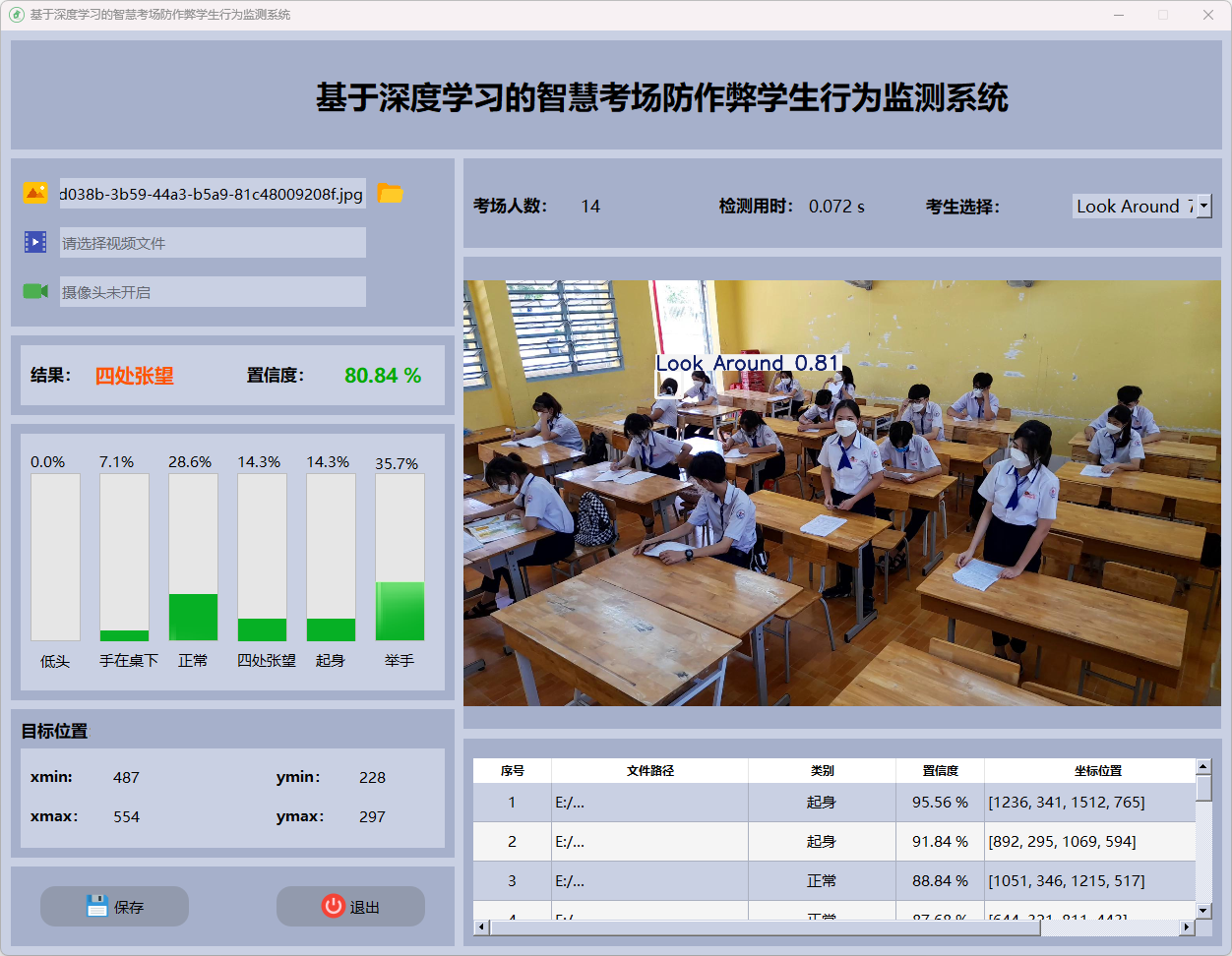

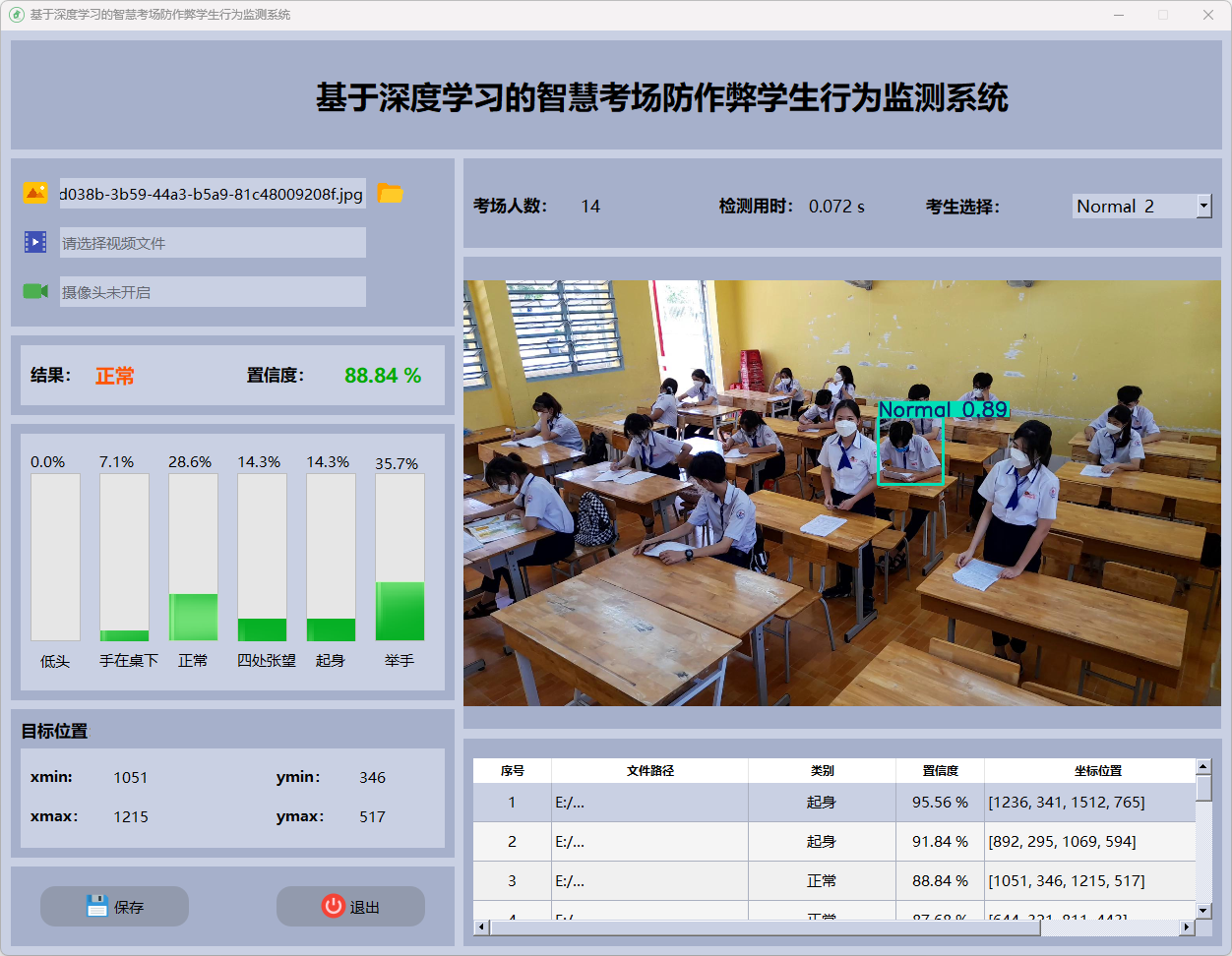

这张图表显示了基于YOLOv8模型的目标检测系统的检测结果界面。以下是各个字段的含义解释:

用时(Time taken):

(1)这表示模型完成检测所用的时间为0.027秒。

(2)这显示了模型的实时性,检测速度非常快。

目标数目(Number of objects detected):

(1)检测到的目标数目为 14,即在图像中检测到了14个行为对象。

目标选择(下拉菜单):全部:

(1)这里有一个下拉菜单,用户可以选择要查看的目标类型。

(2)在当前情况下,选择的是“全部”,意味着显示所有检测到的目标信息。

类型(Type):

(1)当前选中的行为类型为 “站立”,表示系统正在高亮显示检测到的“站立”行为。

置信度(Confidence):

(1)这表示模型对检测到的目标属于“站立”类别的置信度为 94.97%。

(2)置信度反映了模型的信心,置信度越高,模型对这个检测结果越有信心。

各类行为的检测比例:

(1)低头:0.0%

(2)手在桌下:7.1%

(3)正常:28.6%

(4)四处张望:14.3%

(5)起身:14.3%

(6)举手:35.7%

这些条形图显示了每种行为在当前检测中的占比情况。

可以看到,”举手”行为占据了42.9%,是检测到的最频繁的行为,”站立”行为占14.3%。

目标位置(Object location):

(1)xmin: 1236, ymin: 341:目标的左上角的坐标(xmin, ymin),表示目标区域在图像中的位置

(2)xmax: 1512, ymax: 765:目标的右下角的坐标(xmax, ymax),表示目标区域的边界。

这些坐标表示在图像中的目标区域范围,框定了检测到的“起身”行为的位置。

这张图展示了防作弊行为检测系统的一次检测结果,包括检测时间、检测到的行为种类、各行为的置信度、目标的位置信息等。用户可以通过界面查看并分析检测结果,提升考场监控的效率。

3.图片检测说明

(1)考试低头

(2)考试举手

(3)考试起身

(4)手在桌下

(5)四处张望

(5)正常

点击打开图片按钮,选择需要检测的图片,或者点击打开文件夹按钮,选择需要批量检测图片所在的文件夹。

操作演示如下:

(1)点击目标下拉框后,可以选定指定目标的结果信息进行显示。

(2)点击保存按钮,会对检测结果进行保存,存储路径为:save_data目录下。

检测结果:系统识别出图片中的学生行为,并显示检测结果,包括总目标数、用时、目标类型(学生行为)、置信度、以及目标的位置坐标信息。

4.视频检测说明

点击视频按钮,打开选择需要检测的视频,就会自动显示检测结果,再次点击可以关闭视频。

点击保存按钮,会对视频检测结果进行保存,存储路径为:save_data目录下。

检测结果:系统对视频进行实时分析,检测到考场学生行为并显示检测结果。表格显示了视频中多个检测结果的置信度和位置信息。

这个界面展示了系统对视频帧中的多目标检测能力,能够准确识别考场学生行为,并提供详细的检测结果和置信度评分。

5.摄像头检测说明

点击打开摄像头按钮,可以打开摄像头,可以实时进行检测,再次点击,可关闭摄像头。

检测结果:系统连接摄像头进行实时分析,检测到考场学生行为并显示检测结果。实时显示摄像头画面,并将检测到的行为位置标注在图像上,表格下方记录了每一帧中检测结果的详细信息。

6.保存图片与视频检测说明

点击保存按钮后,会将当前选择的图片(含批量图片)或者视频的检测结果进行保存。

检测的图片与视频结果会存储在save_data目录下。

保存的检测结果文件如下:

(1)图片保存

(2)视频保存

– 运行 train.py

1.训练参数设置

(1)epochs 参数设置了训练的轮数。在此设置下,模型将对数据集进行150轮的训练。

(2)device=0 参数指定了在哪个设备上运行训练过程。0通常表示使用第一个GPU。

(3)这里指定训练在GPU上进行。

虽然在大多数深度学习任务中,GPU通常会提供更快的训练速度。

但在某些情况下,可能由于硬件限制或其他原因,用户需要在CPU上进行训练。

温馨提示:在CPU上训练深度学习模型通常会比在GPU上慢得多,尤其是像YOLOv8这样的计算密集型模型。除非特定需要,通常建议在GPU上进行训练以节省时间。

2.训练日志结果

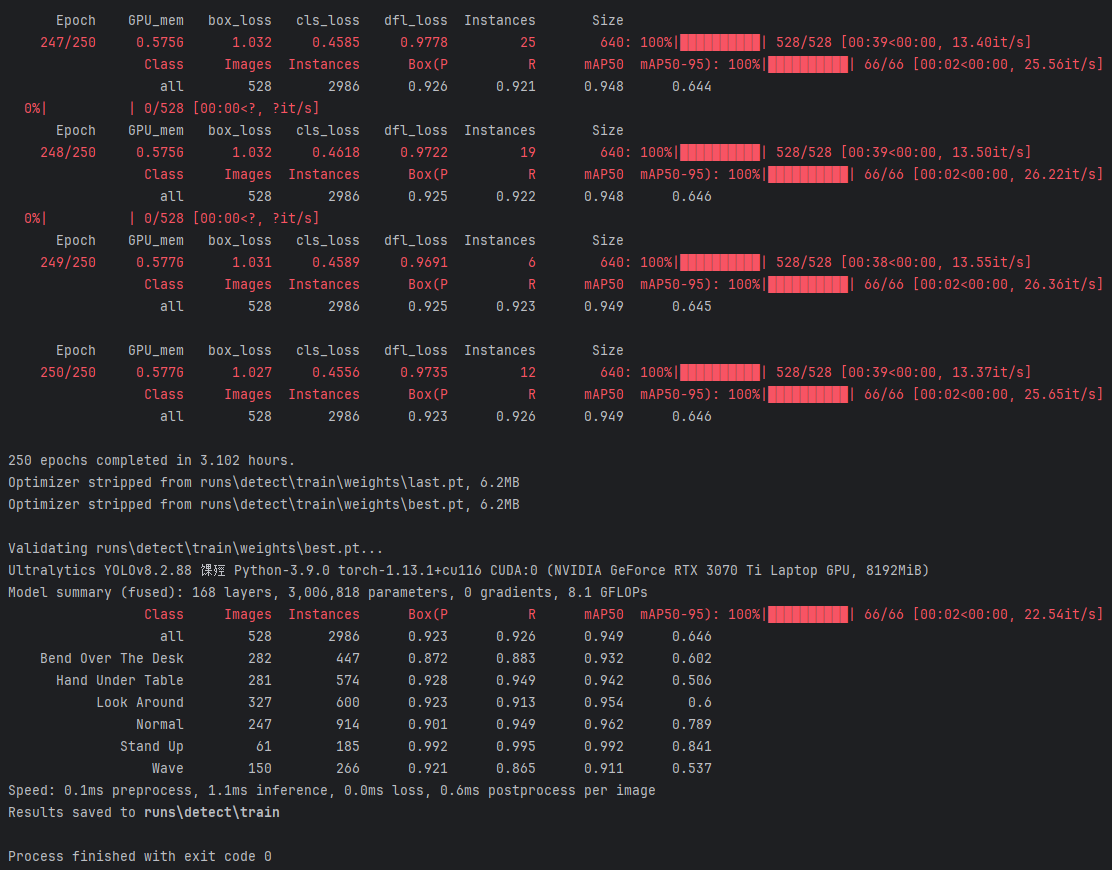

这张图展示了使用YOLOv8进行模型训练的详细过程和结果。

训练总时长:

(1)总共进行了 250 个周期 的训练,花费了 3.102 小时。

验证模型:

使用 best.pt 权重文件对模型进行验证,验证结果显示:

(1)mAP50: 0.949,即在IoU阈值为50%时,模型的平均精度为94.9%。

(2)mAP50-95: 0.646,在多个IoU阈值下的平均精度为64.6%。

模型类别总结:

表格显示了模型对不同类别的检测表现:

(1)Bend Over The Desk: mAP@0.5 = 0.932,mAP@0.5:0.95 = 0.602

(2)Hand Under Table: mAP@0.5 = 0.942,mAP@0.5:0.95 = 0.506

(3)Look Around: mAP@0.5 = 0.954,mAP@0.5:0.95 = 0.6

(4)Normal: mAP@0.5 = 0.962,mAP@0.5:0.95 = 0.789

(5)Stand Up: mAP@0.5 = 0.992,mAP@0.5:0.95 = 0.841

(6)Wave: mAP@0.5 = 0.911,mAP@0.5:0.95 = 0.537

从中可以看出模型在”起身”和”正常”行为的检测上表现最为出色,”举手”行为的检测表现相对较低。

性能指标:

速度:

(1)预处理时间:1.1毫秒

(2)推理时间:1.1毫秒

(3)后处理时间:0.0毫秒 整体速度非常快,表明模型在推理阶段效率较高。

该图展示了YOLOv8模型在训练过程中的逐步优化情况,最终模型在多个类别上的检测精度达到较高水平,尤其是在”正常”和”站立”行为检测方面表现非常优秀。