基于YOLOv5的舰船检测与识别系统(Python+清新界面+数据集)

摘要:基于YOLOv5的舰船检测与识别系统用于识别包括渔船、游轮等多种海上船只类型,检测船舰目标并进行识别计数,以提供海洋船只的自动化监测和管理。本文详细介绍船舰类型识别系统,在介绍算法原理的同时,给出Python的实现代码、训练数据集以及PyQt的UI界面。在界面中可以选择各种图片、视频进行检测识别;可对图像中存在的多目标进行识别分类。博文提供了完整的Python代码和使用教程,适合新入门的朋友参考,完整代码资源文件请转至文末的下载链接。本博文目录如下:

文章目录

- 前言

- 1. 效果演示

- 2. 数据集和YOLOv5训练

- 3. 舰船检测识别

- 下载链接

- 结束语

➷点击跳转至文末所有涉及的完整代码文件下载页☇

基于YOLOv5的舰船检测与识别系统演示与介绍

前言

准确有效的海上船舶识别技术对于提高船舶航行安全是非常重要的,同时也是船舶智能化发展的关键技术。传统的船舶识别主要依靠船舶自动识别系统(Automatic identification system,AIS)和雷达等通信导航设备完成。船舶雷达主要用于航行避让、船舶定位和狭水道引航等,是船舶航行必要的导航设备,但其也存在目标误识别、目标丢失和易受环境噪声影响等缺点。船舶自动识别系统能够准确获得船舶基本信息,可辅助识别船只、协助追踪目标、简化信息交流和提供其他辅助信息,以避免碰撞发生,但对于未装配该系统或终端关机的船舶则无法获取相关信息。上述基于通信导航设备的船舶识别方法有其优点,但因无法获取船舶直观图像,在港口等交通密集水域有较大的局限性。目前,基于深度学习的船舶识别方法的研究已取得了一定进展,通过自动提取船舶图像特征及不断学习与训练,实现对海上交通视频和图像中船舶的识别,其代表模型有CNN、R-CNN、Faster R-CNN、SSD和YOLO等。其中,针对卷积神经网络的船舶识别结果易受到图像背景干扰的问题。

本系统基于YOLOv5,对于图片、视频和摄像头捕获的实时画面,可检测舰船,系统支持结果记录、展示和保存,每次检测的结果记录在表格中。这里给出了博主设计的界面,同款的简约风,功能也可以满足图片、视频和摄像头的识别检测,希望大家可以喜欢,初始界面如下图:

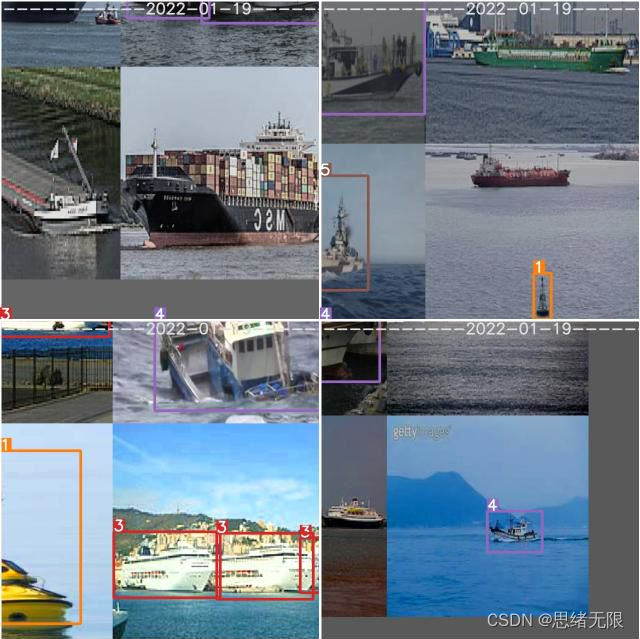

检测类别时的界面截图(点击图片可放大)如下图,可识别画面中存在的多个类别,也可开启摄像头或视频检测:

详细的功能演示效果参见博主的B站视频或下一节的动图演示,觉得不错的朋友敬请点赞、关注加收藏!系统UI界面的设计工作量较大,界面美化更需仔细雕琢,大家有任何建议或意见和可在下方评论交流。

1. 效果演示

我们还是通过动图看一下识别的效果,系统主要实现的功能是对图片、视频和摄像头画面中的舰船进行识别,识别的结果可视化显示在界面和图像中,另外提供多个目标的显示选择功能,演示效果如下。

(一)系统介绍

基于YOLOv5的舰船检测与识别系统主要用于海上船只类型的智能检测与识别,基于深度学习技术识别包括渔船、游轮、货轮、军舰等多种常见的船舰类型,输出船只的标记框坐标和类别,以辅助自动化监测海上船只航行情况;软件提供登录注册功能,可进行用户管理;软件能够有效识别相机采集的图片、视频等文件,检测船只类型情况,并记录识别结果在界面表格中方便查看;可开启摄像头实时监测和统计当前视野范围各种类型船舰,支持结果记录、展示和保存。

(二)用户注册登录界面

这里设计了一个登录界面,可以注册账号和密码,然后进行登录。界面还是参考了当前流行的UI设计,左侧是一个logo,右侧输入账号、密码、验证码等等。

(三)选择图片识别

系统允许选择图片文件进行识别,点击图片选择按钮图标选择图片后,显示所有识别的结果,可通过下拉选框查看单个结果,以便具体判断某一特定目标。本功能的界面展示如下图所示:

(四)视频识别效果展示

很多时候我们需要识别一段视频中的多个舰船,这里设计了视频选择功能。点击视频按钮可选择待检测的视频,系统会自动解析视频逐帧识别多个舰船,并将舰船的分类和计数结果记录在右下角表格中,效果如下图所示:

(五)摄像头检测效果展示

有时需要开启摄像头对舰船进行识别,如下图所示,点击摄像头按钮后系统进入准备状态,系统显示实时画面并开始检测画面中的舰船,识别结果展示如下图:

2. 数据集和YOLOv5训练

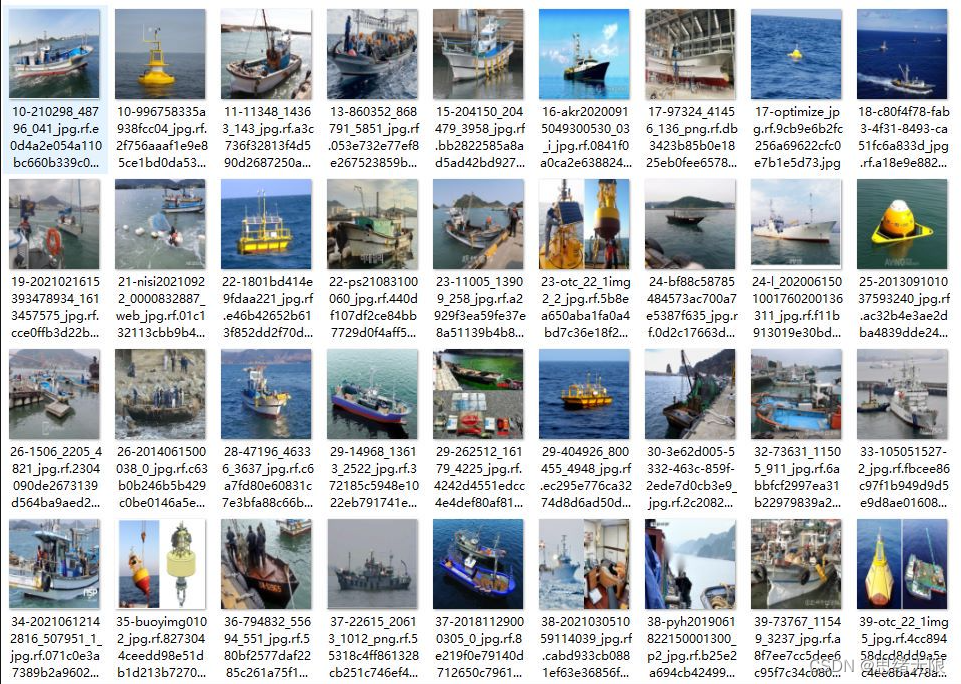

本文的实验数据集包含海峡、港口、海面等背景下的图像,也包含不同气候环境干扰的图像。其中,训练集4022张图片,验证集1130张图片,测试集574张图片,共计5726张图片,选取部分数据部分样本数据集如图所示。

每张图像均提供了图像类标记信息,图像中舰船的bounding box,舰船的关键part信息,以及舰船的属性信息,数据集并解压后得到如下的图片

船舰数据集的类别信息如下:

Chinese_name = {'a': "A型", 'buoy': "浮标", 'container': "货轮", 'cruise': "游轮", 'fish-b': "渔船", 'warship': "军舰"}

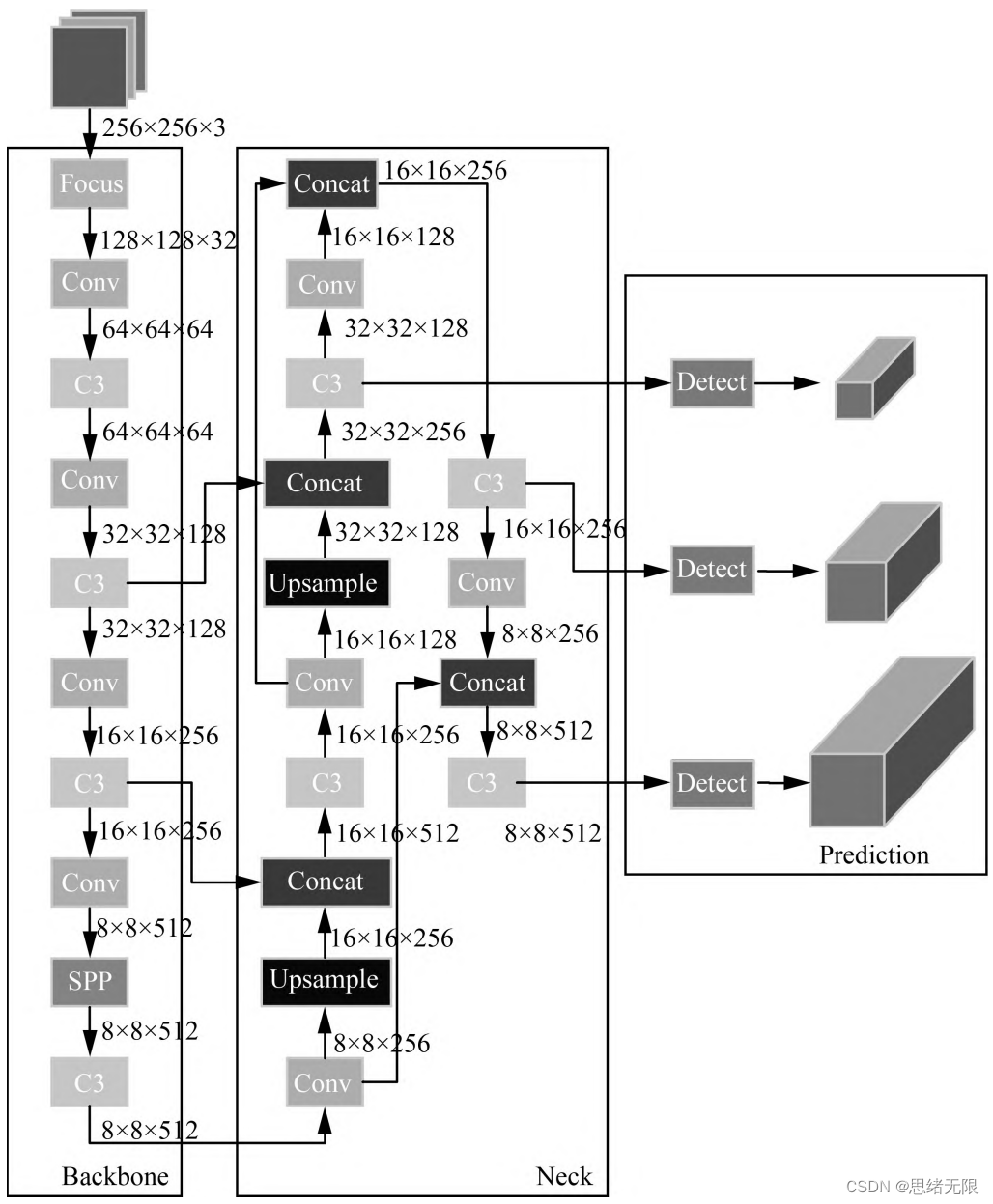

YOLOv5算法具有4个版本,具体包括:Yolov5s、Yolov5m、Yolov5l、Yolov5x四种,不同的版本在网络上有一定加深与加宽。Yolov5网络结构是由Input、Backbone、Neck、Prediction组成。Yolov5的Input部分是网络的输入端,采用Mosaic数据增强方式,对输入数据随机裁剪,然后进行拼接。Backbone是Yolov5提取特征的网络部分,特征提取能力直接影响整个网络性能。Yolov5的Backbone相比于之前Yolov4提出了新的Focus结构。Focus结构是将图片进行切片操作,将W(宽)、H(高)信息转移到了通道空间中,使得在没有丢失任何信息的情况下,进行了2倍下采样操作。

输入端-输入端表示输入的图片。该网络的输入图像大小为608*608,该阶段通常包含一个图像预处理阶段,即将输入图像缩放到网络的输入大小,并进行归一化等操作。在网络训练阶段,YOLOv5使用Mosaic数据增强操作提升模型的训练速度和网络的精度;并提出了一种自适应锚框计算与自适应图片缩放方法。

基准网络-基准网络通常是一些性能优异的分类器种的网络,该模块用来提取一些通用的特征表示。YOLOv5中不仅使用了CSPDarknet53结构,而且使用了Focus结构作为基准网络。

Neck网络-Neck网络通常位于基准网络和头网络的中间位置,利用它可以进一步提升特征的多样性及鲁棒性。虽然YOLOv5同样用到了SPP模块、FPN+PAN模块,但是实现的细节有些不同。

Head输出端-Head用来完成目标检测结果的输出。针对不同的检测算法,输出端的分支个数不尽相同,通常包含一个分类分支和一个回归分支。YOLOv4利用GIOU_Loss来代替Smooth L1 Loss函数,从而进一步提升算法的检测精度。

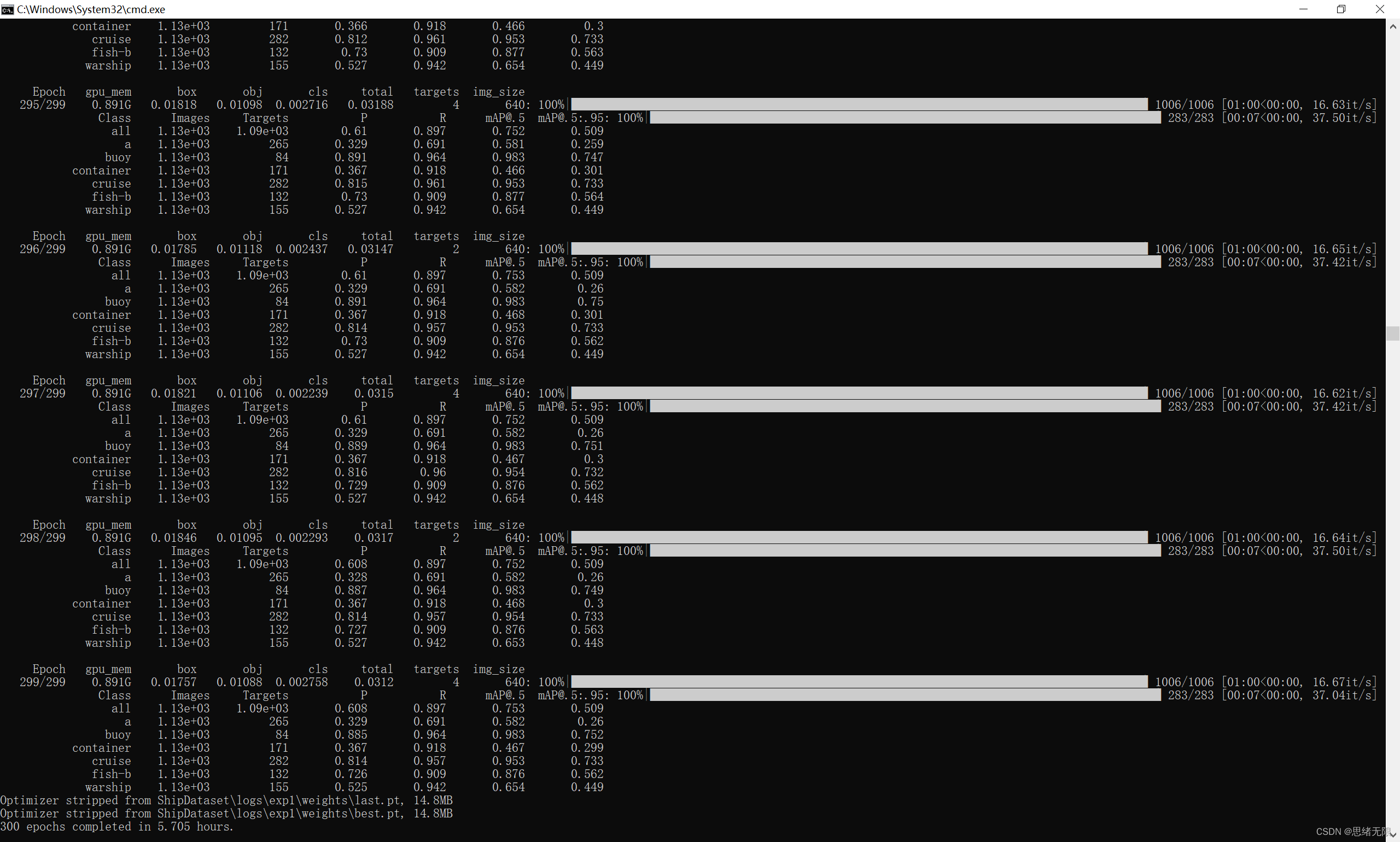

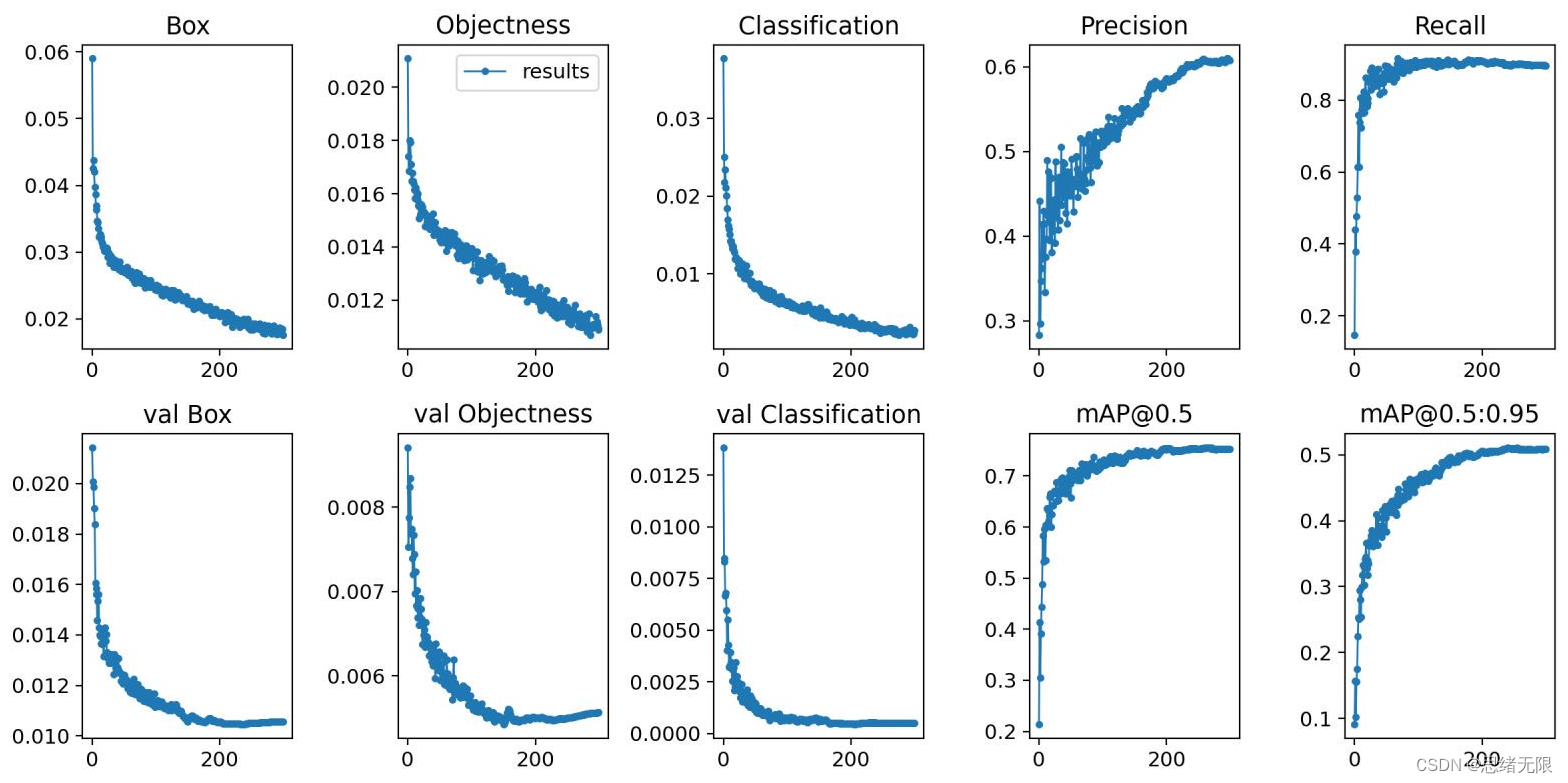

以上就是YOLOv5的整体介绍,接下来进行训练。本项目使用Yolov5训练了一个海上船舶目标检测模型,在笔记本的3070显卡下训练了300 epoch,训练集和验证集上损失、精确率、召回率、mAP的变化图:

在深度学习中,我们通常通过损失函数下降的曲线来观察模型训练的情况。而YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),在训练结束后,我们也可以在logs目录下找到生成对若干训练过程统计图。下图为博主训练舰船类识别的模型训练曲线图。

一般我们会接触到两个指标,分别是召回率recall和精度precision,两个指标p和r都是简单地从一个角度来判断模型的好坏,均是介于0到1之间的数值,其中接近于1表示模型的性能越好,接近于0表示模型的性能越差,为了综合评价目标检测的性能,一般采用均值平均密度map来进一步评估模型的好坏。我们通过设定不同的置信度的阈值,可以得到在模型在不同的阈值下所计算出的p值和r值,一般情况下,p值和r值是负相关的,绘制出来可以得到如下图所示的曲线,其中曲线的面积我们称AP,目标检测模型中每种目标可计算出一个AP值,对所有的AP值求平均则可以得到模型的mAP值。以PR-curve为例,可以看到我们的模型在验证集上的均值平均准确率为0.753。

3. 舰船检测识别

在训练完成后得到最佳模型,接下来我们将帧图像输入到这个网络进行预测,从而得到预测结果,预测方法(predict.py)部分的代码如下所示:

if __name__ == '__main__':

img_path = "./UI_rec/test_/Bobolink_0079_10736.jpg"

image = cv_imread(img_path)

img0 = image.copy()

img = letterbox(img0, new_shape=imgsz)[0]

img = np.stack(img, 0)

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416

img = np.ascontiguousarray(img)

pred, useTime = predict(img)

det = pred[0]

p, s, im0 = None, '', img0

if det is not None and len(det): # 如果有检测信息则进入

det[:, :4] = scale_coords(img.shape[1:], det[:, :4], im0.shape).round() # 把图像缩放至im0的尺寸

number_i = 0 # 类别预编号

detInfo = []

for *xyxy, conf, cls in reversed(det): # 遍历检测信息

c1, c2 = (int(xyxy[0]), int(xyxy[1])), (int(xyxy[2]), int(xyxy[3]))

# 将检测信息添加到字典中

detInfo.append([names[int(cls)], [c1[0], c1[1], c2[0], c2[1]], '%.2f' % conf])

number_i += 1 # 编号数+1

label = '%s %.2f' % (names[int(cls)], conf)

# 画出检测到的目标物

plot_one_box(image, xyxy, label=label, color=colors[int(cls)])

# 实时显示检测画面

cv2.imshow('Stream', image)

# if cv2.waitKey(1) & 0xFF == ord('q'):

# break

c = cv2.waitKey(0) & 0xff

执行得到的结果如下图所示,图中舰船的种类和置信度值都标注出来了,预测速度较快。基于此模型我们可以将其设计成一个带有界面的系统,在界面上选择图片、视频或摄像头然后调用模型进行检测。

博主对整个系统进行了详细测试,最终开发出一版流畅得到清新界面,就是博文演示部分的展示,完整的UI界面、测试图片视频、代码文件,以及Python离线依赖包(方便安装运行,也可自行配置环境),均已打包上传,感兴趣的朋友可以通过下载链接获取。

下载链接

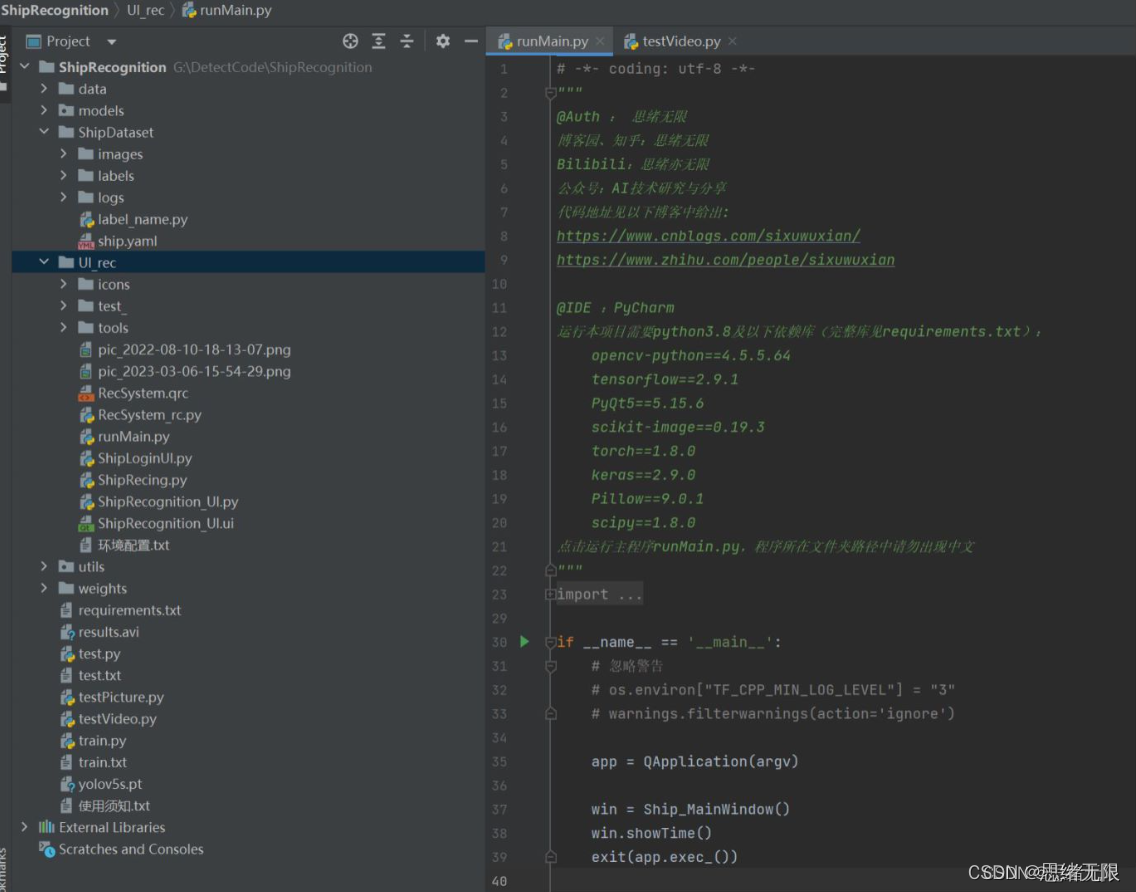

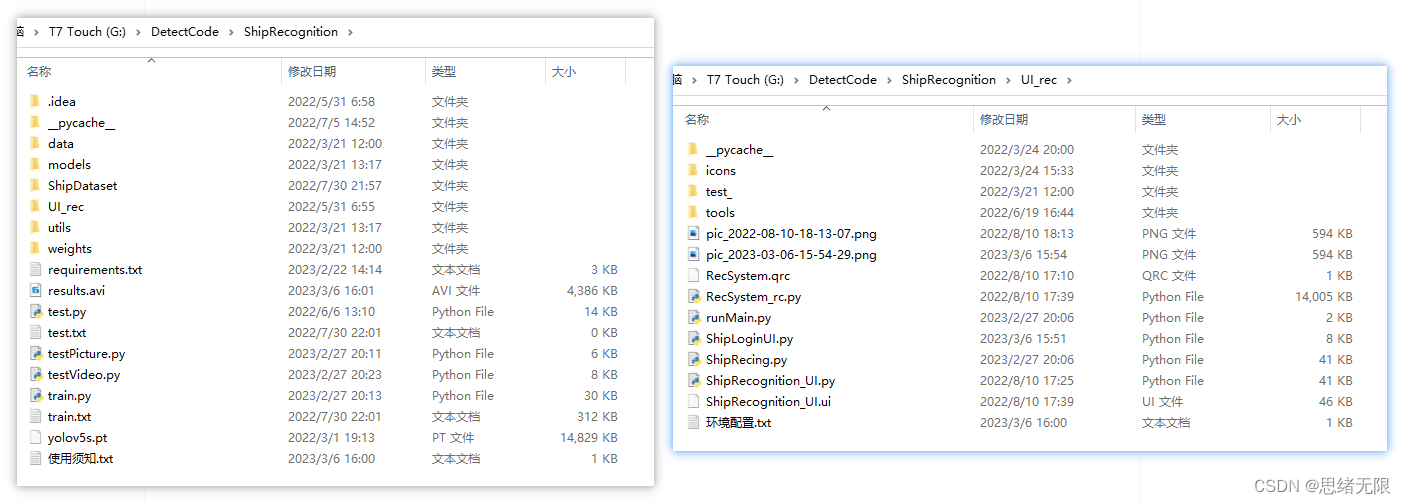

若您想获得博文中涉及的实现完整全部程序文件(包括测试图片、视频,py, UI文件等,如下图),这里已打包上传至博主的面包多平台,见可参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

在文件夹下的资源显示如下,下面的链接中也给出了Python的离线依赖包,读者可在正确安装Anaconda和Pycharm软件后,复制离线依赖包至项目目录下进行安装,离线依赖的使用详细演示也可见本人B站视频:win11从头安装软件和配置环境运行深度学习项目、Win10中使用pycharm和anaconda进行python环境配置教程。

注意:该代码采用Pycharm+Python3.8开发,经过测试能成功运行,运行界面的主程序为runMain.py和LoginUI.py,测试图片脚本可运行testPicture.py,测试视频脚本可运行testVideo.py。为确保程序顺利运行,请按照requirements.txt配置Python依赖包的版本。Python版本:3.8,请勿使用其他版本,详见requirements.txt文件;

完整资源中包含数据集及训练代码,环境配置与界面中文字、图片、logo等的修改方法请见视频,项目完整文件下载请见参考博客文章里面,或参考视频的简介处给出:➷➷➷

参考博客文章:https://zhuanlan.zhihu.com/p/615306023

参考视频演示:https://www.bilibili.com/video/BV19b411o76q/

离线依赖库下载链接:https://pan.baidu.com/s/1hW9z9ofV1FRSezTSj59JSg?pwd=oy4n (提取码:oy4n )

界面中文字、图标和背景图修改方法:

在Qt Designer中可以彻底修改界面的各个控件及设置,然后将ui文件转换为py文件即可调用和显示界面。如果只需要修改界面中的文字、图标和背景图的,可以直接在ConfigUI.config文件中修改,步骤如下:

(1)打开UI_rec/tools/ConfigUI.config文件,若乱码请选择GBK编码打开。

(2)如需修改界面文字,只要选中要改的字符替换成自己的就好。

(3)如需修改背景、图标等,只需修改图片的路径。例如,原文件中的背景图设置如下:

mainWindow = :/images/icons/back-image.png

可修改为自己的名为background2.png图片(位置在UI_rec/icons/文件夹中),可将该项设置如下即可修改背景图:

mainWindow = ./icons/background2.png

结束语

由于博主能力有限,博文中提及的方法即使经过试验,也难免会有疏漏之处。希望您能热心指出其中的错误,以便下次修改时能以一个更完美更严谨的样子,呈现在大家面前。同时如果有更好的实现方法也请您不吝赐教。