基于YOLOv5的疲劳驾驶检测系统(Python+清新界面+数据集)

摘要:基于YOLOv5的疲劳驾驶检测系统使用深度学习技术检测常见驾驶图片、视频和实时视频中的疲劳行为,识别其闭眼、打哈欠等结果并记录和保存,以防止交通事故发生。本文详细介绍疲劳驾驶检测系统实现原理的同时,给出Python的实现代码、训练数据集以及PyQt的UI界面。在界面中可以选择各种图片、视频进行检测识别,可对图像中存在的多个目标进行识别分类。博文提供了完整的Python代码和使用教程,适合新入门的朋友参考,完整代码资源文件请转至文末的下载链接。本博文目录如下:

文章目录

- 前言

- 1. 效果演示

- 2. 疲劳驾驶检测

- 下载链接

- 结束语

➷点击跳转至文末所有涉及的完整代码文件下载页☇

基于YOLOv5的疲劳驾驶检测系统演示与介绍(Python+清新界面+数据集)

前言

疲劳驾驶,是指在长时间连续行车后,驾驶员在心理技能和生理机制上发生变化,在客观上表现为驾驶技能的下降,并且表现出打瞌睡、反应迟钝、四肢无力、注意力不集中以及判断能力下降等现象。具不完全统计,50%的交通安全事故起源驾驶员意识不清醒从而酿成车祸。

对驾驶员的疲劳状态进行实时检测是汽车安全驾驶的关键的一环,因此在驾驶车辆时需要对驾驶员的疲劳状态进行实时检测及时做出预警。基于视觉特征的驾驶员疲劳状态检测方法,主要是利用摄像机对驾驶状态下的驾驶员面部特征进行实时采集,然后使用基于视觉以及图像处理的方法,获取得到驾驶员的眼部、嘴部以及头部区域信息等特征信息。最后,使用一定的判别方法对提取到的驾驶员眨眼间频率,打哈欠等特征分析,对驾驶员疲劳状态进行检测。随着当前深度学习方法在目标检测方向上的应用深入,基于YOLOv5的目标检测方法具有应用的可能性与应用前景。

基于YOLOv5的疲劳驾驶检测系统应用深度学习技术检测常见驾驶过程中可能存在的疲劳驾驶行为,包括闭眼、打哈欠等常见行为,以方便对驾驶员的安全驾驶进行监测分析;系统采用登录注册进行用户管理;对于图片、视频和摄像头捕获的实时画面,系统可检测画面中的疲劳驾驶行为;系统支持结果记录、展示和保存,每次检测的结果记录在表格中。对此这里给出博主设计的界面,同款的简约风,功能也可以满足图片、视频和摄像头的识别检测,希望大家可以喜欢,初始界面如下图:

检测类别时的界面截图(点击图片可放大)如下图,可识别画面中存在的多个类别,也可开启摄像头或视频检测:

详细的功能演示效果参见博主的B站视频或下一节的动图演示,觉得不错的朋友敬请点赞、关注加收藏!系统UI界面的设计工作量较大,界面美化更需仔细雕琢,大家有任何建议或意见和可在下方评论交流。

1. 效果演示

这里通过动图看一下识别的效果,系统主要实现的功能是对图片、视频和摄像头画面中的疲劳驾驶行为进行识别,识别的结果可视化显示在界面和图像中,另外提供多个人脸的显示选择功能,演示效果如下。

(一)系统介绍

经查阅相关文献,疲劳在人体面部表情中表现出大致三个类型:打哈欠(嘴巴张大且相对较长时间保持这一状态)、眨眼(或眼睛微闭,此时眨眼次数增多,且眨眼速度变慢)等。这里使用YOLOv5识别这些数据特征,实时地分析驾驶员的疲劳驾驶行为,并及时作出安全提示。

(二)技术特点

(1)YOLO v5算法实现,模型一键切换更新;

(2)检测图片、视频等图像中的各疲劳驾驶行为;

(3)摄像头监控实时检测,便携展示、记录和保存;

(4)支持用户登录、注册,检测结果可视化功能;

(5)提供训练数据集和代码,可重新训练模型;

(三)用户注册登录界面

对于系统登录界面如下图所示,可以输入用户名和密码进行登录注册功能,在输入正确后可以进入主界面。

(四)选择图片识别

系统可以选择图片文件进行识别,点击图片选择按钮图标选择图片后,显示所有人脸识别的结果,可通过下拉选框查看单个结果,以便具体判断某一疲劳驾驶人员。本功能的界面展示如下图所示:

(五)视频识别效果展示

如果要识别视频中的疲劳驾驶情况,可以点击视频按钮可选择待检测的视频,系统会自动解析视频逐帧识别人脸,并将是否疲劳驾驶的结果记录在右下角表格中,效果如下图所示:

(六)摄像头检测效果展示

在真实场景中,如果需要利用设备摄像头获取实时画面,并对画面中的疲劳驾驶行为进行识别,可点击摄像头按钮后系统进入准备状态,系统显示实时画面并开始检测画面中的驾驶员,识别结果展示如下图:

2. 疲劳驾驶检测

(一)疲劳驾驶数据集

这里我们使用的疲劳驾驶数据集,包含训练数据集656张图片、验证集188张图片、测试集94张图片,共计938张图片。

每张图像均提供了图像类标记信息,图像中疲劳驾驶的bounding box,数据集并解压后得到如下的图片。

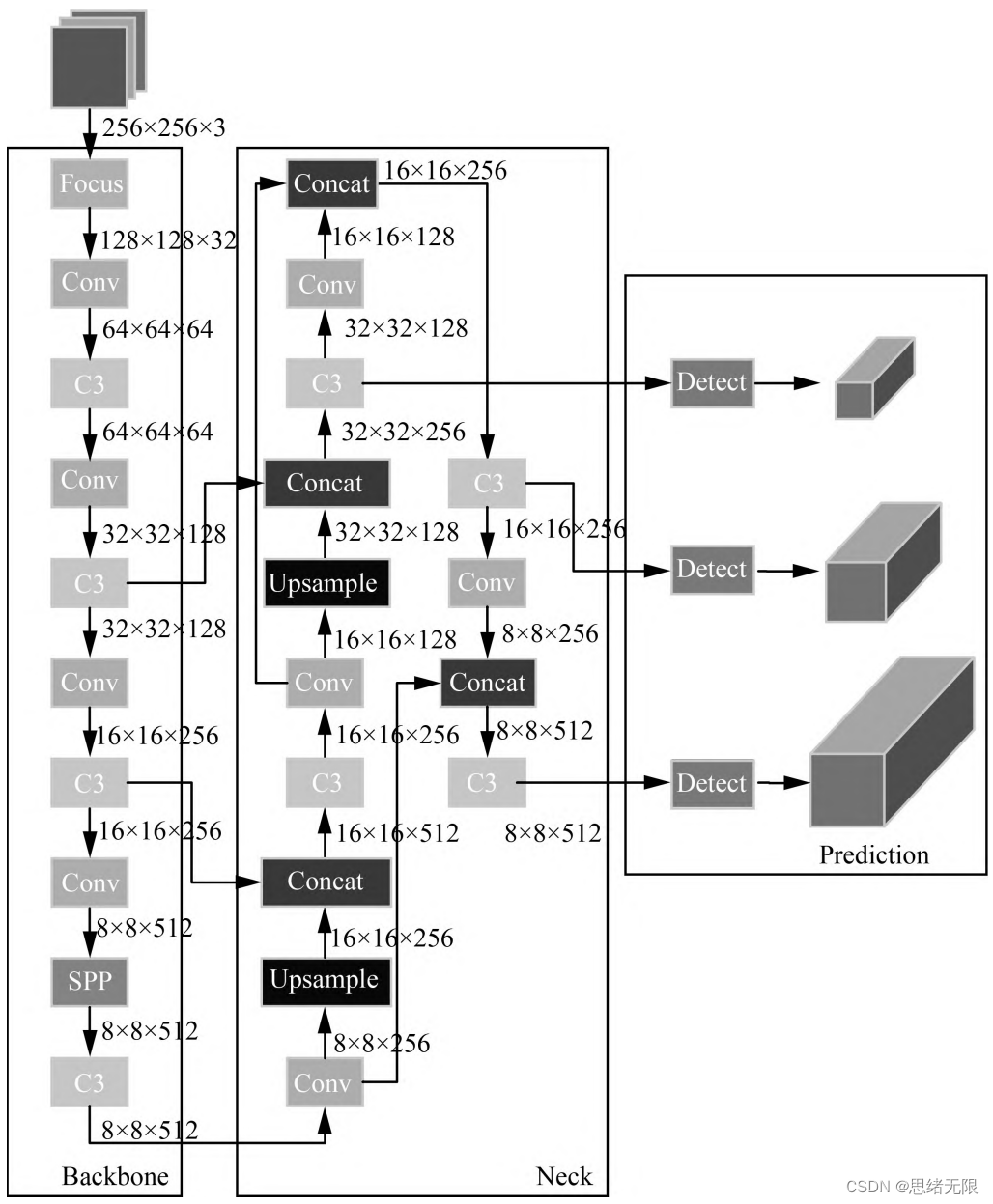

(二)网络结构

Yolov5网络结构是由Input、Backbone、Neck、Prediction组成。Yolov5的Input部分是网络的输入端,采用Mosaic数据增强方式,对输入数据随机裁剪,然后进行拼接。Backbone是Yolov5提取特征的网络部分,特征提取能力直接影响整个网络性能。Yolov5的Backbone相比于之前Yolov4提出了新的Focus结构。Focus结构是将图片进行切片操作,将W(宽)、H(高)信息转移到了通道空间中,使得在没有丢失任何信息的情况下,进行了2倍下采样操作。

(三)训练过程

网络的训练由于数据量较大进行实验时将数据分为多个批次, 每个批次中含有 一定数目图像, 经过前向、 反向传播后更新网络参数, 训练出误差合适的网络。测试时, 图像由网络进行识别, 根据得到的识别正确率来验证网络的可行性。

对前面介绍过的数据集经过处理后标签文件均转换为YOLOv5训练所需的标记格式,基于此数据集,我们在train.py中设置必要参数后,运行该脚本进行模型训练,训练过程在终端的显示如下图所示。

在深度学习中,我们通常通过损失函数下降的曲线来观察模型训练的情况。而YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),模型训练曲线图如下图所示。

一般我们会利用召回率recall和精度precision,两个指标p和r都是简单地从一个角度来判断模型的好坏,为了综合评价目标检测的性能,一般采用均值平均密度map来进一步评估模型的好坏。我们通过设定不同的置信度的阈值,可以得到在模型在不同的阈值下所计算出的p值和r值,一般情况下,p值和r值是负相关的,绘制出来可以得到如下图所示的曲线。

(四)预测过程

在训练完成后得到最佳模型,接下来我们将帧图像输入到这个网络进行预测,从而得到预测结果,其中预测方法(predict.py)部分的代码如下所示:

def predict(img):

img = torch.from_numpy(img).to(device)

img = img.half() if half else img.float()

img /= 255.0

if img.ndimension() == 3:

img = img.unsqueeze(0)

t1 = time_synchronized()

pred = model(img, augment=False)[0]

pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes,

agnostic=opt.agnostic_nms)

t2 = time_synchronized()

InferNms = round((t2 - t1), 2)

return pred, InferNms

得到预测结果我们便可以将帧图像中的目标框出,以下是读取视频文件并进行检测的脚本,首先将图片数据进行预处理后送predict进行检测,然后计算标记框的位置并在图中标注出来。

if __name__ == '__main__':

# video_path = 0

video_path = "./UI_rec/test_/疲劳驾驶检测.mp4"

# 初始化视频流

vs = cv2.VideoCapture(video_path)

(W, H) = (None, None)

frameIndex = 0 # 视频帧数

try:

prop = cv2.CAP_PROP_FRAME_COUNT

total = int(vs.get(prop))

# print("[INFO] 视频总帧数:{}".format(total))

# 若读取失败,报错退出

except:

print("[INFO] could not determine # of frames in video")

print("[INFO] no approx. completion time can be provided")

total = -1

fourcc = cv2.VideoWriter_fourcc(*'XVID')

ret, frame = vs.read()

vw = 850

vh = 500

print("[INFO] 视频尺寸:{} * {}".format(vw, vh))

output_video = cv2.VideoWriter("./results.avi", fourcc, 20.0, (vw, vh)) # 处理后的视频对象

# 遍历视频帧进行检测

while True:

# 从视频文件中逐帧读取画面

(grabbed, image) = vs.read()

image = cv2.resize(image, (850, 500))

# 若grabbed为空,表示视频到达最后一帧,退出

if not grabbed:

print("[INFO] 运行结束...")

output_video.release()

vs.release()

exit()

# 获取画面长宽

if W is None or H is None:

(H, W) = image.shape[:2]

img0 = image.copy()

img = letterbox(img0, new_shape=imgsz)[0]

img = np.stack(img, 0)

img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416

img = np.ascontiguousarray(img)

pred, useTime = predict(img)

det = pred[0]

p, s, im0 = None, '', img0

if det is not None and len(det): # 如果有检测信息则进入

det[:, :4] = scale_coords(img.shape[1:], det[:, :4], im0.shape).round() # 把图像缩放至im0的尺寸

number_i = 0 # 类别预编号

detInfo = []

for *xyxy, conf, cls in reversed(det): # 遍历检测信息

c1, c2 = (int(xyxy[0]), int(xyxy[1])), (int(xyxy[2]), int(xyxy[3]))

# 将检测信息添加到字典中

detInfo.append([names[int(cls)], [c1[0], c1[1], c2[0], c2[1]], '%.2f' % conf])

number_i += 1 # 编号数+1

label = '%s %.2f' % (names[int(cls)], conf)

# 画出检测到的目标物

plot_one_box(image, xyxy, label=label, color=colors[int(cls)])

# 实时显示检测画面

cv2.imshow('Stream', image)

output_video.write(image) # 保存标记后的视频

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# print("FPS:{}".format(int(0.6/(end-start))))

frameIndex += 1

执行得到的结果如下图所示,图中行人和置信度值都标注出来了,预测速度较快。基于此模型我们可以将其封装成一个带有界面的系统,在界面上选择图片、视频或摄像头然后调用模型进行检测。

博主对整个系统进行了详细测试,最终开发出一版流畅得到清新界面,就是博文演示部分的展示,完整的UI界面、测试图片视频、代码文件,以及Python离线依赖包(方便安装运行,也可自行配置环境),均已打包上传,感兴趣的朋友可以通过下载链接获取。

下载链接

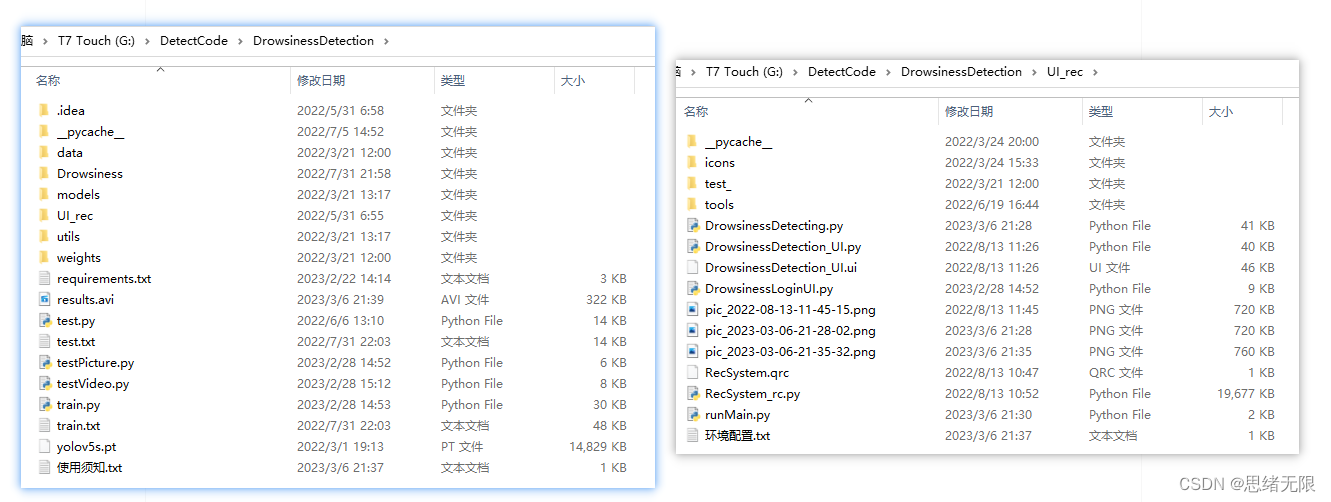

若您想获得博文中涉及的实现完整全部程序文件(包括测试图片、视频,py, UI文件等,如下图),这里已打包上传至博主的面包多平台,见可参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

在文件夹下的资源显示如下,下面的链接中也给出了Python的离线依赖包,读者可在正确安装Anaconda和Pycharm软件后,复制离线依赖包至项目目录下进行安装,离线依赖的使用详细演示也可见本人B站视频:win11从头安装软件和配置环境运行深度学习项目、Win10中使用pycharm和anaconda进行python环境配置教程。

注意:该代码采用Pycharm+Python3.8开发,经过测试能成功运行,运行界面的主程序为runMain.py和LoginUI.py,测试图片脚本可运行testPicture.py,测试视频脚本可运行testVideo.py。为确保程序顺利运行,请按照requirements.txt配置Python依赖包的版本。Python版本:3.8,请勿使用其他版本,详见requirements.txt文件;

完整资源中包含数据集及训练代码,环境配置与界面中文字、图片、logo等的修改方法请见视频,项目完整文件下载请见参考博客文章里面,或参考视频的简介处给出:➷➷➷

参考博客文章:https://zhuanlan.zhihu.com/p/615310050

参考视频演示:https://www.bilibili.com/video/BV1bL411k7Wj/

离线依赖库下载链接:https://pan.baidu.com/s/1hW9z9ofV1FRSezTSj59JSg?pwd=oy4n (提取码:oy4n )

界面中文字、图标和背景图修改方法:

在Qt Designer中可以彻底修改界面的各个控件及设置,然后将ui文件转换为py文件即可调用和显示界面。如果只需要修改界面中的文字、图标和背景图的,可以直接在ConfigUI.config文件中修改,步骤如下:

(1)打开UI_rec/tools/ConfigUI.config文件,若乱码请选择GBK编码打开。

(2)如需修改界面文字,只要选中要改的字符替换成自己的就好。

(3)如需修改背景、图标等,只需修改图片的路径。例如,原文件中的背景图设置如下:

mainWindow = :/images/icons/back-image.png

可修改为自己的名为background2.png图片(位置在UI_rec/icons/文件夹中),可将该项设置如下即可修改背景图:

mainWindow = ./icons/background2.png

结束语

由于博主能力有限,博文中提及的方法即使经过试验,也难免会有疏漏之处。希望您能热心指出其中的错误,以便下次修改时能以一个更完美更严谨的样子,呈现在大家面前。同时如果有更好的实现方法也请您不吝赐教。